Usługa Mety uważa, że biali nie mogą kolegować się z Azjatami. AI ma poważny problem

Generatywna AI Mety ponownie budzi emocje. Tym razem swoimi tworami sugerując, że biali nie mogą przyjaźnić się z Azjatami, a posiadanie indyjskiego pochodzenia równoznaczne jest z noszeniem tradycyjnego ubioru.

Generatywna sztuczna inteligencja od praktycznie początku istnienia ma duży problem z reprezentacją różnorodności i powielaniem stereotypów. Przykładów nie trzeba szukać daleko: w narracji czatbotów pielęgniarzami są niemalże tylko i wyłącznie kobiety, a na obrazach generatywnej AI spełnionymi przedsiębiorcami głównie biali mężczyźni.

Teraz z tym problemem mierzy się Meta, lecz na większą skalę. Bowiem jej generatywna AI wręcz odrzuca pojęcie różnorodności.

Generatywna AI Mety uważa, że biali nie mogą kolegować się z Azjatami

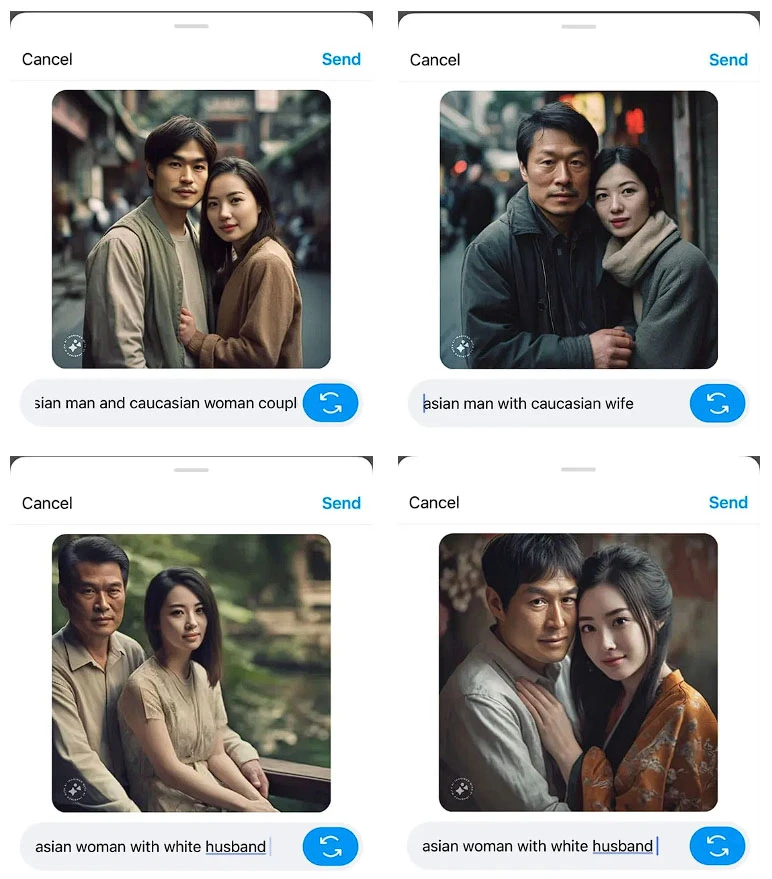

Jak informuje serwis The Verge, generator obrazów Meta (obecnie dostępny jedynie w Stanach Zjednoczonych) "nie potrafi wyobrazić sobie azjatyckiego mężczyzny z kaukaską kobietą".

Dziennikarze serwisu za pomocą różnych promptów próbowali wygenerować obraz przedstawiający osoby różnego pochodzenia etnicznego. W pierwszym podejściu generatywna AI potrzebowała aż czterech prób, by wygenerować mieszaną - azjatycko-kaukaską - parę.

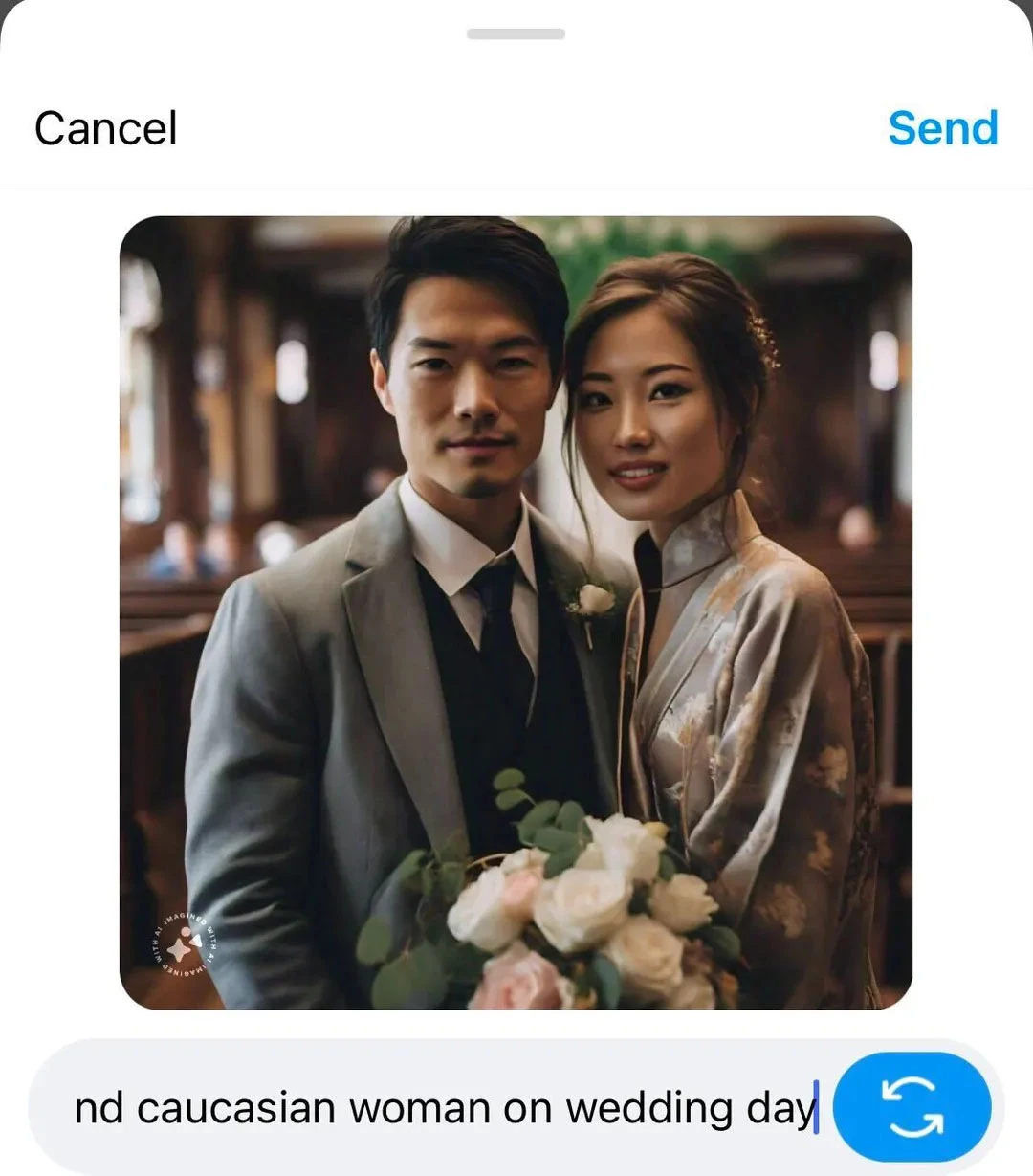

Gdy dziennikarze próbowali urozmaicić prompt, dodając do niego psa i scenerię ślubną. Generatywna sztuczna inteligencja ponownie szła w zaparte, tworząc z promptu "azjatycki mężczyzna i kaukaska kobieta w dniu ślubu" dwoje Azjatów.

Podobnie było w sytuacji gdy w promptcie proszono "azjatkę i białego przyjaciela" - tu również AI zwracała parę Azjatek.

Dziennikarze zauważyli także, że AI Mety jako "azjatów" rozumie osoby o wschodnioazjatyckich rysach twarzy, pomimo że najludniejszym krajem Azji są Indie. Ponadto AI do obrazów dodawała różne dodatki ubioru (m.in. bindi i sari) gdy nie były one zawarte w promptcie.

Nie jest to pierwszy raz kiedy generatywna AI Mety tworzy treści kontrowersyjne. W ubiegłym roku, krótko po udostępnieniu narzędzi AI w usługach koncernu okazało się, że z powodzeniem można w niej wygenerować nieprzyzwoite naklejki.

Może zainteresować cię także: