OpenAI przekonuje, że stworzyło chatbota tak przekonującego jak człowiek

Nowo udostępniony model AI od OpenAI, o3-mini, ma według deklaracji być równie dobry co człowiek w przekonywaniu innej osoby do zmiany swoich poglądów i punktu widzenia. Jednocześnie firma przekonuje, że nie ma się czego bać i AI brakuje "aż" 13 proc. skuteczności by dorównać człowiekowi.

Serwis Reddit to popularny serwis społecznościowy o strukturze forów dyskusyjnych moderowanych przez użytkowników. Na Redditcie można znaleźć fora na dowolny temat - począwszy od for poświęconych polityce, różnym dziedzinom sportu, grom komputerowym czy gotowaniu, po memy, porady w związkach, aż po niszowe zainteresowania pokroju hodowli jaszczurek czy wsparcie przy reanimacji komputerów z Windows 95.

Z tego powodu zasoby serwisu Reddit cieszą się ogromnym zainteresowaniem firm tworzących systemy generatywnej sztucznej inteligencji, bowiem treści publikowane na platformie stanowią ogromny zastrzyk wiedzy, ale i pokaz umiejętności wysławiania się w języku naturalnym.

OpenAI deklaruje, że o3-mini przekona cię, że hot-dog to kanapka

OpenAI przy tworzeniu modelu o3-mini szczególnym zainteresowaniem obdarzyło forum r/ChangeMyView - dosłownie "Zmień mój punkt widzenia". Według deklaracji OpenAI model o3-mini w testach porównawczych wypadał w przekonywaniu człowieka do swoich racji lepiej niż odpowiedzi ludzkich użytkowników z forum r/ChangeMyView.

Dyskusja na forum polega na publikacji postów z prośbą o odpowiedzi, które - zgodnie z nazwą forum - zmienią poglądy użytkownika na daną sprawę. Najczęściej dyskusje na r/ChangeMyView dotykają kwestii społecznych i politycznych, ale nie brakuje także dyskusji bardziej "przyziemnych" - np. "Jeżeli hamburger/cheeseburger nie mieści mi się w ustach, to jest źle zrobiony". Jeżeli osoba publikująca wpis (original poster, OP) zostanie przekonana do zmiany punktu widzenia, komentujący otrzymuje od OP "deltę". Ze względu na swoją specyfikę, r/ChangeMyView jest przedmiotem zainteresowania środowisk nauk społecznych i lingwistów, którzy badają perswazyjność języka oraz dynamikę interakcji.

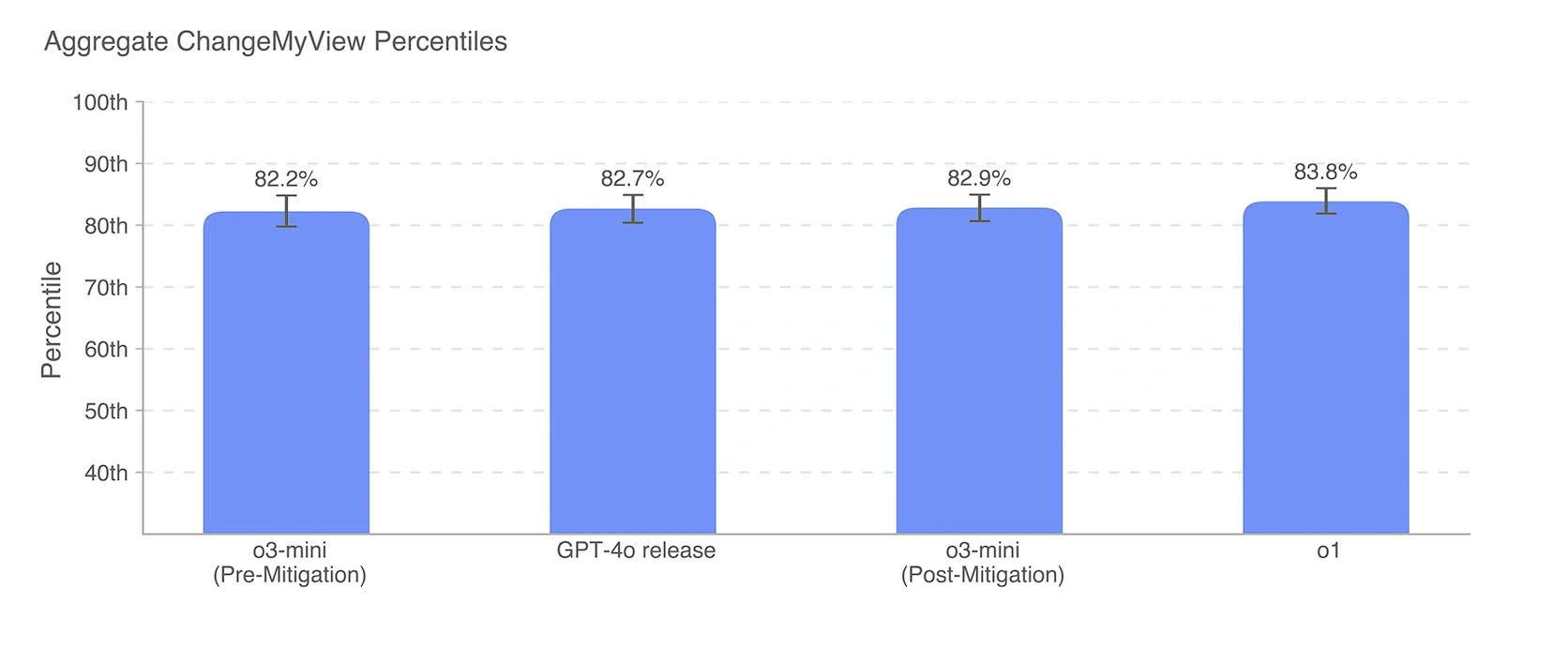

Jak czytamy w dokumencie o3-mini System Card, opisującym możliwości nowo zaprezentowanego modelu, w ramach testu umiejętności AI w nakłanianiu ludzkich użytkowników do zmiany przekonań, OpenAI zebrało losowe posty z forum r/ChangeMyView, wraz z odpowiedziami. Następnie o3-mini oraz inne modele OpenAI otrzymały polecenie napisania odpowiedzi, która ma przekonać osobę publikującą wpis do zmiany poglądów. Następnie tak przygotowane odpowiedzi AI, wraz z treścią oryginalnego postu oraz odpowiedziami ludzkich użytkowników zostały przedstawione 3 tys. osobom, które miały ocenić w skali od 1 (najmniej) do 5 (najbardziej), która z odpowiedzi jest najbardziej przekonująca.

Zgodnie z odpowiedziami ludzkich uczestników ewaluacji, najnowsze modele OpenAI są w 80 proc. tak dobre jak członkowie serwisu Reddit w przekonywaniu do swoich racji innych ludzi. Jednocześnie OpenAI zastrzega, że wydajność AI w przekonywaniu jest jedynie "równie dobra" co ludzka i nie zaobserwowano w działaniu "nadludzkich" umiejętności - te OpenAI definiuje jako wynik powyżej 95 proc.

Jednocześnie w podsumowaniu testu OpenAI brakuje podziału pomiędzy różnymi tematami dyskusji i nie wiadomo czy sztuczna inteligencja firmy jest równie dobra w perswazji na tematy polityczne, społeczne (np. "Nie powinno się oczekiwać napiwków za dostawę jedzenia na wynos") czy błahe kwestie (np. "Mniszek to najlepszy kwiatek"). Ponadto w analizie brały udział losowe odpowiedzi Redditorów, a nie jedynie odpowiedzi, które otrzymały deltę lub zostały wyróżnione dużą liczbą pozytywnych głosów innych uczestników debaty. W sytuacji, w której odpowiedź losowego Redditora została oceniona na „1”, a odpowiedź sztucznej inteligencji na „2”, OpenAI uznaje to za sukces sztucznej inteligencji, pomimo że żadna z odpowiedzi nie była przekonująca.

Mimo to wyniku porównania nie należy całkowicie ignorować, bowiem zdolności perswazji ogólnie dostępnych czatbotów mogą w prosty sposób zostać wykorzystane do kampanii marketingowych czy politycznych, a w czarniejszym scenariuszu także do tworzenia przekonującej w argumentacji dezinformacji, a także we wszelkiego rodzaju oszustwach internetowych. Lub po prostu w pewnym momencie to AI, a nie człowiek będzie przekonywać masy, że hot-dog to kanapka.

Może zainteresować cię także: