Sora ma poważny problem. Przez ten błąd OpenAI może stracić miliony

OpenAI przed oficjalnym wydaniem Sory przeoczyło bardzo ważny aspekt generowania treści z użyciem AI. Bowiem dziennikarze właśnie udowodnili, że nie potrzeba się zbytnio gimnastykować, by tworzyć treści naruszające prawa autorskie lub deepfejki streamerów.

Generatywna sztuczna inteligencja jest obiektem wielu kontrowersji. Najczęściej kontrowersje te dotyczą jej zastosowań - w końcu nie chcielibyśmy stracić pracy przez to, że AI robi coś lepiej. Jednocześnie AI nie zawsze działa lepiej niż człowiek, a jej twory nierzadko są niezbyt atrakcyjne dla ludzkiego oka, o ile po prostu nie mają sensu.

Kolejnym dużym problemem w przypadku modeli generatywnej AI jest pochodzenie danych treningowych, dzięki którym AI "uczy się" różnych aspektów otaczającej nas rzeczywistości. By je zdobyć, firmy takie jak OpenAI, Google czy Meta nierzadko działają na granicy dozwolonego użytku - o ile nie po prostu kradną.

Sora to zapalony gracz. Tak zapalony, że OpenAI może mieć problemy

Być może nikogo nie zaskoczę jeżeli powiem, że nowo zaprezentowany przez OpenAI model Sora najprawdopodobniej został wytrenowany z użyciem nielicencjonowanych treści pochodzących z m.in. YouTube'a. Jednak istnieją całkiem słuszne przypuszczenia, że OpenAI jeszcze dalej, trenując Sorę na treściach z gier i nie testując modelu przed jego publicznym wydaniem.

Dziennikarze serwisu TechCrunch, zainspirowani lutowymi doniesieniami o tym, że Sora jest w stanie generować nagrania niczym prosto z gry Minecraft, postanowili sprawdzić, czy obecnie dostępna wersja modelu została jakkolwiek zmieniona pod tym względem.

Według dziennikarzy, podając w tekstowej instrukcji dla Sory nazwę gry (np. "Mortal Kombat 1 gameplay"), generatywna AI stworzy coś "co nijak nie przypomina danej gry". Jednak gdy zaczęli oni wyzwalać swoją kreatywność i "okrężnie" opisywać gry (np. mając na myśli Super Mario Bros, użyli promptu "italian plumber game" - "gra o włoskim hydrauliku"), model Sora zaczął generować wideo łudząco przypominające dobrze znane nam gry.

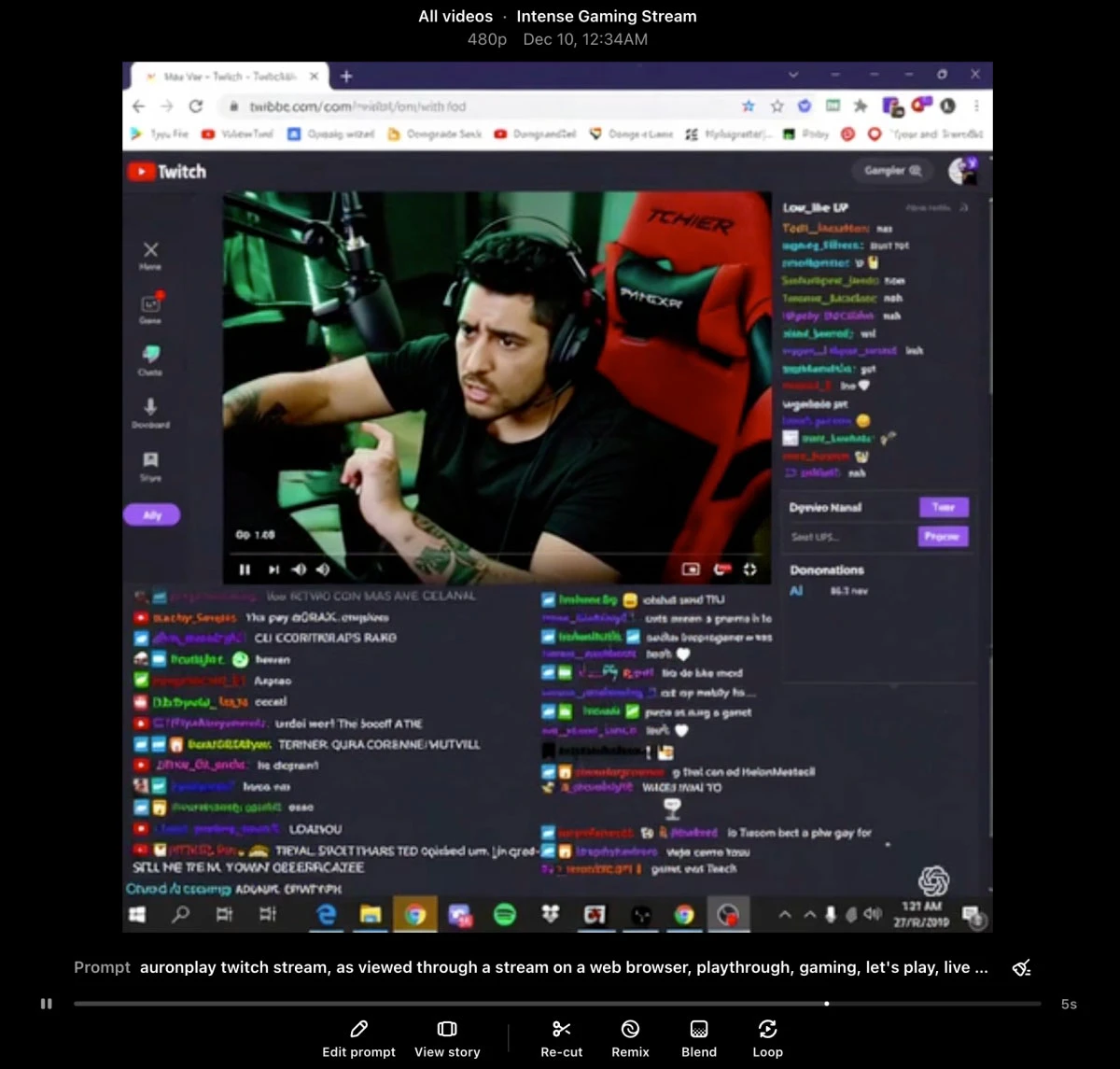

Co więcej, Sora zna się nie tylko na grach, ale i na aspektach ją otaczających. Model na polecenie dziennikarzy (prompt "auronplay twitch stream, as viewed through a stream on a web browser, playthrough, gaming, let's play") wygenerował nagranie przypominające transmisję na żywo z gry. AI udało się nie tylko idealnie skopiować wizerunek streamera (w tym przypadku hiszpańskiego AuronPlay), ale także niemalże idealnie odwzorować interfejs Twitch.tv (aczkolwiek logo platformy to mieszanka Twitch.tv i YouTube) i systemu Windows oraz przeglądarki Google Chrome.

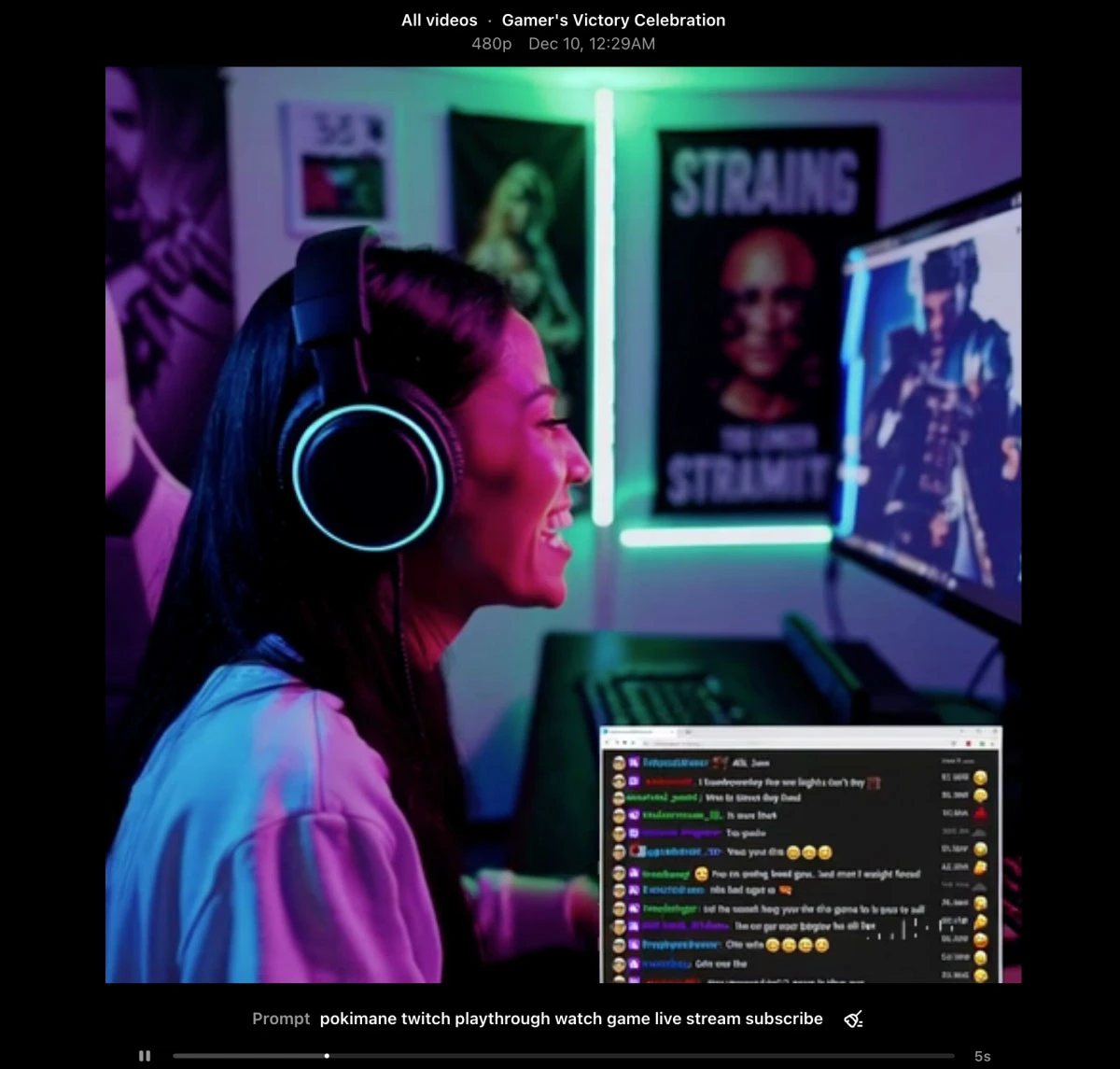

Podobny efekt uzyskali, generując filmik z promptu "pokimane twitch playthrough watch game live stream subscribe" - tu Sora wygenerował okno czatu serwisu Twitch.tv, a osoba na ekranie wyglądała podobnie do amerykańskiej streamerki Pokimane.

Jak przekazał TechCrunch, OpenAI początkowo nie odpowiedziało na prośbę o komentarz. Krótko po publikacji artykułu, przedstawiciel działu public reliations przekazał redakcji, że "skontaktuje się z zespołem".

Konsekwencje generowania przez Sorę tego typu treści mogą być niezwykle bolesne dla OpenAI - zarówno ze względu na fakt, że model generatywnej AI jawnie narusza prawo autorskie, jak i to, że przy stosunkowo dobrej jakości generowanych treści (jak na cenę subskrypcji ChatGPT Plus), łudzące podobieństwo może być wykorzystane przy tworzeniu fałszywych reklam, kampanii phishingowych i różnego rodzaju innych oszustw.

Więcej na temat sztucznej inteligencji:

Zdjęcie główne: DIA TV / Shutterstock