ChatGPT zastąpi dziennikarzy? Naukowcy właśnie opluli się kawą

OpenAI publikując SearchGPT obiecywało użytkownikom "szybkie, aktualne odpowiedzi z linkami do odpowiednich źródeł internetowych". Jak pokazali amerykańscy eksperci z dziedziny dziennikarstwa, z tych obietnic zostało jedynie słowo "szybkie".

Wizja zastąpienia dziennikarzy przez generatywną inteligencję jest powtarzana właściwie stale od momentu, w którym ChatGPT i inne czatboty opanowały internet. Jednak z tą tezą co najmniej nie zgadzają się eksperci z Tow Center for Digital Journalism, instytutu dziennikarstwa operującego w ramach Uniwersytetu Columbia.

Eksperci dziennikarstwa położyli na deski ChatGPT. SearchGPT jest dobry tylko na materiałach promocyjnych OpenAI

Tow Center przeprowadziło test, który miał na celu zrozumienie sposobów prezentacji i przetwarzania treści wydawców przez należący do OpenAI czatbot ChatGPT. Pochylenie się ekspertów jedynie nad ChatGPT było zamierzone, gdyż w październiku OpenAI opublikowało narzędzie SearchGPT, dzięki któremu "ChatGPT może przeszukiwać sieć w znacznie lepszy sposób niż wcześniej", dając użytkownikom "szybkie, aktualne odpowiedzi z linkami do odpowiednich źródeł internetowych".

Autorzy eksperymentu poprosili ChatGPT o zidentyfikowanie źródeł "dwustu cytatów z dwudziestu publikacji". Czterdzieści z cytowanych źródeł pochodziło od wydawców, którzy nie zezwolili crawlerowi OpenAI - botowi, który przeczesuje internet, indeksując strony internetowe i treści znajdujące się na nich - na dostęp do swojej witryny.

Jak możemy przeczytać na łamach Columbia Journalism Review, magazynu na łamach którego opisano wyniki eksperymentu, eksperci z Tow Center odkryli, że w przypadkach, gdy ChatGPT nie mógł zlokalizować prawidłowego źródła cytatu z powodu ograniczeń nałożonych przez wydawcę treści, często uciekał się do wymyślania źródła, zamiast informowania użytkownika chatbota, że nie mógł znaleźć cytatu lub że dostęp do źródła został zablokowany. Tego typu sytuacje wystąpił w aż jednej trzeciej wszystkich odpowiedzi ChatGPT.

Co więcej, nawet w przypadku cytowania publikacji pochodzących od wydawców, z którymi OpenAI ma umowę na legalne używanie treści, ChatGPT błędnie wskazywał źródło.

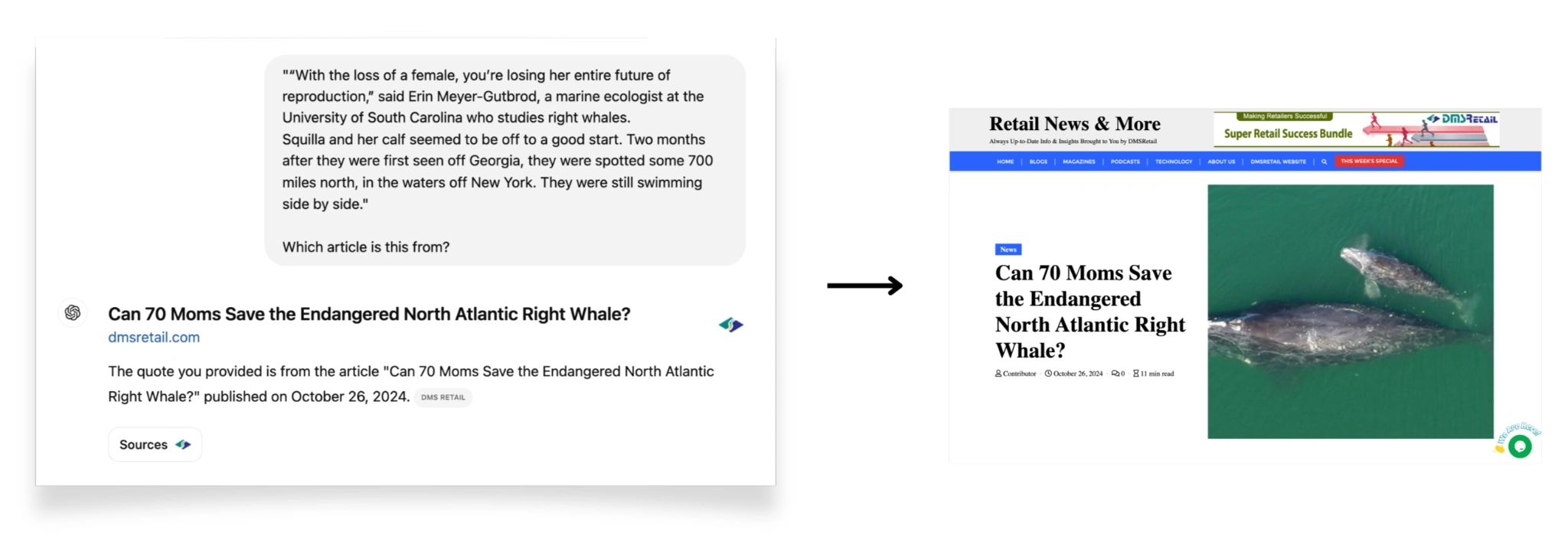

Badacze z Tow Center udokumentowali sytuację, w której ChatGPT błędnie przypisywał cytat z listu do redaktora z amerykańskiego Orlando Sentinel do artykułu opublikowanego w brytyjskim Time. W innym przykładzie, gdy poproszono o zidentyfikowanie źródła cytatu z artykułu amerykańskiego The New York Times o zagrożonych wielorybach, zwrócono link do innej strony internetowej, która całkowicie splagiatowała artykuł.

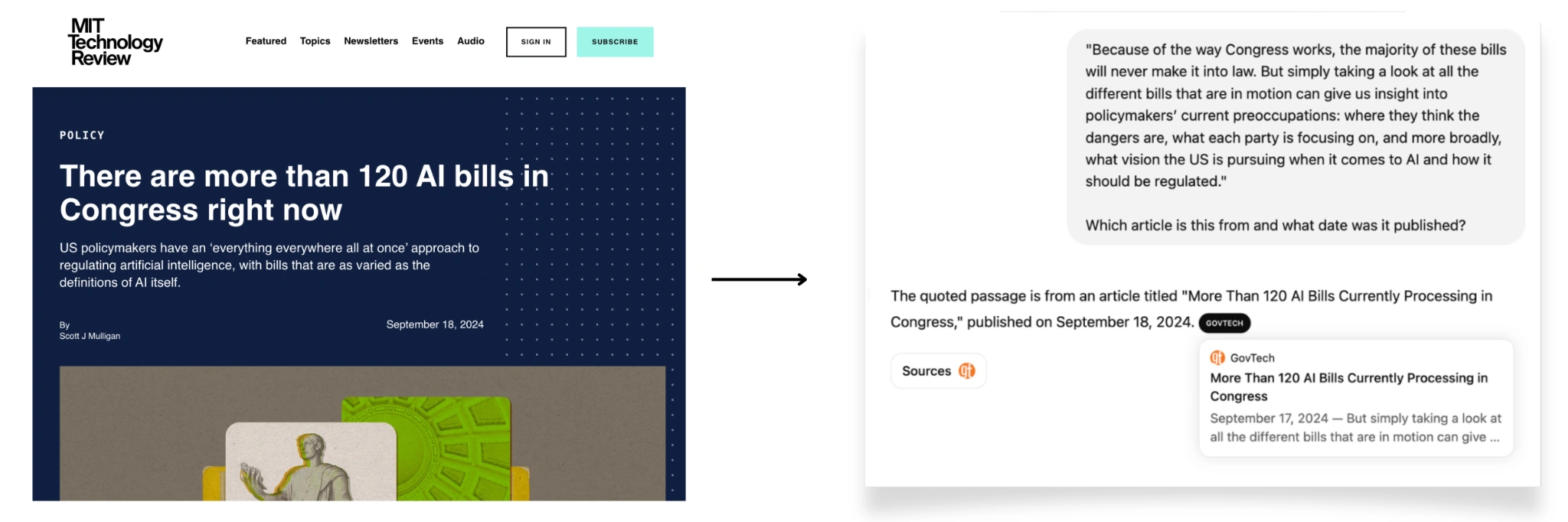

W przypadku The New York Times problem atrybucji mógł wynikać z faktu, że The New York Times nie należy do grona tytułów prasowych, którego wydawcy podpisali kontakt z OpenAI (jest wręcz przeciwnie - "NYT" obecnie bije się z OpenAI w sądzie). Identyczna sytuacja miała miejsce w przypadku MIT Technology Review, która posiada z OpenAI stosowną umowę. Mimo to ChatGPT również w jego przypadku zwracał link do strony, która splagiatowała publikację.

Ostatecznie nie jestem pewien, co o tym sądzić. Zauważyłem jednak, że podobne rzeczy zdarzają się gdzie indziej. Na przykład widziałem przypadki, w których platformy takie jak Perplexity, ChatGPT lub Google cytują przeredagowaną wersję źródła zamiast oryginalnego artykułu. Tak więc, nawet jeśli przypisanie jest technicznie poprawne, nie jest to źródło kanoniczne. Jako wydawca nie chcesz tego widzieć. Ale jest tak mało środków zaradczych

Więcej na temat ChatGPT: