Idealiści bywają bardziej niebezpieczni niż ci, którym zależy wyłącznie na zysku. Problem polega na tym, że wielu pracowników OpenAI oraz innych gigantów technologicznych karmi się naiwnym przekonaniem o uczestnictwie w wielkiej, dziejowej misji naprawy świata. Nieliczni, tacy jak Suchir Balaji, odchodzą. Przypadek Balaja, który miesiąc po ujawieniu nieprawidłowości w OpenAI został znaleziony martwy w tajemnicznych okolicznościach, to jednak wyjątek.

Sam Altman, CEO OpenAI, otwarcie porównywał rozwój sztucznej inteligencji do wyścigu zbrojeń, nazywając go współczesnym Projektem Manhattan. Jeśli jednak pójdziemy tropem tej atomowej metafory, musimy zapytać: czy najlepszą drogą rzeczywiście jest nieograniczony regulacjami wyścig oparty na ambicjach liderów? Warto pamiętać, że od 1945 roku broń jądrowa nie została użyta na polu bitwy właśnie dlatego, że ludzkość pojęła jej niszczycielską siłę i podjęła próby jej kontroli. Czy zatem Altman, dążąc do realizacji swojej wizji, zdobędzie się na podobną refleksję co Robert Oppenheimer, który przyznał kiedyś z goryczą, że stworzył potwora?

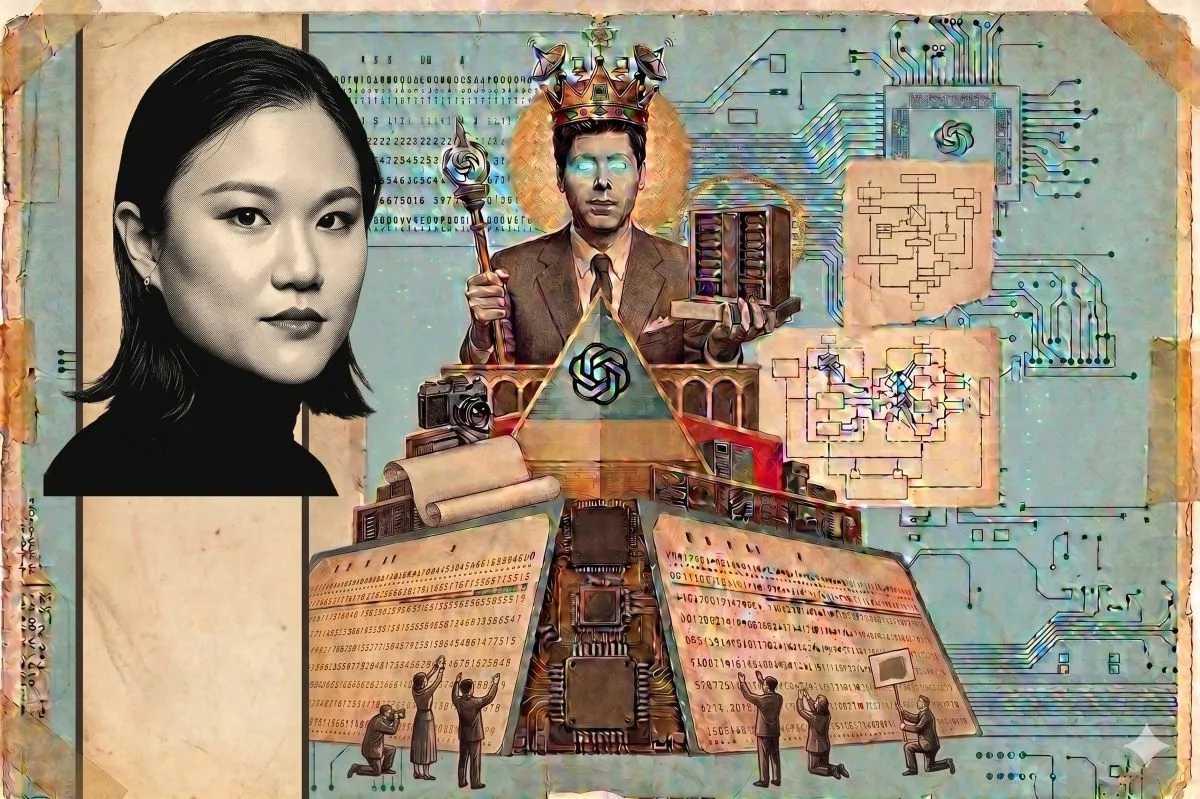

Z twórcami "potwora" spotkała się Karen Hao, dziennikarka i badaczka nowych technologii, która weszła w sam środek OpenAI. W naszej rozmowie pokazuje jak bardzo niebezpieczną firmą jest OpenAI.

Jej przełomowa książka "Imperium sztucznej inteligencji. Sny i koszmary w OpenAI Sama Altmana", wydana przez wydawnictwo Szczeliny w tłumaczeniu Piotra Grzegorzewskiego, to opowieść o potężnym ego liderów, religijnym kulcie wewnątrz firm i systemie, który drenuje zasoby planety szybciej, niż jesteśmy w stanie go kontrolować.

Sojusz firm technologicznych z autorytarną czy totalitarną władzą nie jest niczym nowym. Technofaszym kroczy w naszą stronę, nowe mroczne oświecenie staje się faktem. Nie jest za późno jeśli możemy jeszcze o tym rozmawiać.

Rafał Pikuła, autor wywiadu(z lewej) i Karen Hao, autorka książki "Imperium Sztucznej Inteligencji" (z prawej) podczas wywiadu w Warszawie. Fot. Rafał Pikuła

Karen, czytając Twoją książkę, odniosłem wrażenie, że to nie jest tylko kronika jednej firmy. Choć opisujesz kulisy OpenAI, kreślisz przy tym obraz całego ekosystemu Doliny Krzemowej – jego specyficznej ideologii i atmosfery. Dlaczego zdecydowałaś się na tę publikację i co ona dla Ciebie oznacza?

Kiedy zaczynałam nad nią pracować, OpenAI wcale nie miało być głównym tematem. Koncepcja zrodziła się jeszcze przed debiutem ChatGPT. Chciałam skupić się na historii sztucznej inteligencji oraz jej konsekwencjach: społecznych, środowiskowych i politycznych. Jednak premiera ChatGPT zmieniła wszystko. Stało się jasne, że ta firma zaczęła dyktować to, jak postrzegamy AI i jak może wyglądać jej przyszłość.

Chciałam napisać książkę, którą sama chciałabym przeczytać, zanim wybuchł ten cały szum medialny. Po sukcesie ChatGPT przestrzeń informacyjna stała się chaotyczna – nagle każdy ogłosił się ekspertem, często nie mając pojęcia o kontekście historycznym czy technologicznym. Moja książka ma być kompletnym przewodnikiem; publikacją, która pozwala prześledzić tę historię od A do Z, by czytelnik mógł świadomie uczestniczyć w debacie o przyszłości technologii.

To ważne, bo dziś dla wielu osób OpenAI stało się synonimem rewolucji AI. Pokazujesz jednak proces ambicjonalny: dążenie jednej firmy do tego, by stać się najpotężniejszym graczem na świecie. Czy odniosłaś wrażenie, że to był ich realny cel od samego początku?

Zdecydowanie tak. I trzeba przyznać, że do pewnego stopnia im się to udało. Moim zdaniem stało się to jednak kosztem społeczeństwa. Chciałam zdjąć z tej firmy maskę magii. Gdy ChatGPT wszedł na rynek, postrzegano go jako przełom dokonany przez najbardziej innowacyjnych ludzi świata, którzy w pełni zasłużyli na swoją dominację. Ja chciałam pokazać, że za tym sukcesem kryje się również ciemniejsza strona.

Pamiętam ten powszechny entuzjazm podczas premiery. Dziś, po kilku latach, widzimy, że wpływ gigantów takich jak OpenAI, Google czy Microsoft jest porównywalny z potęgą państw. Dość powiedzieć, że Microsoft, główny udziałowiec OpenAI, to firma, której technologie masowo wykorzystuje się do inwigilacji ludności np: w Gazie. Rozmawiałaś z mnóstwem osób, które tworzyły lub nadal tworzą tę organizację.Trudno było do nich dotrzeć? Chętnie dzielili się informacjami, czy musiałaś ich długo przekonywać?

Bywało różnie. Część osób zgadzała się od razu, bo znali moją pracę – w 2020 roku opublikowałam pierwszy duży profil OpenAI i wielu pracowników uznało, że rzetelnie oddałam rzeczywistość firmy. Innych musiałam namawiać miesiącami. Zawsze grałam w otwarte karty: mówiłam, że jestem krytyczna i nie zamierzam tego ukrywać, ale moim celem jest znalezienie odpowiedzi na pytanie, jak zarządzać technologią o tak ogromnej skali oddziaływania. Przypominałam im, że przecież oni sami trafili do OpenAI właśnie ze względu na tę wzniosłą misję.

No właśnie – misja. Dziś OpenAI kojarzy się raczej z modelem "closed" niż "open". Dlaczego Twoim zdaniem tak drastycznie od niej odeszli?

Jeśli zapytasz o to obecnych pracowników, większość z nich wcale nie przyzna, że firma zboczyła z kursu.

Naprawdę? Nadal w to wierzą?

Tak i to jest kluczowe dla zrozumienia tej organizacji. Z zewnątrz wydaje się oczywiste, że porzucili dawne ideały na rzecz zysku. Jednak wewnątrz działa silny mechanizm psychologiczny: ci ludzie funkcjonują w rzeczywistości, w której są przekonani, że każdego dnia tę misję realizują.

Czyli wierzą, że współtworzą coś wielkiego. Znam wielu programistów i widzę, że poczucie uczestnictwa w czymś wyjątkowym jest dla nich ogromnym paliwem. Czy w OpenAI to zjawisko jest jeszcze silniejsze?

Bez wątpienia. Dla wielu z nich to nie jest po prostu praca, to życiowe powołanie. To źródło potęgi tej firmy – pracownicy nie gonią tylko za pieniędzmi. Oni wierzą, że budują Cywilizację 2.0.

To brzmi niepokojąco. Ideologia bywa groźniejsza niż chęć wzbogacenia się. Czy ci ludzie dostrzegają w ogóle negatywne skutki tego wyścigu zbrojeń AI? Ostatnio Wired opisywał dylematy i dramaty pracowników firmy Palantir, którzy mają poczucie, że robią coś złego.

Tak, wielu moich rozmówców miało poważne dylematy moralne. Część z nich właśnie dlatego odeszła z firmy. Inni zostali, wierząc, że naprawią system od środka – że mając wgląd w procesy decyzyjne, zdołają skierować rozwój AI na właściwe tory. Często jednak po czasie dochodzili do wniosku, że ich wpływ jest iluzoryczny i de facto tylko legitymizują działania, z którymi się nie zgadzają. Oczywiście jest też grupa "prawdziwych wierzących", których nic nie powstrzyma przed realizacją ich wizji.

Czyli wracamy do ideologii. Chciwość zawsze napędzała Dolinę Krzemową, ale źle rozumiane poczucie misji wydaje się znacznie bardziej niebezpieczne. Na koniec muszę zapytać o polski wątek – w OpenAI pracuje wielu naszych rodaków. Czy miałaś okazję rozmawiać z którymś z nich?

Nie komentuję tego, z kim konkretnie się spotkałam podczas zbierania materiałów do książki [sylwetkę bliskiego współpracownika Altmana prof. Aleksandra Mądrego prezentowaliśmy na naszych łamach - przyp. red]. Na potrzeby książki przeprowadziłam ponad 300 rozmów z wieloma osobami z firmy, z każdego szczebla.

Wróćmy do momentu, od którego zaczynasz książkę – do próby odwołania Sama Altmana. Wiemy, że spora część kluczowych zespołów, w tym Polacy, murem stanęła za prezesem. Dlaczego tak się stało? Czy to była kwestia lojalności, czy czystej pragmatyki?

Złożyło się na to kilka kluczowych czynników. Po pierwsze – postać Grega Brockmana. Greg był niezwykle lojalny wobec Altmana i odszedł z firmy jako jeden z pierwszych w geście solidarności. Polscy pracownicy byli z nim bardzo blisko związani. Choć formalnie nie piastowali najwyższych stanowisk zarządczych, ich realny wpływ na firmę odbywał się właśnie przez Brockmana. To on był "pasem transmisyjnym" ich idei do zarządu. Wraz z jego odejściem straciliby swój główny kanał wpływu.

Po drugie – w grę wchodziły ambicje zawodowe. W tamtym czasie trwały rozmowy o objęciu przez niektórych z nich nowych, przywódczych ról, które były bezpośrednio powiązane z układem sił stworzonym przez Altmana. Nagłe usunięcie Sama zburzyło ten fundament. W tej sytuacji odejście i próba zbudowania czegoś nowego wydawały się im jedynym logicznym wyjściem.

Z dzisiejszej perspektywy można powiedzieć, że obstawili "właściwego konia". Ale dlaczego zarządowi w ogóle nie udało się go usunąć? Czy Altman jest już postacią zbyt potężną, by mogła upaść? A może to potężni inwestorzy z Doliny Krzemowej postawili weto?

Presja inwestorów była gigantyczna. Jasno zakomunikowali zarządowi: jeśli Altman nie wróci, odcinamy finansowanie. To postawiło firmę pod ścianą. Bez kapitału OpenAI groził paraliż technologiczny, a w najgorszym scenariuszu – całkowity upadek.

W grę wchodziły też gigantyczne pieniądze pracowników. Właśnie wtedy trwała oferta wykupu udziałów (tender offer). Gdyby inwestorzy się wycofali, pracownicy straciliby szansę na spieniężenie swoich akcji, co dla wielu oznaczało stratę milionów dolarów. Do tego doszedł efekt psychologii tłumu – firma rosła wtedy błyskawicznie, zatrudniano setki nowych osób, które nie rozumiały wewnętrznych gier politycznych. Widzieli tylko, że wszyscy podpisują list poparcia, więc robili to samo.

Jednak nie można pominąć autentycznej charyzmy Sama. On ma rzadką zdolność motywowania ludzi do pracy ponad siły. Jego ambicja jest zaraźliwa; sprawia, że ludzie czują, iż pracują na absolutnym szczycie ludzkich możliwości.

Jaki on jest prywatnie? To człowiek, którego da się po prostu polubić, czy raczej niedostępny wizjoner?

Myślę, że prywatnie to sympatyczny człowiek, ale dziś jest już zbyt „wysoko” w hierarchii, by pracownicy postrzegali go jako kolegę. To osoba bardzo skryta, dopuszczająca do siebie jedynie wąskie grono zaufanych ludzi. Nawet na szczeblu wyższej kadry zarządzającej relacje z nim mają charakter raczej zawodowy niż osobisty.

W Twojej książce pada mocna teza: OpenAI jest napędzane ego swojego CEO. To brzmi niebezpiecznie, gdy organizacja o takim wpływie na świat staje się de facto przedłużeniem ambicji jednego człowieka.

To prawda, ale bądźmy sprawiedliwi – OpenAI nie jest tu wyjątkiem. xAI Muska czy Anthropic działają w niemal identyczny sposób. To fundament kultury Doliny Krzemowej: "kult założyciela". Tam sukces firmy jest traktowany jako ostateczne potwierdzenie wartości człowieka. Tożsamość lidera i organizacji zlewają się w jedno.

Piszesz o AI od lat. Powiedz mi szczerze: czy Twoim zdaniem rozwój tej technologii zmierza dziś w złym kierunku?

Tak, zdecydowanie. Model AI, który dziś dominuje i który świat przyjął jako jedyny możliwy, jest najbardziej eksploatacyjnym systemem, jaki można sobie wyobrazić. To model oparty na bezwzględnej ekstrakcji: konsumuje niewyobrażalne ilości energii, centralizuje władzę w rękach nielicznych i ma charakter niemal imperialny.

Masz na myśli "karmienie" modeli treściami bez zgody autorów?

To tylko wierzchołek góry lodowej. Prawdziwa cena tej technologii to wyzysk ludzi, dewastacja środowiska i szerokie konsekwencje zdrowotne oraz społeczne.

Weźmy wyzysk: przecież to byłoby galopującego rozwoju AI bez nisko opłacanych pracowników na całym świecie zajmujących się żmudną anotacją danych. Także istnienie wielkich centrów danych to gigantyczne ilości energii i wody – zasobów, które są przecież ograniczone. Rozwój AI to także niszczenie środowiska, miejsc pracy i więzi społecznych. To ogromny dług, który zaciągają bogacące się firmy, a spłacać będzie społeczność.

To, o czym mówisz – zużycie zasobów i drenaż planety – wydaje się dziś nawet poważniejszym problemem niż kwestie praw autorskich. Czy w ogóle możliwa jest rewolucja AI, która nie niszczy środowiska?

Jak najbardziej. Przykładem może być AlphaFold od DeepMind – system przewidujący strukturę białek. To gigantyczny wkład w naukę, który przyniósł twórcom Nagrodę Nobla, a jednocześnie jego rozwój nie wymagał tak bezwzględnej dewastacji zasobów.

Skoro więc istnieje alternatywna droga, dlaczego jako ludzkość wybieramy tę bardziej destrukcyjną?

To fundamentalne pytanie. Odpowiedź jest jednak prosta: kierunek rozwoju technologii wyznaczają ci, którzy dysponują władzą i kapitałem. Oni wybierają model, który pozwala im tę władzę konsolidować. Dlatego nazywam to podejściem "imperialnym". Tu nie chodzi tylko o postęp, ale o dominację – o to, by być numerem jeden i rozszerzać swoje wpływy na każdą możliwą dziedzinę życia.

Brzmi to jak proces, na który nie mamy wpływu. Co w takiej sytuacji może zrobić zwykły człowiek? Jak możemy zareagować na fakt, że AI pożera naszą energię i wodę?

Każdy z nas styka się z łańcuchem wartości AI na wielu płaszczyznach. Jesteśmy źródłem danych, konsumentami, pracownikami, a wreszcie obywatelami wybierającymi polityków. Na każdym z tych poziomów mamy prawo głosu.

Możemy ograniczać udostępnianie prywatnych danych – ja sama zamknęłam konta w mediach społecznościowych. Możemy kontrolować, gdzie publikujemy treści i wprowadzać do umów zapisy zakazujące wykorzystywania naszej pracy do trenowania modeli. Jako pracownicy możemy działać zbiorowo, tworząc związki zawodowe wpływające na politykę firm. Widzimy już przecież protesty społeczności lokalnych przeciwko budowie centrów danych i one realnie uderzają w gigantów. Wreszcie jako użytkownicy możemy świadomie wybierać rozwiązania typu open source, które nie wspierają bezpośrednio monopolu największych korporacji.

To wszystko wymaga jednak ogromnej wiedzy. Większość ludzi po prostu korzysta z narzędzi i nie zastanawia się nad ich kosztem.

Dlatego edukacja i budowanie świadomości są kluczowe – to był jeden z głównych powodów, dla których napisałam tę książkę. I wbrew pozorom, to się już dzieje.

W USA około 80 proc. społeczeństwa deklaruje obawy związane z rozwojem AI. Podczas mojej trasy autorskiej odwiedziłam kilkadziesiąt miast i niemal wszędzie te dyskusje były bardzo żywe. Ludzie w restauracjach czy hotelach mają dziś wyrobioną opinię na temat sztucznej inteligencji. Ta fala świadomości wkrótce dotrze także do Europy.

Na koniec zapytam o wizje przyszłości. Czy wierzysz w nadejście AGI (sztucznej ogólnej inteligencji) i tzw. osobliwości (singularity)? Niektórzy twierdzą, że jesteśmy o krok od tego momentu.

Szczerze mówiąc, trudno to ocenić, bo wciąż nie mamy jednej, powszechnie uznanej definicji AGI. Trudno stwierdzić, czy się do czegoś zbliżamy, skoro nie wiemy dokładnie, czym to „coś” ma być.

Z drugiej strony coraz częściej słyszy się, że jesteśmy bliżej pęknięcia bańki spekulacyjnej niż technologicznego przełomu.

Rzeczywiście, ryzyko, że mamy do czynienia z wielką bańką, jest realne. Dlatego to, co robimy teraz, jest tak istotne. Im bardziej te firmy napompują swoją infrastrukturę i przejmą więcej kapitału, tym dotkliwszy będzie ewentualny kryzys. Działania społeczne i próby ograniczania tej ekspansji mogą sprawić, że gdy ta bańka w końcu pęknie, upadek będzie mniej bolesny dla nas wszystkich.

Zobaczymy, co przyniesie przyszłość. Mam nadzieję, że zamiast modnych haseł, znajdziemy w AI realną i odpowiedzialną wartość. Dziękuję Ci bardzo za rozmowę.

Karen Hao: Dziękuję.

Najnowsze

Aktualizacja: 2026-05-25T11:53:06+02:00

Aktualizacja: 2026-05-25T11:36:29+02:00

Aktualizacja: 2026-05-25T10:46:55+02:00

Aktualizacja: 2026-05-25T10:30:07+02:00

Aktualizacja: 2026-05-25T09:21:05+02:00

Aktualizacja: 2026-05-25T08:34:18+02:00

Aktualizacja: 2026-05-25T07:57:28+02:00

Aktualizacja: 2026-05-25T07:25:51+02:00

Aktualizacja: 2026-05-25T07:08:17+02:00

Aktualizacja: 2026-05-25T07:00:00+02:00

Aktualizacja: 2026-05-25T06:25:00+02:00

Aktualizacja: 2026-05-25T06:20:00+02:00

Aktualizacja: 2026-05-25T06:10:00+02:00

Aktualizacja: 2026-05-25T06:05:00+02:00

Aktualizacja: 2026-05-25T06:00:00+02:00

Aktualizacja: 2026-05-25T05:41:22+02:00

Aktualizacja: 2026-05-24T16:20:00+02:00

Aktualizacja: 2026-05-24T16:10:00+02:00

Aktualizacja: 2026-05-24T16:00:00+02:00

Aktualizacja: 2026-05-24T09:45:00+02:00

Aktualizacja: 2026-05-24T09:30:00+02:00

Aktualizacja: 2026-05-24T09:15:00+02:00

Aktualizacja: 2026-05-24T09:00:00+02:00

Aktualizacja: 2026-05-24T08:45:00+02:00

Aktualizacja: 2026-05-24T08:30:00+02:00

Aktualizacja: 2026-05-24T08:15:00+02:00

Aktualizacja: 2026-05-24T08:00:00+02:00

Aktualizacja: 2026-05-24T07:45:00+02:00

Aktualizacja: 2026-05-24T07:30:00+02:00

Aktualizacja: 2026-05-24T07:15:00+02:00

Aktualizacja: 2026-05-24T07:00:00+02:00

Aktualizacja: 2026-05-23T16:50:00+02:00

Aktualizacja: 2026-05-23T16:40:00+02:00

Aktualizacja: 2026-05-23T16:30:00+02:00

Aktualizacja: 2026-05-23T16:20:00+02:00

Aktualizacja: 2026-05-23T16:10:00+02:00

Aktualizacja: 2026-05-23T16:00:00+02:00

Aktualizacja: 2026-05-23T16:00:00+02:00

Aktualizacja: 2026-05-23T12:24:45+02:00

Aktualizacja: 2026-05-23T09:45:00+02:00