– Dwa lata temu, kiedy w Europie przyjęto dyrektywę prawnoautorską, przepisy dotyczące eksploracji danych średnio kogoś interesowały. Wyobrażano sobie, że dotyczą sytuacji, kiedy zainteresowany jakimś tematem badacz chce ściągnąć tysiące pdfów od wydawcy magazynu naukowego, żeby zautomatyzować analizę wiedzy medycznej. Temat brzmiał niszowo i nie budziło większych dyskusji – tłumaczy Alek Tarkowski, dyrektor w fundacji Open Future.

Teraz już budzi i to nie byle jakie. Tak to już widać bywa przy aktach tworzenia, że na początku jest chaos.

Kiedy internet zalały "zdjęcia" papieża w kurtce od Balenciagi i obrazki wielopalcych humanoidów, Artstation, jedna z najważniejszych platform dla artystów cyfrowych, zmieniła się w pole partyzanckiej bitwy. Wkurzeni artyści zaczęli postować protestacyjne obrazki z przekreślonymi znakiem AI, domagając się zablokowania możliwość wgrywania na stronę tworów generowanych przez AI. Część się wyniosła, trzaskając wirtualnymi drzwiami. I choć artyści w tej sprawie nie zdziałali wiele (Artstation poszło tylko na ograniczone ustępstwa), to zobaczyli, że jest ich wielu. I że potrafią się organizować. Ruszyli więc na grubego zwierza.

Lenistwo bogaczy

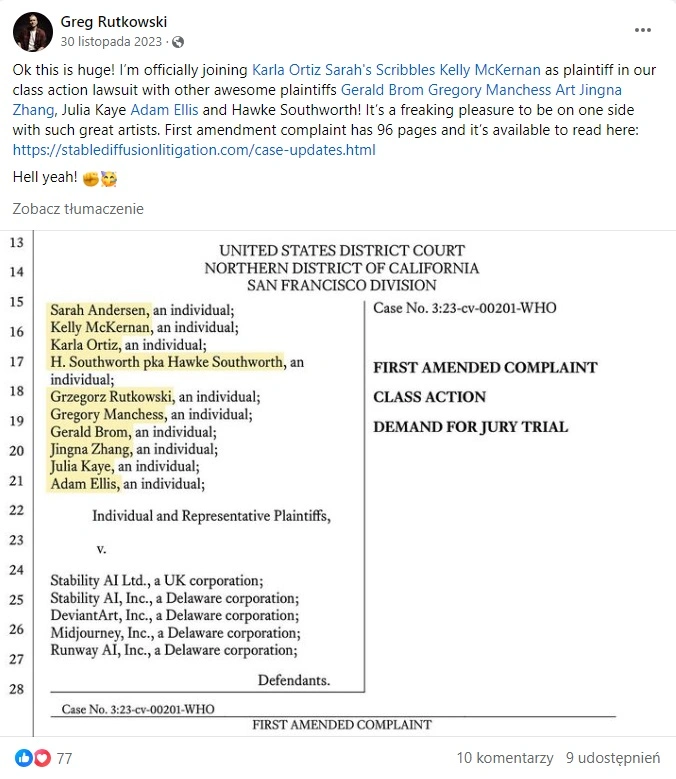

Wojenna ścieżka była już zresztą przetarta. W 2022 roku przeciwko Microsoftowi pozew złożyli programiści, a konkretniej Joseph Saveri i Matthew Butterick. Ten drugi od lat zajmujący się projektowaniem fontów, specjalnie po to odkurzył nawet swoją licencję prawniczą. Razem oskarżali w nim firmę o naruszenia własności intelektualnej i licencji open source przy tworzeniu Copilota, czyli sztucznej inteligencji mającej pomagać w kodowaniu. Artyści dołączyli do nich w styczniu 2023 roku. Wtedy to wystosowali pozew przeciwko Stability AI, Midjourneyowi i DeviantArtowi, w którym zarzucają firmom masowe łamanie praw autorskich. Narzędzia do generowania obrazów czy tekstów trenowane są na ogromnych bazach danych, które zawierają treści objęte prawami autorskimi, choć trudno powiedzieć, jakimi konkretnie.

Firmy zwykle nie chwalą się zawartości tych baz, ale niedawno do pozwu dołączono załącznik w formie listy zawierającej 16 tys. stylów, które Midjourney może reprodukować. Z nich ponad 4 tys. to nazwiska artystów. Są tam zarówno Warhol czy Frieda Kahlo, jak i Grzegorz Rutkowski czy Maciej Kuciara, czyli artyści żyjący, tworzący współcześnie i próbujący utrzymać się z owoców swojej pracy.

Lista ta robi się jeszcze ciekawsza w kontekście wywiadu, jakiego jeszcze w 2022 roku Forbesowi udzielił David Holz, CEO Midjourneya. Pytany o to, co robi w sprawie uznania praw autorskich twórców, tłumaczył, że “nie da się zebrać stu milionów obrazów i wiedzieć, skąd one pochodzą”.

Wyśledzenie nie automatyczne, czyli takie, które, studenci na całym świecie robią na co dzień, byłoby oczywiście zbyt kosztowe i czasochłonne dla wielkiej firmy, w końcu opóźniałoby cel nadrzędny: budowanie kapitału.

W czerwcu 2023 r. wydeptywana nogami artystów wizualnych i programistów ścieżka zaczęła zmieniać się w drogą szybkiego ruchu, kiedy pisarze Paul Tremblay i Mona Awad, złożyli pozew przeciwko Open AI i Mecie. Wtedy też opublikowany otwarty list podpisany przez ponad 15 tys. pisarzy a skierowany do szefów firm zajmujących się rozwojem generatywnej sztucznej inteligencji.

– "Sztuczna inteligencja oparta na dużych modelach językowych zawdzięcza swoje istnienie naszym tekstom. Naśladuje i reprodukuje nasz język, historie, styl i pomysły. Miliony chronionych prawem autorskim książek, artykułów, esejów i poezji posłużyły za pokarm sztucznej inteligencji, za te niekończące się posiłki nikt nie uregulował rachunku. Wydajecie miliardy dolarów na rozwijanie technologii AI, sprawiedliwie byłoby, gdybyście wynagrodzili nas za korzystanie z naszych tekstów, bez których sztuczna inteligencja byłaby banalna i bardzo ograniczona" – argumentują pisarze w liście.

We wrześniu, kiedy było już jasne, że sztuką epistolarną niewiele się wskóra, pisarze ruszyli do sądu. Przeciwko Open AI wystąpiło stowarzyszenie reprezentujące takie nazwiska jak John Grisham, Michael Chabon i George R.R. Martin. Ich pozew zarzucał firmie "systemową kradzież na masową skalę". Ale najcięższy przeciwnik dopiero miał się pojawić. 27 grudnia do gry wkroczył "New York Times".

W pozwie przeciwko Open AI i Microsoftowi wydawca jednego z najsłynniejszych tytułów świata stwierdza, że miliony artykułów opublikowanych w "New York Times", zostało wykorzystanych przy trenowaniu ChataGPT, który teraz konkuruje z wydawcą na polu dostarczania informacji.

– Byłoby świetnie, gdyby obrazy zawierały wbudowane metadane dotyczące właściciela praw autorskich lub coś podobnego, ale nic takiego nie ma, nie ma takiego rejestru. Nie ma możliwości znalezienia obrazu w Internecie, a następnie automatycznego wyśledzenia, kto jest jego właścicielem – tłumaczył wydawca dziennika cytowany przez “Forbes”.

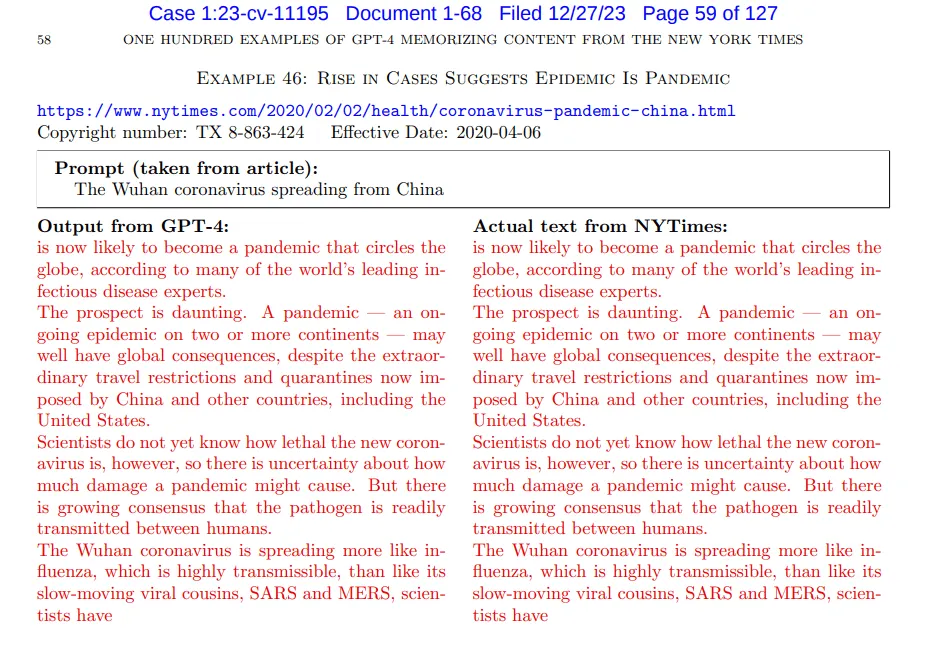

W pozwie wydawca przytacza liczne przykłady tego, jak ChatGPT odpowiada niemal słowo w słowo, przytaczając opublikowane na stronie "New York Times" artykuły. Media zarabiają na reklamach i subskrypcjach. Jeśli wystarczy do Chata wpisać widoczny w Google początek artykułu w "New York Times", żeby go przeczytać bez wchodzenia na stronę, oglądania reklam i płacenia za subskrypcję, to czemu tego nie zrobić. To może zabić wypracowany przed media model subskrypcyjny. Bing, zasilana tym samym AI wyszukiwarka Microsoftu, podaje recenzje z należącego do wydawcy Wirecuttera. Recenzje nie tylko nie wiodą do oryginalnego źródła, ale też pozbawione są linków afiliacyjnych, na których strona zarabia.

Dziennikowi udało się poddać w wątpliwość jedno z kluczowych stwierdzeń powtarzanych przez OpenAI. Mianowicie twierdzenie, że w ich modelu nie ma materiałów objętych prawami autorskimi, a czat owszem wykorzystuje do nauki rzeczy ze swoich przepastnych baz danych, ale potem przetwarza je, tworząc nową, niepowtarzalną jakość. Jednym słowem uczący się jak obdarzony zachwycającą pamięcią człowiek. Ale nawet człowiek miałby problem, gdyby opublikował spisany z pamięci cudzy artykuł.

– "New York Times" traktuje to jako dowód, że te treści siedzą w samym systemie Open AI. Obecnie, czy tak jest, nikt nie wie. Od strony technologicznej firmy nie chcą nam powiedzieć, co dokładnie się dzieje przy trenowaniu modeli, od strony prawnej sądy tego jeszcze nie przesądziły, bo wiele zależeć będzie od interpretacji zasady dozwolonego dostępu. Europejskie przepisy dają sporą swobodę uczenia AI, choć tu też diabeł kryje się w szczegółach i przepisy te nie zostały jeszcze sprawdzone w praktyce – tłumaczy Tarkowski.

Problem odwzorowywania "słowo w słowo" nie dotyczy tylko ChataGPT i wspomnianej gazety. W listopadzie zeszłego roku udało się pokazać, że z dużych modeli językowych da się wyciągnąć dane, na których były one trenowane, także niemal słowo w słowo. Podobnie rzecz ma się z obrazami. W grudniu opublikowano artykuł, w którym autorzy pokazują, jak przy pomocy Midjourneya v6 bez problemu generują obrazy objęte prawami autorskimi, nawet bez potrzeby wpisywania słów odnoszących się bezpośrednio do konkretnych postaci czy filmów. Na hasło "black armor with light sword, movie screencap" Midjourney produkował obrazki z Darth Vaderem, "animated toys" - fotosy jak z Toy Story, "protocol droit from classic sci-fi movie" - kultowe roboty z filmów George'a Lucasa. Firmy bronią się, że to tylko błędy i wypaczeniu systemu, które zaraz zostaną załatane, ale trudno to zweryfikować, nie wiedząc, jak tak naprawdę działają. Dlatego w pozwach Tarkowski upatruje nadziei.

– Te procesy to są jedyne narzędzia, dzięki którym czegoś się potencjalnie dowiemy o bazach danych tych firm i procesie treningowym – wyjaśnia ekspert.

"New York Times" razem między innymi z "Guardianem", Agencją Reutera i CNN zablokowało możliwość scrapowania (pobierania) danych ze swoich stron. Do tego wydawca w pozwie domaga się zniszczenia modeli, które były trenowane na chronionych prawami autorskimi materiałach. Open AI odniósł się do pozwu dziennika na blogu, uznając go za bezzasadny. Firmy tworzące generatywną AI twierdzą, że trenowanie ich modeli odbywa się w ramach tzw. dozwolonego użytku.

W Stanach Zjednoczonych, gdzie toczy się większość procesów, oznacza to, że choć ktoś narusza prawa autorskie, to robi to w ramach wolności ekspresji, a jego działalność ma pozytywne skutki dla społeczeństwa. Z dozwolonego użytku korzystają między innymi satyrycy i akademicy. Open AI argumentuje też, że "New York Times" wybrał tendencyjnie przykłady do pozwu i, żeby te uzyskać, specjalnie manipulował narzędziem. OpenAI przekonuje, że jego produkt jest narzędziem pracy dziennikarskiej, a sama firma wspiera media, o czym świadczą podpisane umowy o współpracy.

"New York Times" porusza też inną ważną kwestię w pozwie. Oskarża bowiem OpenAI o narażenie go na szkody wizerunkowe. ChatGPT miał wypluwać mijające się z prawdą informacje dotyczące treści artykułów gazety, wkładając dziennikarzom pod palce słowa, których nie wystukali. AI jest bowiem jak mało rozgarnięty nastolatek, próbujący za wszelką cenę zaimponować poznanej w barze dziewczynie - będzie udawał doskonale poinformowanego i pewnego siebie, ale jak czegoś nie wie, to po prostu to zmyśli. Nad tym, co czat wypluwa podpisane jako "New York Times", dziennikarze nie mają żadnej kontroli. A o tym, jakie szkody wizerunkowe może mieć oddanie zbyt dużej kontroli przy “wzbogacaniu” artykułu sztucznej inteligencji, można się już było przekonać.

W październiku do tekstu "Guardiana" o tragicznej śmierci młodej dziewczyny, który pokazał się w agregatorze newsów Microsoftu (Guardian ma podpisany z firmą umowę licencyjną, która pozwala na publikowanie tam tekstów) AI dodała quiz, pytający "Jak myślisz, jaka była przyczyna śmierci kobiety?" Odpowiadający mieli do wyboru morderstwo, wypadek lub samobójstwo. Na gazetę posypały się gromy, a oburzeni czytelnicy domagali się zwolnienia autora oskarżonego o całkowity brak wyczucia i empatii.

W lipcu podpisało taką z nimi Associated Press. W jej ramach wydawca dał firmie dostęp do archiwum newsów i zezwolił na wykorzystywanie świeżych newsów w czacie. W grudniu do podobnego porozumienia doszedł Axel Springer, do którego należy między innymi Politico, i który jest współwłaścicielem Business Insidera, "Newsweek Polska", Onetu czy "Faktu".

Kwota w ramach umowy opiewa na dziesiątki milionów euro.

Myszka Miki na cenzurowanym

Mimo zaangażowania w walkę z OpenAI amerykańskiego wydawcy trudno pozbyć się wrażenia, że jeśli chodzi o korporacje, które zwykle są bardzo wrażliwe na punkcie łamania praw autorskich, to jest zastanawiająco cicho. A mówimy o firmach takich jak Disney, który w 2006 roku orzekł, że wykucie Kubusia Puchatka na nagrobku zmarłego dziecka, będzie pogwałceniem praw autorskich firmy, a osoba, która to zrobi, może zostać pociągnięta do prawnej odpowiedzialności.

Ten sam Disney zresztą z takim zaangażowaniem bronił praw do innego swojego pupila, że prawo autorskie nazywane bywa w Stanach prześmiewczo Aktem Ochrony Myszki Miki. Ikona Disneya do publicznego dostępu trafiła dopiero w 2024 roku, ale tylko w wersji z filmu Steamboat Willie, odbiegającej od tej kojarzonej ze współczesnej popkultury. Ma on między innymi inne ręce, oczy i ogon i biada temu, kto o tym zapomni. Disney będzie się bowiem bacznie przyglądał, czy w powstających kreacjach – a zapowiedziano już co najmniej trzy horrory z kultową myszką w roli głównej – nie pojawią się zakazane elementy, za które można twórców pozwać.

Dlaczego prawnicy korporacji milczą w kwestii praw autorskich i generatywnej sztucznej inteligencji? Być może odpowiedź znajdziemy w czołówce serialu "Sekretna Inwazja". Disney do jej stworzenia wykorzystał właśnie generatywną sztuczną inteligencję. Potencjalnie rozwój tego narzędzia może być dla firm po prostu opłacalny. Sztuczna inteligencja potrafi generować dużo i szybko, nie bierze L4 i raczej prędko nie założy związku zawodowego. W tym kontekście Open AI maluje się raczej jako naturalny sojusznik firm, choć już niekoniecznie ich pracowników.

Trwające w zeszłym roku miesiącami protest aktorów i scenarzystów hollywoodzkich dotyczyły w kluczowych aspektach właśnie wykorzystania sztucznej inteligencji w branży filmowej. Może dlatego podpisanie przez Axela Springera umowy z Open AI było trzymane w tajemnicy przed pracownikami. Matthias Döpfner, CEO AS i szef należącego do firmy "Bilda", już zapowiedział swoim pracownikom, że zostaną oni zastąpieni przez AI.

Entuzjazm korporacji może także chłodzić niepewność dotycząca tego, kto właściwie ma prawa autorskie do utworów przez generatywną AI tworzonych: człowiek wpisujący prompt? Model? Firma model robiąca? A może nikt? Bethesda, twórca takich gier jak Skyrim czy Starfield, nie pozwala sprzedawać modów do swoich gier, jeśli są w nich materiały wyprodukowane przed generatywną AI.

Steam, największa platforma umożliwiająca sprzedawanie gier, właśnie w związku z tą niejasną sytuacją prawną w lipcu zapowiedział, że nie wpuści do swojego sklepu tytułów, które mają w sobie elementy generowane przez sztuczną inteligencję.

Firma dopiero 10 stycznia poluzowała swoje przepisy, czując na sobie presję ze strony konkurencji. Na razie jedynym organem, który wypowiedział się w kwestii praw autorskich do utworów tworzonych za pomocą gen AI, było Amerykańskie Biuro Ochrony Praw Autorskich. Orzekło ono, że dzieła wygenerowane przez AI nie podlegają ochronie praw autorskich, bo takie należą się tylko człowiekowi. O ironio, orzeczenie to zapadło w kontekście obrazu "Theatre D'opera Spatial", Jasona M. Allena, który we wrześniu 2022 roku wygrał ze swoim obrazem pierwszą nagrodę w konkursie organizowanym przez Colorado State Fair Fine Arts Competition.

Wygrana ta wstrząsnęła nie tylko światkiem artystów i techentuzjastów. Midjourney, który został wykorzystany do stworzenia obrazu, stał się gwiazdą pierwszych stron gazet i portali. Powstawały dziesiątki artykułów roztrząsający, czym jest sztuka, zgadujących czy zawód artysty wyginie, ale także coraz głośniej pytających, jak właściwie ten program działa i czy na pewno żadne etyczne i prawne zasady nie zostały przy jego tworzeniu złamane.

Zasady też sobie wygenerujemy

Dyskusje dotyczące wykorzystanie cudzej własności w internecie nie pojawiają się po raz pierwszy. Przechodziliśmy przez nie w między innymi w kontekście Napstera, Facebooka czy Google'a. Trudno też wyobrazić sobie, żeby nikt w samym Open AI lub wśród inwestorów firmy, do których należał choćby Microsoft, nie zdawał sobie sprawy z tego, że operują w sferze prawnie co najmniej kontrowersyjnej. A

Spowolnienie prac, żeby zastanowić się nad prawnymi kontrowersjami i być może choć część z nich rozwiązać zawczasu lub załagodzić, nie nastąpiło. Nie było negocjacji z posiadaczami praw autorskich do utworów, nie było nawet prób ich przeprowadzenia. Wręcz przeciwnie, premiera ChatGPT została gwałtownie przyspieszona, choć produkt nie był jeszcze w pełni gotowy do zaprezentowania rynkowi. Liczyło się co innego - ChatGPT 3.5 był pierwszy. I to zadziałało. Open AI jest firmą, z którą najbardziej kojarzy się generatywna sztuczna inteligencja, jest też firmą, która była wyceniana w październiku na 80 mld dol. Stać ją na prawników.

– OpenAI zachowało się jak typowy startup, czyli zgodnie z zasadą move fast and break things. Ich zadaniem było jak najszybsze skalowanie modelu biznesowego. Doszli do wniosku, że jak będą mieli duże zyski, to problem praw autorskich jakoś się uda rozwiązać – podsumowuje Dariusz Jemielniak, członek Rady Nadzorczej Fundacji Wikimedia.

Trudno jednak argumentować, że firmy i ich pracownicy w ogóle ignorują problem prawa autorskiego. Microsoft na początku września 2023 roku zapowiedział, że weźmie na siebie koszty ewentualnych pozwów wytaczanych użytkownikom Coplilota ze względu na pogwałcenie praw autorskich. Zaledwie półtora miesiąca później Ed Newton-Rex zrezygnował z kierowania zespołem w Stable Diffusion, bo, jak tłumaczył na X, nie zgadza się z tym, że trenowanie modeli generatywnych na utworach objętych prawami autorskimi mieści się w ramach definicji wolnego dostępu.

Dziś Open AI z jednej strony walczy w sądzie, z drugiej strony firma sama proponuje regulacje. Negocjuje umowy z największymi wydawcami takimi jak Axel Springer, choć, jak sama twierdzi, nie musi. Wprowadza opcję opt out, czyli wycofania domyślnej zgody na pobieranie od nas przez firmy danych do uczenia ich modeli. Wiele osób argumentuje jednak, że to przeciwna opcja opt in, czyli domyślnej niezgody, powinna być tą domyślną.

– Dlaczego mielibyśmy zakładać, że domyślne jest zgodzenie się na czerpanie z naszych zasobów? Równie dobrze moglibyśmy powiedzieć, że domyślnie się zgadzam, żeby ktoś publikował wszystkie moje dzieła i na nich zarabiał, a jakbym nie chciał, to muszę się zgłosić. Przecież to nonsensowne – przekonuje Jemielniak.

Ucieczka z gardła kanibala

Problem polega na tym, że OpenAI przestrzega, że nie da się szkolić dużych modeli językowych bez materiałów objętych prawem autorskim.

– Z uwagi na to, że obecnie prawa autorskie obejmują praktycznie każdy rodzaj ludzkiego wyrażenia, w tym blogi, fotografie, wpisy na forum, fragmenty kodu programistycznego i dokumenty rządowe, byłoby niemożliwe szkolenie najnowszych modeli sztucznej inteligencji bez korzystania z materiałów objętych prawem autorskim – pisze w dokumencie dla komisji ds. cyfrowych brytyjskiej parlamentarnej Izby Lordów.

Firma twierdzi, że ograniczenia się do książek, artykułów czy obrazów znajdujących się w wolnym dostępie stanowiłoby może ciekawy eksperyment, ale nie podstawę do stworzenia "systemów sztucznej inteligencji spełniających potrzeby obywateli dzisiejszych czasów". Ale nie wszyscy mają takie podejście jak Open AI. Inną strategię przyjęli choćby twórcy PLLuM-u ochrzoneczego już jako "polski ChatGPT". Maciej Piasecki, koordynator konsorcjum naukowego PLLuM w rozmowie ze Spider's Web deklaruje, że w swoim projekcie będzie chciał uniknąć łamania praw autorskich

– My chcemy wykorzystać to, co da się ściągnąć z Internetu, ale z poszanowaniem praw autorskich. To duży problem, bo wszystko co jest publikowane w Internecie bez oznaczenia, że jest to na licencji otwartej jest według polskiego prawa objęte licencją prywatną. A więc wykorzystamy to, co jest otwarte, czyli od Wikipedii począwszy, przez wszystkie otwarte książki, podręczniki, dokumenty, raporty, zapisy prac Sejmu i tak dalej – tłumaczy Piasecki

Ale nawet takie korzystanie z otwartych źródeł budzi kontrowersje.

– Kiedy Creative Commons tworzyło licencje, nie było jeszcze sztucznej inteligencji w takiej formie. Nie można udzielić licencji na polu eksploatacji, które nie istnieje w momencie tworzenia dzieła. Stąd pytanie, czy w ogóle można uznać, że dozwolony użytek stosuje się do treści wykorzystywanych do tworzenia modeli językowych. To jest nowe pole eksploatacji i potrzebne są na nim nowe regulacje. Jeśli "New York Times" wygra swój proces, to będzie miało daleko idące konsekwencje dla wszystkich. Może się ten rynek ucywilizuje – kontruje z nadzieją Jemielniak.

Wydawca zarzucając Open AI, że ChatGPT konkuruje bezpośrednio z dostarczycielami treści, ale nie przestrzega zasad, których musi trzymać się reszta branży, mówi o nieuczciwej przewadze konkurencyjnej na polu, na którym różnorodność jest kluczowa. Amerykański wydawca wróży upadek dziennikarstwa, które nie będzie mogło się utrzymać w walce z Big Techami i bez współpracy z wielkimi technologicznymi firmami. Można nie przepadać za współczesnymi mediami, ale bez nich zamiast newsów czy wywiadów będą informacje prasowe i oświadczenia. Zamiast reportaży przeklejki z Twittera czy Reddita. Zamist fact-checkingu halucynacje i trzecia Tishnerowska prawda.

Podobne obawy wyraża Jemielniak w kontekście Wikipedii, która odpowiada nawet za kilkanaście procent wkładu do modeli językowych.

– To, że ktoś będzie używał modelu językowego, żeby pozyskiwać wiedzę, nie jest dla nas problemem. Sęk w tym, że nie będzie przybywać osób redagujących. Jeśli korzystasz z LLM-ów, nie wiesz, że wiedza ci przekazywana pochodzi z Wikipedii. Nie ma żadnego linku do niej, nie ma informacji, że ty sam mógłbyś coś do niej wnieść. LLMy odcinają użytkowników i użytkowniczki od Wikipedii. A przecież chodzi o to, żeby gromadzona wiedza była aktualna, a do tego konieczne jest, żeby kolejne osoby dołączały i tworzyły Wikipedię – tłumaczy Jemielniak i dodaje, że "Wikipedia to wspólna encyklopedia ludzkości i jest ona teraz zagrożona".

Potrzebę utrzymania ludzkiego wkładu w źródła wiedzy i szerzej internet podkreśla też głośny artykuł naukowy "Klątwa rekursji: Trenowanie na wygenerowanych danych sprawia, że modele zapominają" z maja zeszłego roku. Jego autorzy korzystając z modeli matematycznych argumentują, że kiedy wielkie modele językowe będą odpowiadały za większość treści znajdujących się w internecie, modele trenowane na nich popadną w regres.

Dlatego warto pochylić się nie tylko nad literą prawa, które stworzone zostało w innych warunkach i z myślą o innych wyzwaniach, ale przede wszystkim przypomnieć sobie, po co ono jest.

– Prawo autorskie ma zachęcać ludzi do tworzenia, tworzyć ludziom warunki, żeby im się chciało tworzyć i umożliwiać im korzystanie z twórczości innych – przypomina Tarkowski.

Nie po to, żeby korporacje jak najszybciej i jak najtaniej mogły zdobywać kapitał. Jeśli do takich wniosków dojdziemy, to może rzeczywiście jest ono niepotrzebne.

Najnowsze

Aktualizacja: 2026-06-08T07:44:35+02:00

Aktualizacja: 2026-06-08T07:10:37+02:00

Aktualizacja: 2026-06-08T06:20:00+02:00

Aktualizacja: 2026-06-08T06:10:00+02:00

Aktualizacja: 2026-06-08T06:05:00+02:00

Aktualizacja: 2026-06-08T06:00:00+02:00

Aktualizacja: 2026-06-07T16:20:00+02:00

Aktualizacja: 2026-06-07T16:10:00+02:00

Aktualizacja: 2026-06-07T16:00:00+02:00

Aktualizacja: 2026-06-07T09:45:00+02:00

Aktualizacja: 2026-06-07T09:30:00+02:00

Aktualizacja: 2026-06-07T09:15:00+02:00

Aktualizacja: 2026-06-07T09:00:00+02:00

Aktualizacja: 2026-06-07T08:45:00+02:00

Aktualizacja: 2026-06-07T08:30:00+02:00

Aktualizacja: 2026-06-07T08:15:00+02:00

Aktualizacja: 2026-06-07T08:00:00+02:00

Aktualizacja: 2026-06-07T07:45:00+02:00

Aktualizacja: 2026-06-07T07:30:00+02:00

Aktualizacja: 2026-06-07T07:15:00+02:00

Aktualizacja: 2026-06-07T07:00:00+02:00

Aktualizacja: 2026-06-06T16:50:00+02:00

Aktualizacja: 2026-06-06T16:40:00+02:00

Aktualizacja: 2026-06-06T16:30:00+02:00

Aktualizacja: 2026-06-06T16:20:00+02:00

Aktualizacja: 2026-06-06T16:10:00+02:00

Aktualizacja: 2026-06-06T16:00:00+02:00

Aktualizacja: 2026-06-06T09:45:00+02:00

Aktualizacja: 2026-06-06T09:30:00+02:00

Aktualizacja: 2026-06-06T09:15:00+02:00

Aktualizacja: 2026-06-06T09:00:00+02:00

Aktualizacja: 2026-06-06T08:45:00+02:00

Aktualizacja: 2026-06-06T08:30:00+02:00

Aktualizacja: 2026-06-06T08:15:00+02:00

Aktualizacja: 2026-06-06T08:00:00+02:00

Aktualizacja: 2026-06-06T07:45:00+02:00

Aktualizacja: 2026-06-06T07:30:00+02:00

Aktualizacja: 2026-06-06T07:15:00+02:00

Aktualizacja: 2026-06-06T07:00:00+02:00

Aktualizacja: 2026-06-05T21:07:49+02:00