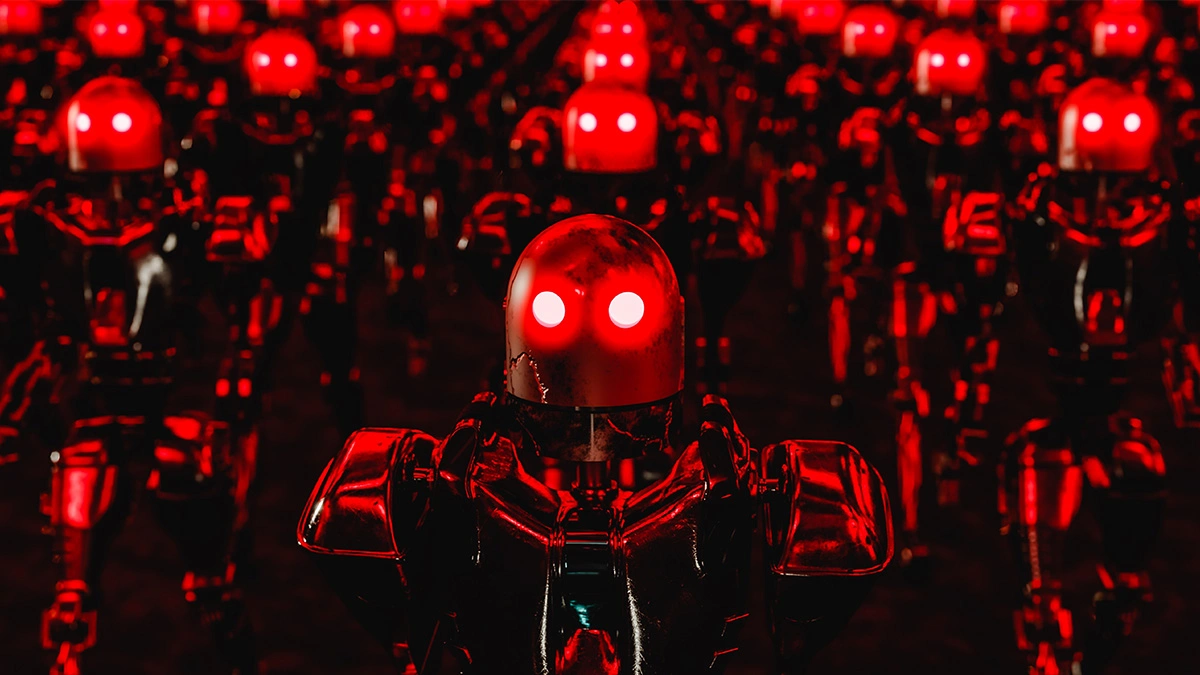

Apel stulecia - 300 liderów żąda wstrzymania wyścigu po boską AI

List otwarty przeciwko rozwojowi superinteligencji połączył świat nauki, religii i show-biznesu. Wszyscy mówią jednym głosem: nie ma zgody na wyścig, który może zakończyć się tragedią dla ludzkości

W jednym z najgłośniejszych dotychczas apeli dotyczących sztucznej inteligencji, ponad 300 wpływowych postaci świata nauki, technologii, mediów i religii podpisało się pod krótkim, ale jednoznacznym listem otwartym. Wzywają oni do całkowitego zakazu rozwoju tzw. superinteligencji - systemów AI zdolnych przewyższyć człowieka w większości zadań poznawczych. Apel poparli m.in. współzałożyciel Apple’a Steve Wozniak, laureat Nagrody Nobla Geoffrey Hinton, książę Harry i księżna Meghan, miliarder Richard Branson, a także ojciec Paolo Benanti - doradca papieża ds. AI.

Twórcy i krytycy AI wspólnie żądają zatrzymania rozwoju superinteligencji

Opublikowany przez Future of Life Institute (FLI) list został zatytułowany po prostu "Statement on Superintelligence” ("Oświadczenie w sprawie superinteligencji"). Jego autorzy - w zaledwie 1 zdaniowym manifeście - nie pozostawiają wątpliwości: dopóki nie będzie szerokiego konsensusu naukowego oraz poparcia społecznego, prace nad systemami, które mogłyby zdominować człowieka poznawczo, powinny zostać całkowicie wstrzymane.

Wzywamy do wprowadzenia zakazu rozwoju superinteligencji, który nie zostanie zniesiony przed osiągnięciem szerokiego konsensusu naukowego co do tego, że będzie to odbywać się w sposób bezpieczny i kontrolowany, oraz uzyskaniem silnego poparcia społecznego.

FLI powołuje się przy tym na swoje badania opinii publicznej w USA, z których wynika, że zaledwie 5 proc. ankietowanych popiera szybki, nieuregulowany rozwój AI, a aż 64 proc. uważa, że prace nad superinteligencją powinny być zawieszone do czasu zapewnienia ich bezpieczeństwa i kontroli.

Nikt, kto dziś tworzy te systemy, nie pytał ludzkości, czy to w ogóle w porządku. My zapytaliśmy. Odpowiedź była jasna: to nie do zaakceptowania

Sygnatariusze - reprezentujący często przeciwstawne ideologie i środowiska - argumentują, że obecny wyścig między firmami takimi jak OpenAI, Google DeepMind czy xAI, odbywa się bez społecznego upoważnienia tych firm i może prowadzić do poważnych konsekwencji: od utraty miejsc pracy i godności, przez ryzyko destabilizacji politycznej, po zagrożenie dla samego istnienia gatunku ludzkiego.

Musimy najpierw naukowo ustalić, jak projektować systemy, które będą fundamentalnie niezdolne do skrzywdzenia człowieka - ani przez błędy, ani przez celowe wykorzystanie. Potrzebujemy też o wiele silniejszego wpływu społecznego na decyzje o kierunkach rozwoju AI

Czytaj też: Noblista mówi, dlaczego AI może wysadzić ludzkość z siodła. "Liczą się tylko zyski"

W liście zwrócono także uwagę, że superinteligencja nie jest już tylko koncepcją z science-fiction, ale realnym, osiągalnym celem technologicznym - przynajmniej według wielu firm i badaczy. To pogląd kontrowersyjny, bo część ekspertów wciąż uważa, że od tego przełomu wciąż dzielą nas dekady rozwoju technologii.

AI ma już swoje za uszami

Jednak niezależnie, po której stronie barykady stoimy, ciężko nie uznać że generatywna sztuczna inteligencja - jakkolwiek "głupia" by nie była - już teraz miesza w naszym społeczeństwie i przynosi ze sobą ryzyko, na które ani my ani prawo nie byliśmy przygotowani. Wśród niepokojących zjawisk można wyróżnić choćby dezinformację, tworzenie deepfejków o charakterze pornograficznym, traktowanie generatorów tekstu jak rozumnych istot - prowadzące nawet do samookaleczeń, rozwodów, bezdomności czy hospitalizacji psychiatrycznej.

Uderza także to, kto się pod listem nie podpisał. Pod listem nie ma podpisu Elona Muska, który podpisał się pod bardzo podobnym listem - również opublikowanym przez Future of Life Institute (FLI) - dwa lata temu.

Nowy list różni się jednak nieco od tego sprzed dwóch lat: jego forma jest zwięzła, jego sygnatariusze ideologicznie bardzo różnorodni, a przesłanie bardziej bezkompromisowe. Autorzy nie proszą już jedynie o refleksję ani o "pauzę", a mówią wprost o całkowitym zaniechaniu rozwoju

Wielu ludzi chce potężnych narzędzi AI do rozwoju nauki, medycyny czy produktywności. Ale droga, którą dziś podążają firmy - wyścig do stworzenia AI mądrzejszej od człowieka - jest w rażącej sprzeczności z tym, czego chce społeczeństwo, co uważają za bezpieczne naukowcy i co uznają za moralne liderzy duchowi

Czy apel coś zmieni? Trudno powiedzieć. Ale jedno jest pewne: coraz większe grono wpływowych osób domaga się demokratyzacji decyzji o przyszłości AI. Ich zdaniem nie powinien o niej decydować wyłącznie Dolina Krzemowa - ani w próżni regulacyjnej, ani w imię technologicznego entuzjazmu.

Superinteligencja to bardzo modne słowo: