Korzystałem z Apple Intelligence w USA. Oto, co potrafi iPhone w kraju pierwszego świata

Apple Intelligence w wersji mobilnej nie działa w naszym kraju, ale wystarczy pojechać za ocean, żeby je uruchomić - i to na polskim Apple ID. Podczas wyjazdu do Stanów Zjednoczonych na CES 2025 miałem okazję przetestować sztuczną inteligencję rodem z Cupertino na iPhonie i iPadzie. Czy jest w ogóle, na co czekać?

Od lat firma Tima Cooka preferencyjnie traktuje klientów na swoim rodzimym rynku. Lata mijają, a my nadal nie mamy dostępu do asystenta głosowego w naszym języku, a usługi takie jak np. Apple News nie tylko nie doczekały się lokalizacji, ale są też przed nami ukrywane. Podobnie jest w przypadku Apple Intelligence, które w przeciwieństwie do konkurencyjnych SI opartym o LLM-y nie umie szprechać po polsku. No i do tego dochodzi jeszcze jedna kwestia: Apple, blokując AI na naszym terytorium, chciał zagrać na nosie Unii Europejskiej.

Czytaj inne nasze teksty poświęcone AI:

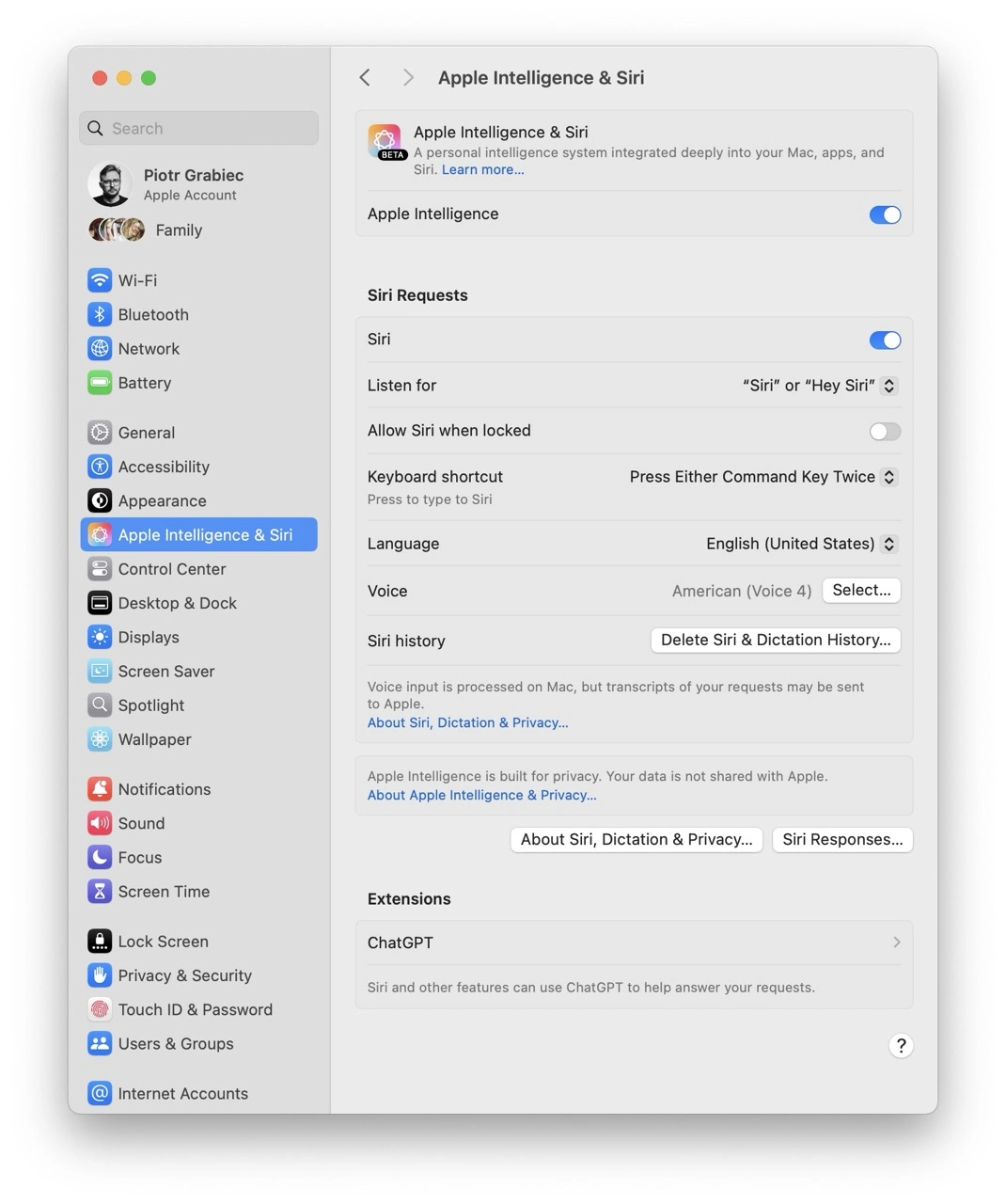

Apple uznał, że skoro urzędnicy firmie grożą kontrolami i karami, to nie wprowadzi na premierę AI na iPhone’ach i iPadach w naszym regionie wcale. AI rodem z Cupertino w Polsce można odpalić w rezultacie jedynie na Maku, który pod przepisy DMA się nie łapie, ale… trzeba zmienić cały język systemowy np. na amerykański angielski, gdyż nasz nie jest obsługiwany. W przypadku urządzeń mobilnych wystarczy jednak polecieć za ocean, aby dodatkowe funkcje się odblokowały (oczywiście po ustawieniu innego języka). I to na polskim Apple ID.

Jak uruchomić Apple Intelligence podczas wyjazdu do USA?

To akurat jest bardzo proste: wystarczy zmienić ten nieszczęsny systemowy język np. na wspomniany amerykański angielski i to w zasadzie tyle (tzn. w teorii, bo w praktyce musiałem jeszcze zrestartować iPhone’a, gdyż w wyniku błędu pojawiał się śmieszny komunikat, iż ten amerykański angielski wybrany dla iOS-a oraz dla Siri to dwa różne języki - ale po ponownym uruchomieniu urządzenia wszystko zaskoczyło). Potem telefon zaczął od razu pobierać niezbędne pliki.

To miłe, że Apple nie blokuje dostępu do AI wszystkim użytkownikom z polskim Apple ID, a pod uwagę bierze jedynie aktualną lokalizację. Dzięki temu mogłem przetestować na swoim głównym iPhonie, pełnym moich danych, czy w ogóle jest na co czekać. Firma z Cupertino dogadała się bowiem wreszcie z Unią Europejską i zacznie udostępniać Apple Intelligence na terenie Europy za kilka miesięcy (aczkolwiek nadal bez obsługi wszystkich języków wspólnoty, w tym polskiego).

Co się zmienia po aktywacji Apple Intelligence na iPhonie?

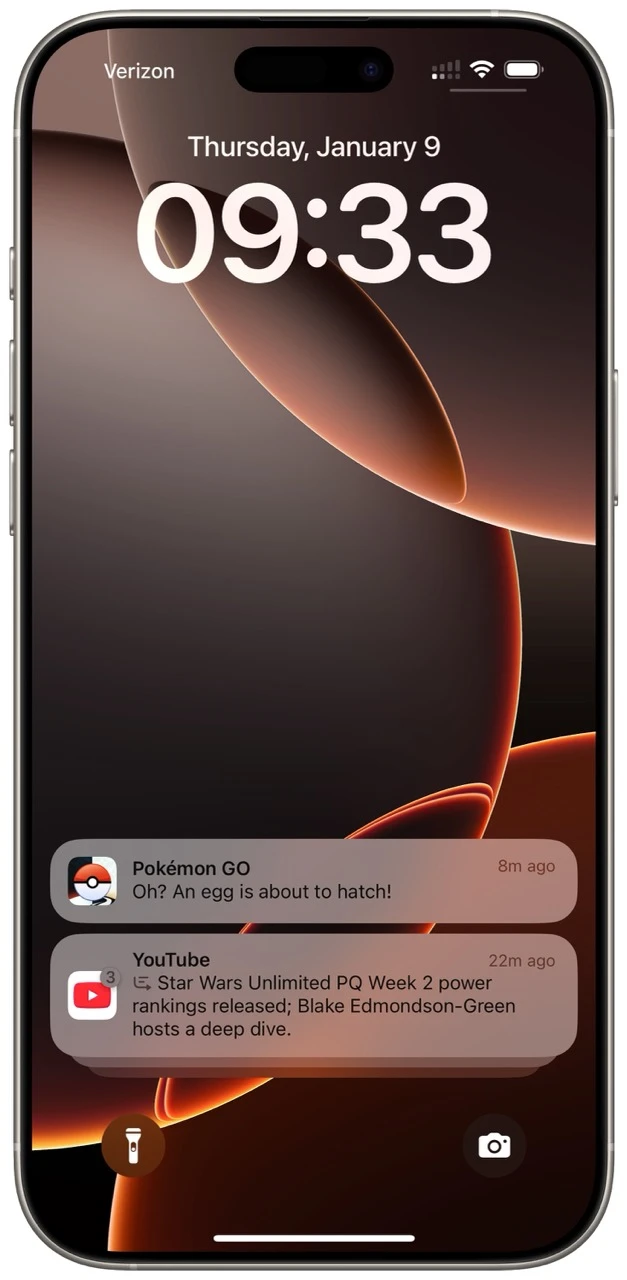

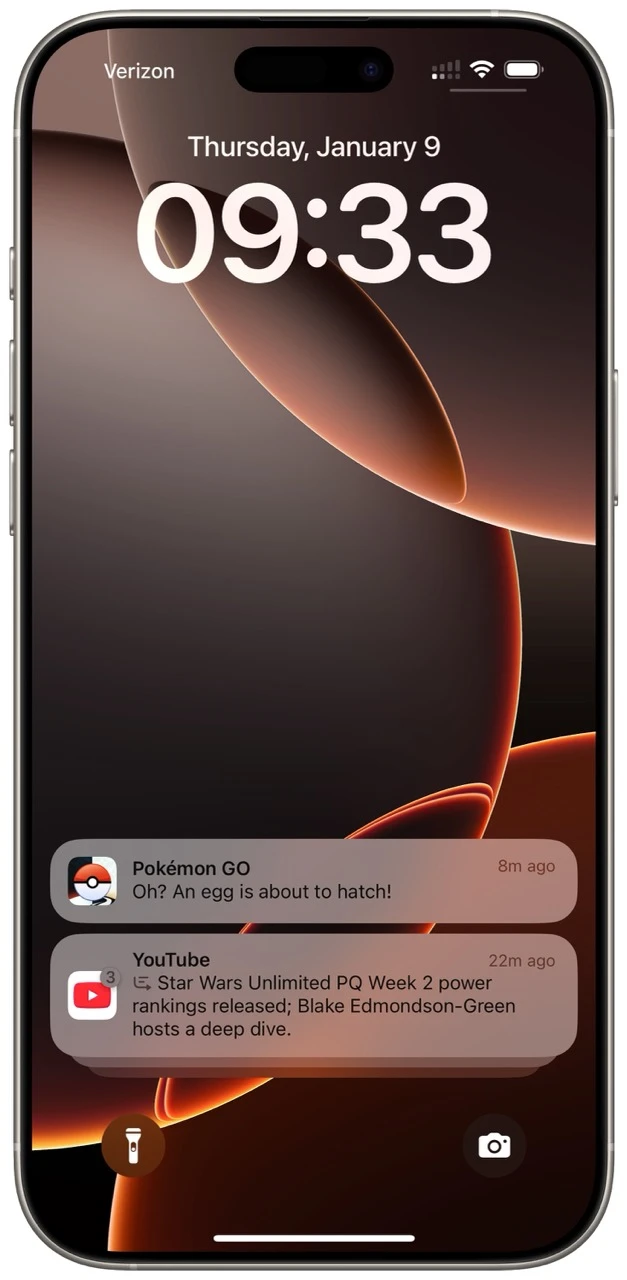

Po około kwadransie spędzonym na wolnym hotelowym Wi-Fi pliki potrzebne do uruchomienia lokalnej SI zostały pobrane, a iPhone zmienił się nie do poznania. Aplikacje, które dobrze znam, zaczęły sypać monitami, iż od teraz oferują nowe funkcje takie jak np. automatyczne segregowanie i streszczanie poczty. Mogłem też wybrać konkretne kategorie aplikacji, w których przypadku w Centrum Powiadomień grupa monitów będzie podsumowywana przez Apple Intelligence.

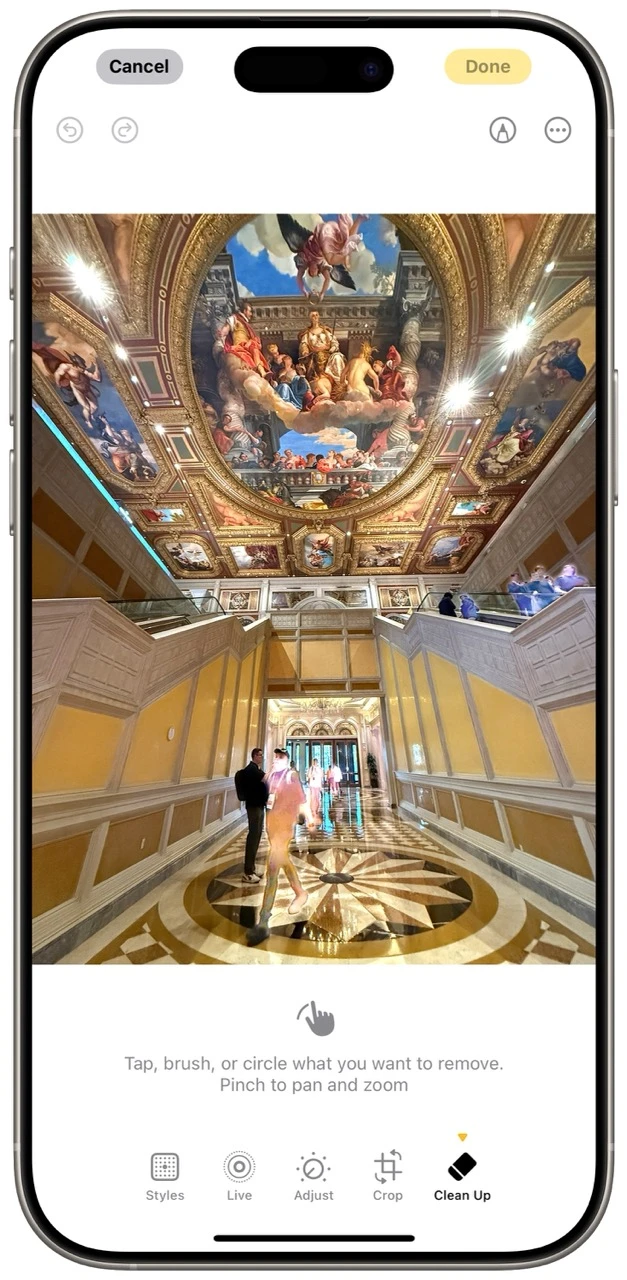

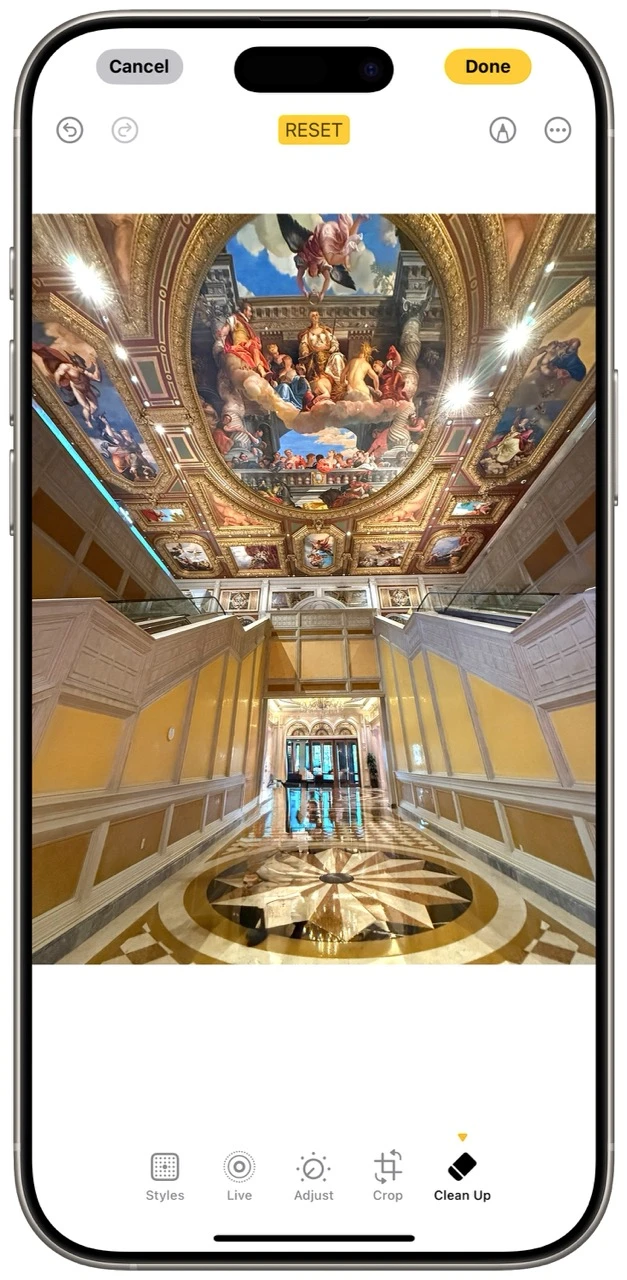

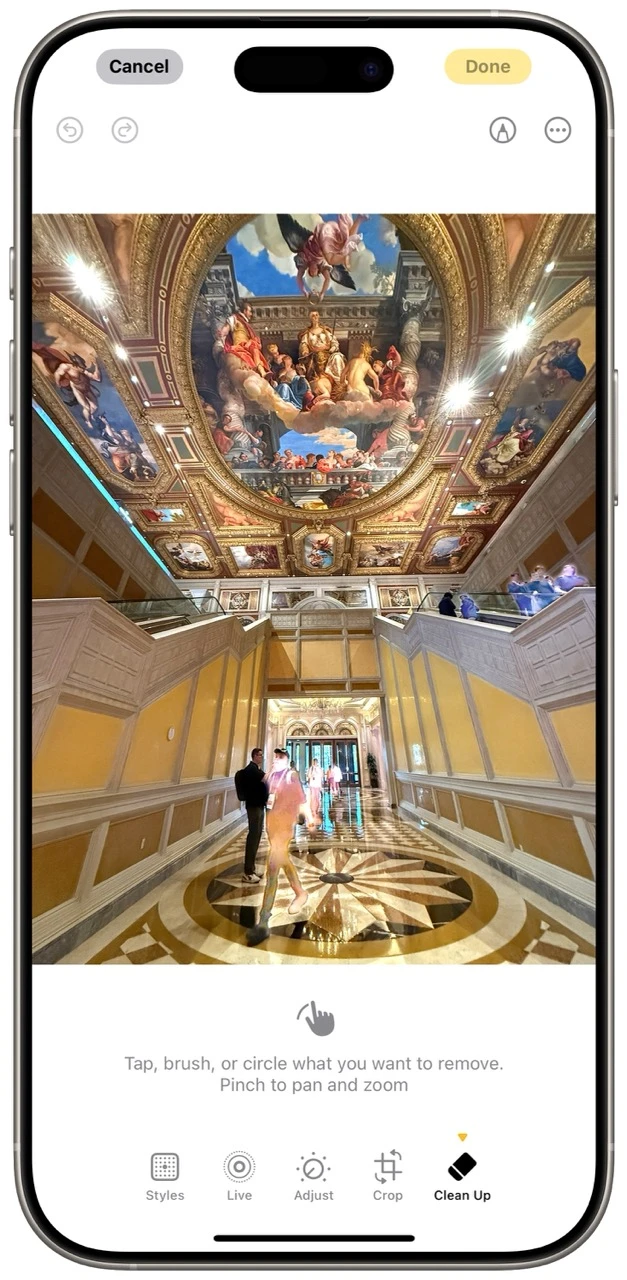

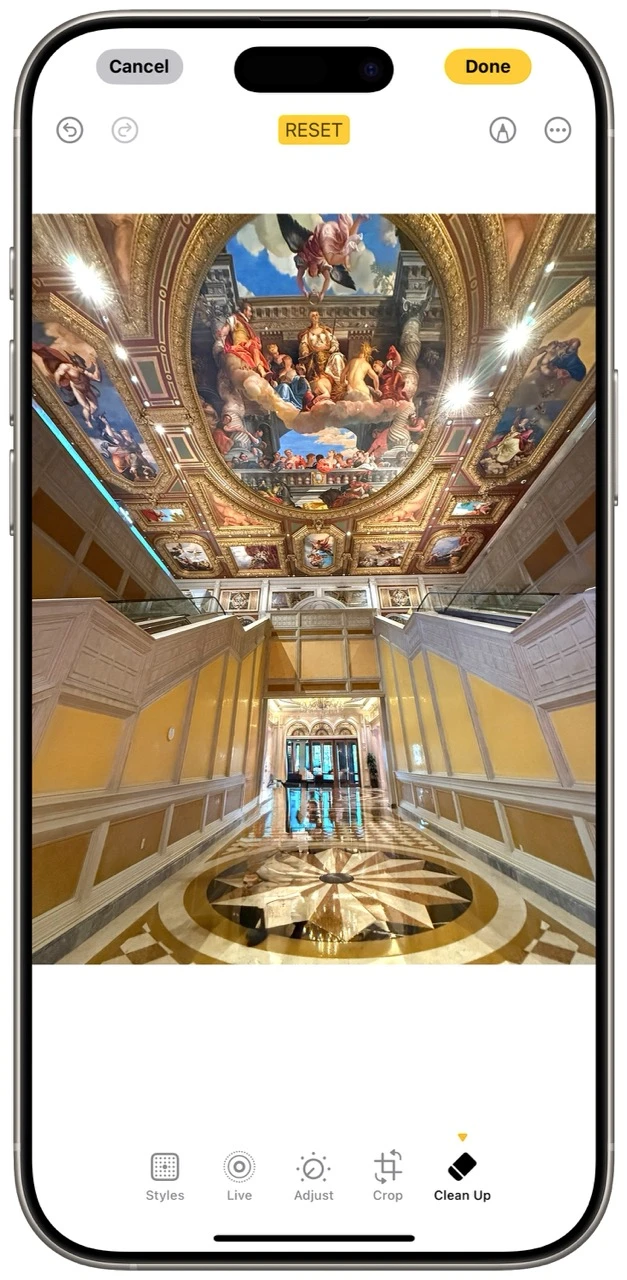

Oczywiście te dodatki działały tylko w przypadku treści anglojęzycznych, więc anglojęzyczne powiadomienia i maile były streszczane, a te polskojęzyczne - nie. Tak naprawdę na tych funkcjach językowych jednak mi jakoś mocno nie zależało, bo istotniejsza dla mnie jest opcja edycji zdjęć poprzez usuwanie z nich niechcianych elementów bezpośrednio w systemowej aplikacji. Działa to super, a na tym nowości w kontekście Zdjęć i Apple Intelligence się nie kończą.

Apka analizuje treść zdjęć i próbuje dawać podpowiedzi dotyczące tego, co na nich widzimy. Niestety nie działa to jak na razie zbyt dobrze, gdyż raz polski kościół uznany został za budynek z Hiszpanii, a innym razem SI myślało, że to budowla z San Francisco. Niestety takie pomyłki, zwane fachowo halucynacjami, to chleb powszedni tego typu usług, dlatego wszędzie widzimy komunikaty, iż podawane przez Apple Intelligence informacje należy weryfikować.

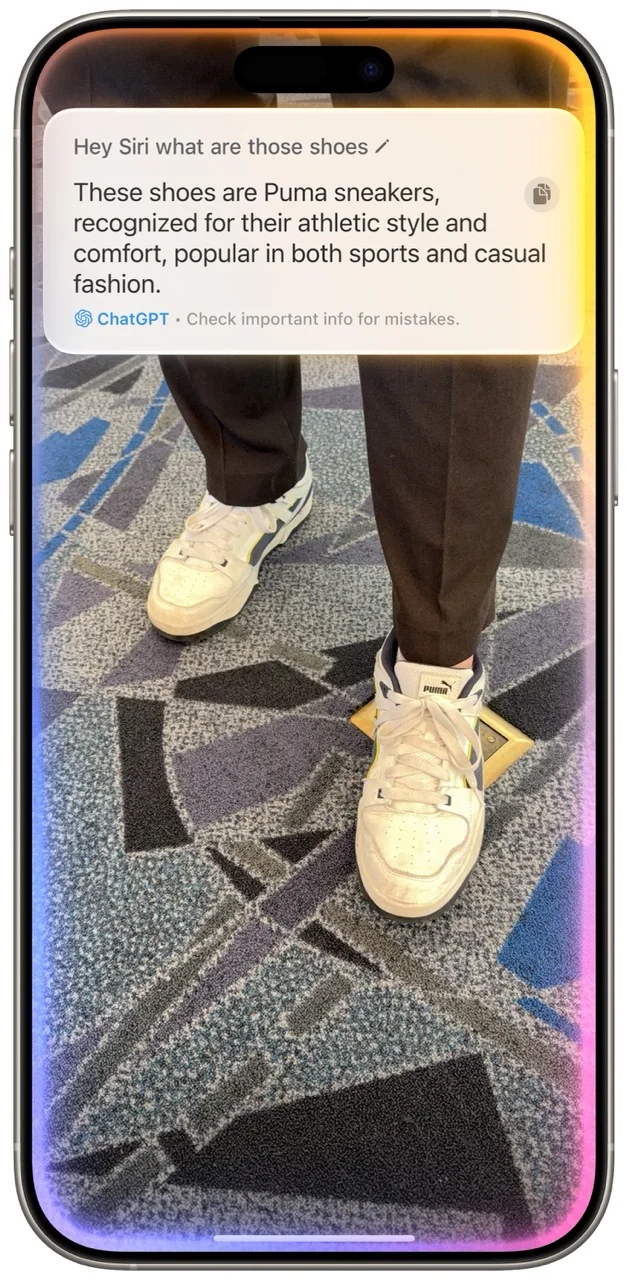

A jak działa to całe Visual Intelligence?

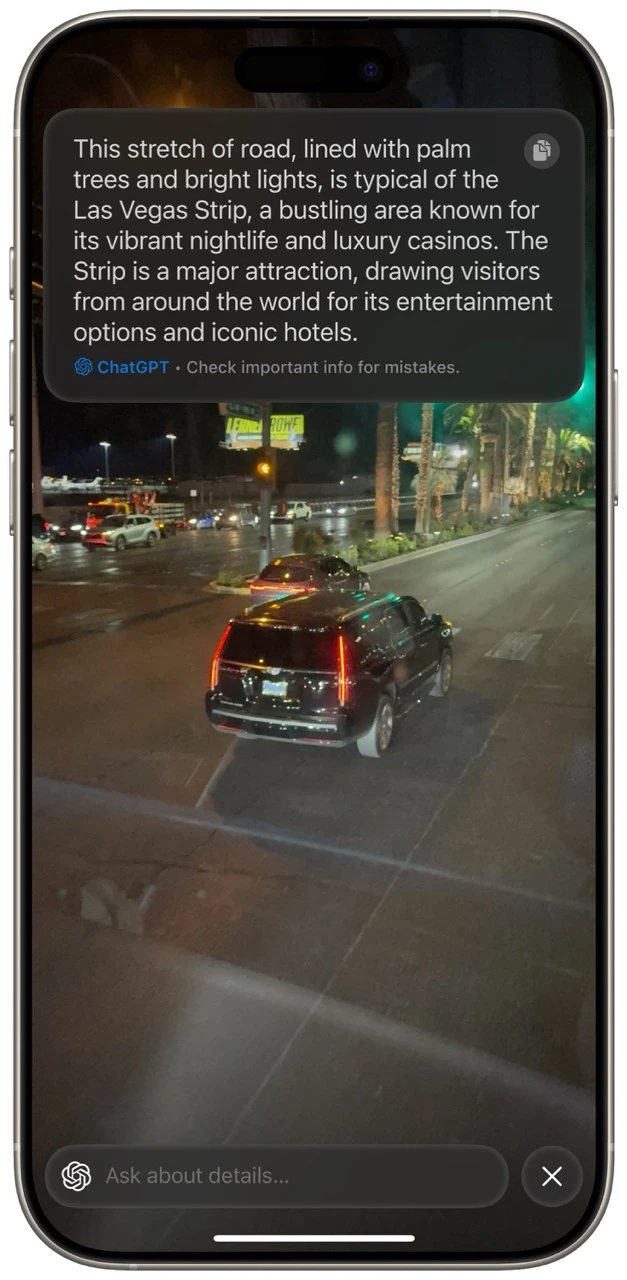

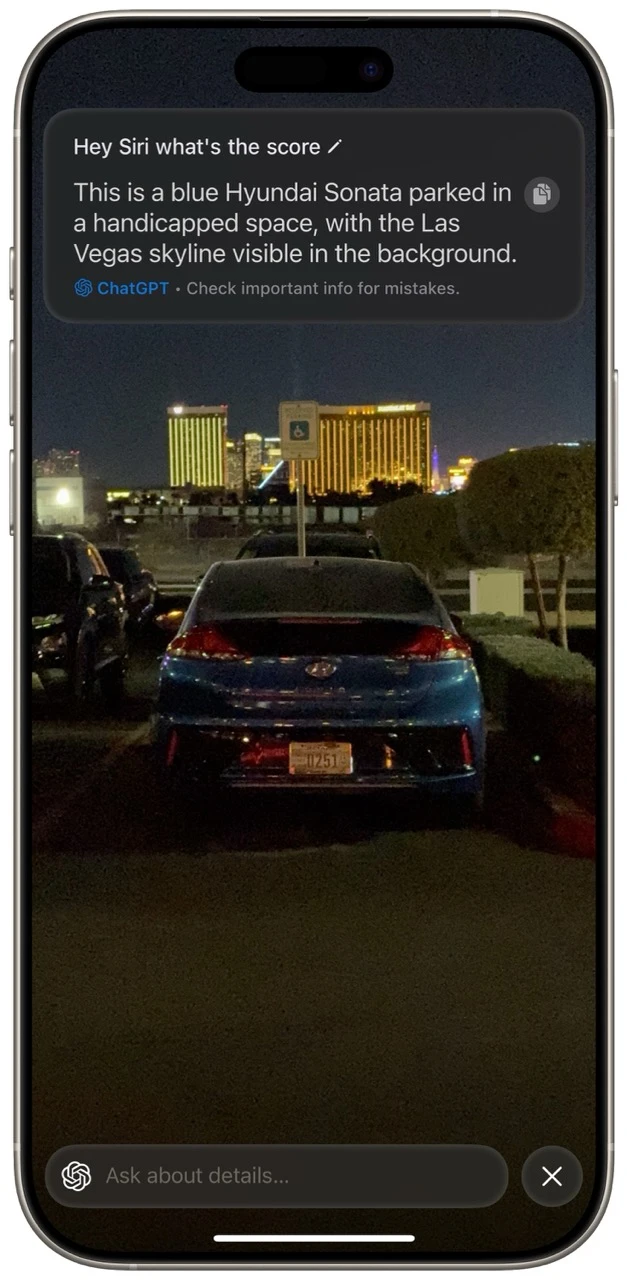

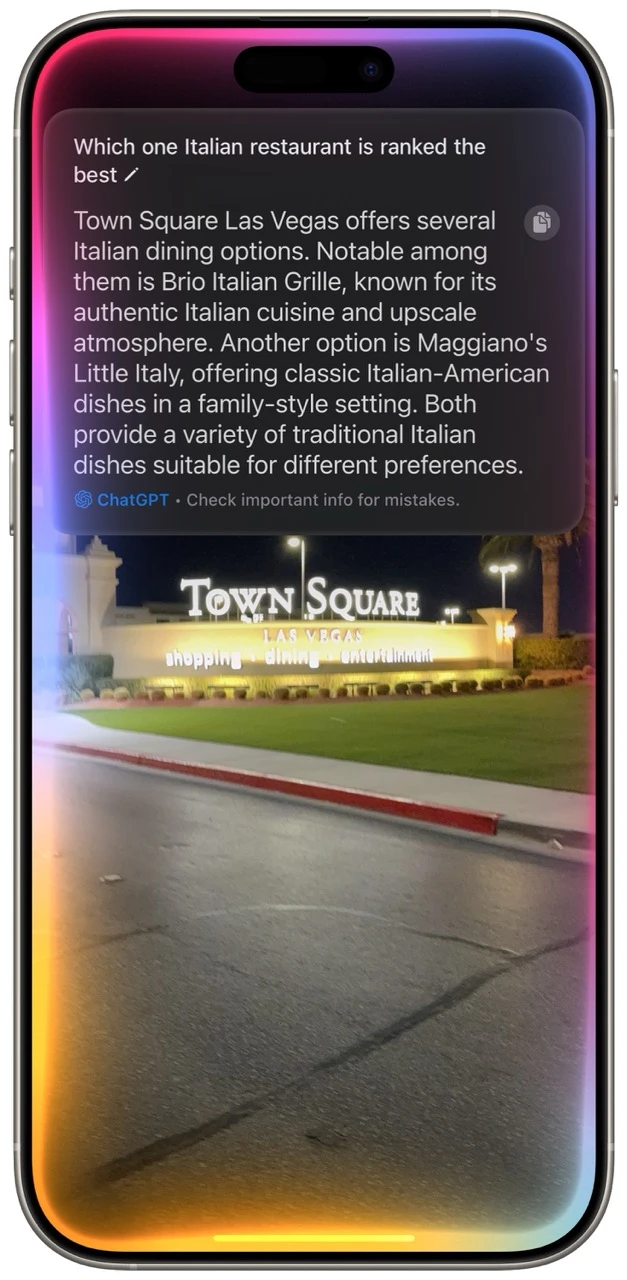

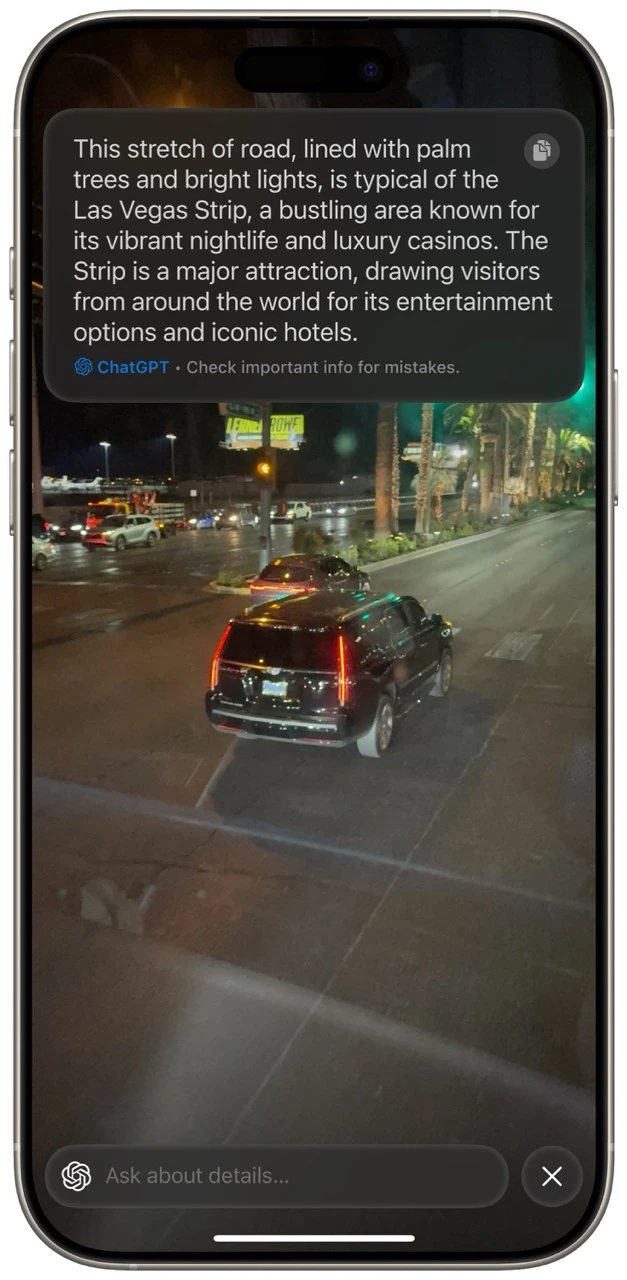

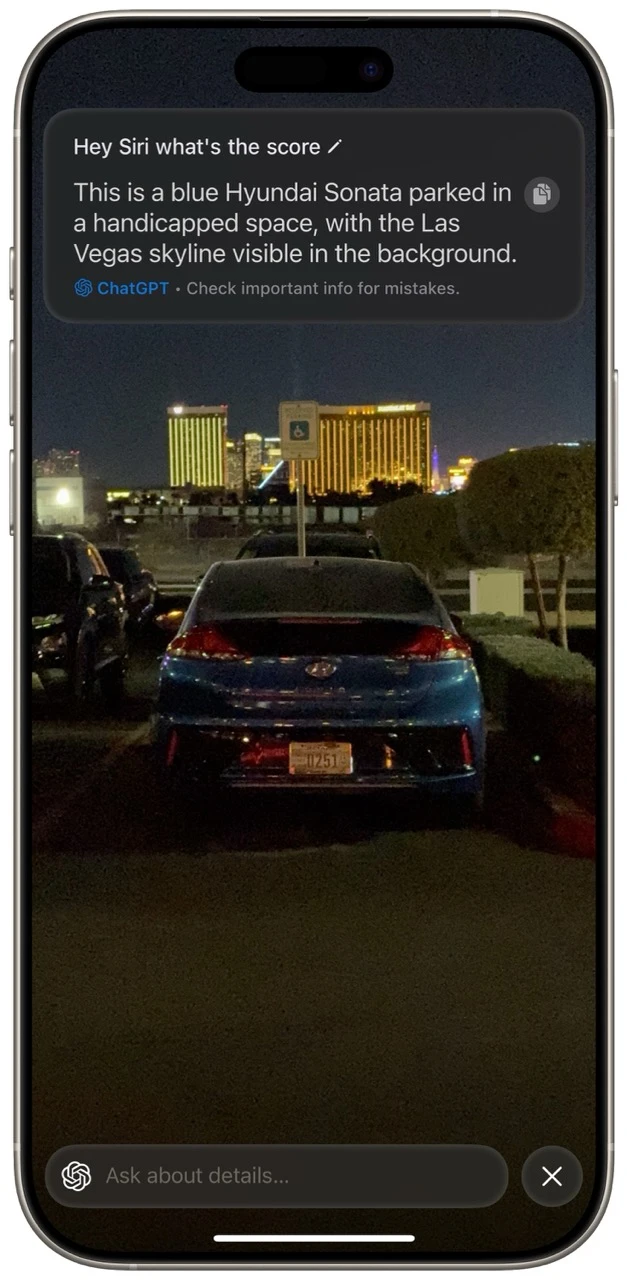

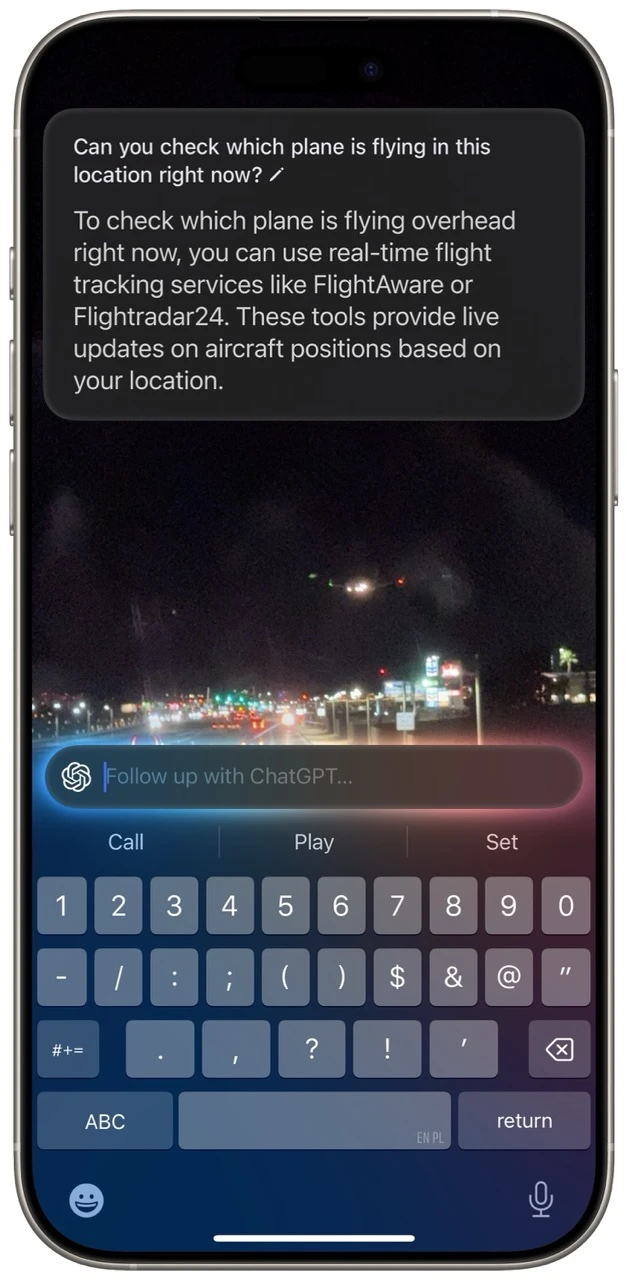

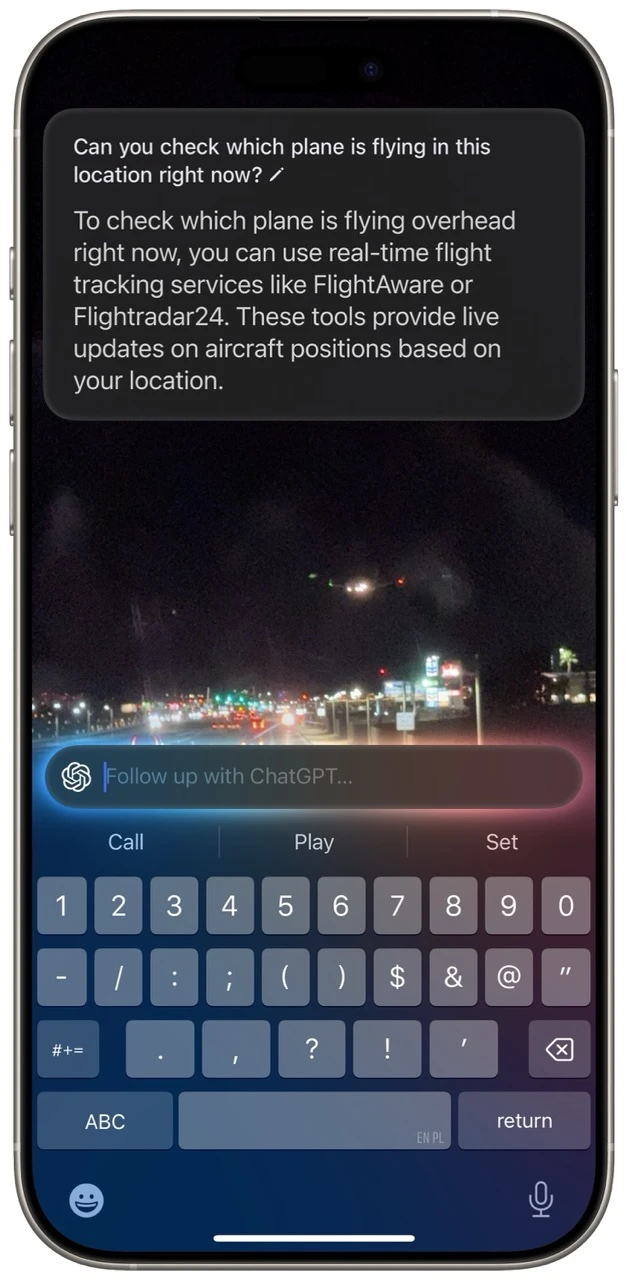

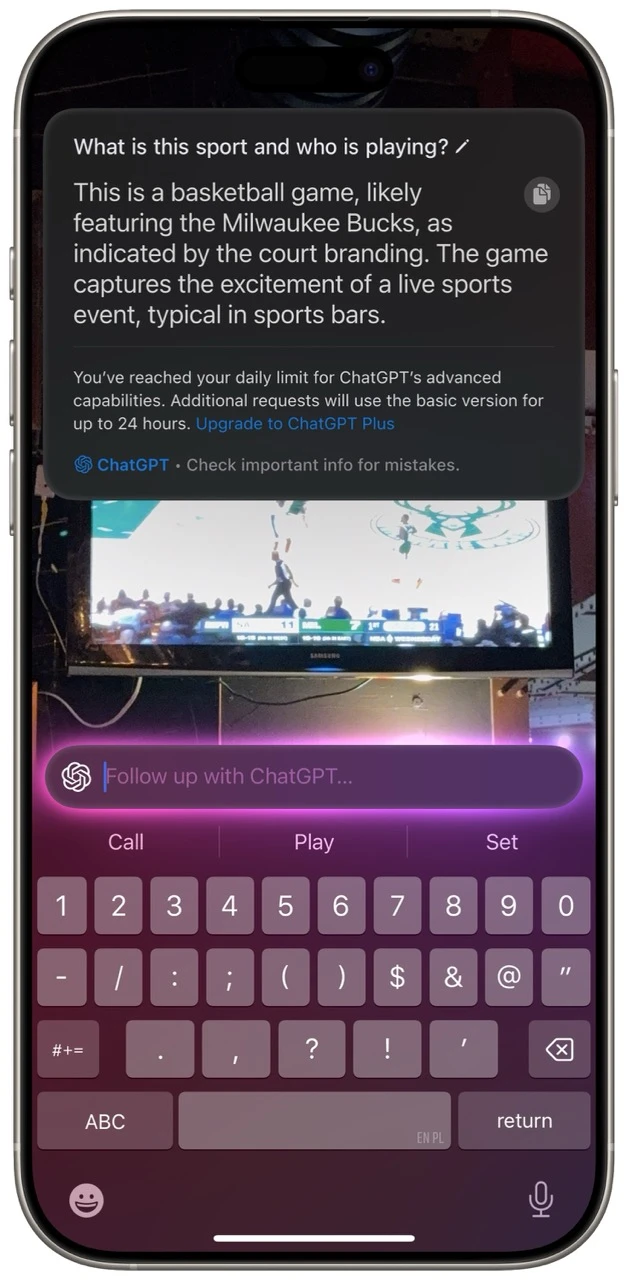

Jedną z głównych funkcji Apple Intelligence, która dodana została już po premierze nowego iOS-a, jest skanowanie otoczenia aparatem w telefonie. W tym celu należy dłużej przytrzymać guzik Camera Control z boku iPhone’a, co uruchomi podgląd, a następne Siri w połączeniu z usługą ChatGPT zacznie rozmyślać o tym, co aktualnie widzi obiektyw i dawać kontekstowe podpowiedzi. Do tego można zadawać pytania oraz wyszukiwać informacji na temat obrazu w Google’u.

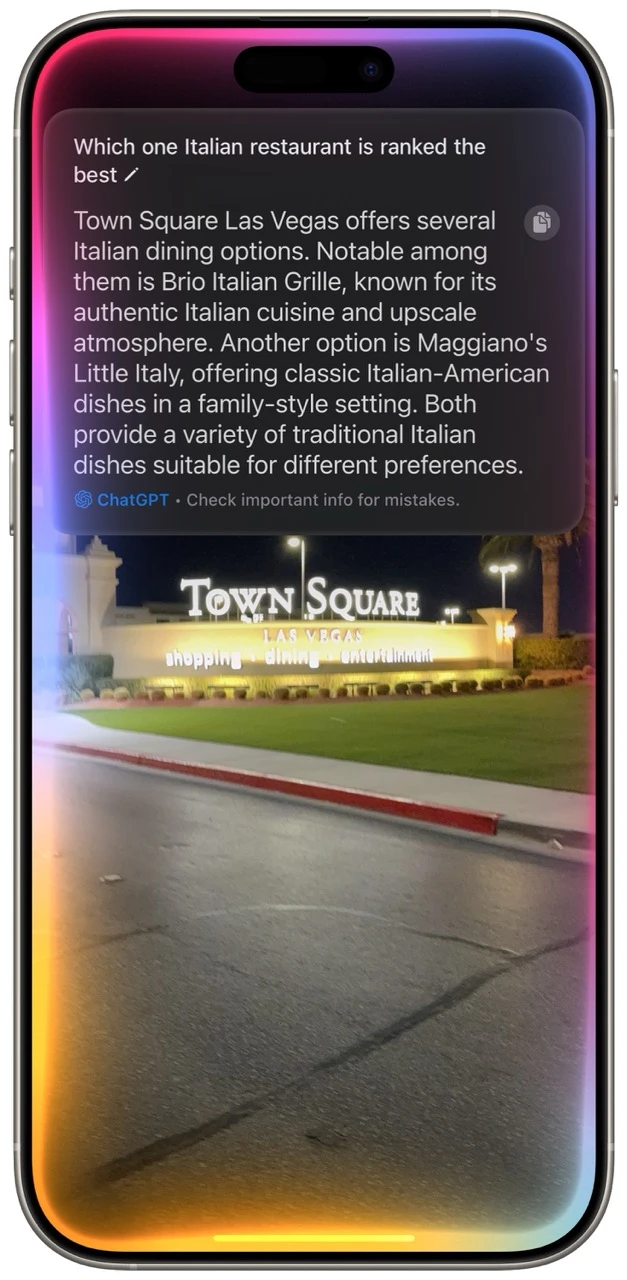

Te kontekstowe podpowiedzi w zamyśle są super, bo kierując obiektyw w stronę kilku pawilonów, na ekranie od razu widzimy nazwę jednego ze znajdujących się tam sklepów. Czasem jednak podpowiedzi sugerowały, że jakiś punkt usługowy znajduje się w szczerym polu, gdzie nie stał żaden budynek. SI nieźle za to wybrnęła, jak zadałem jej pytanie o cenę noclegu w kompleksie restauracyjnym i wyjaśniła, że w tu się je, a nie śpi. A na moją prośbę poleciła konkretną włoską knajpę.

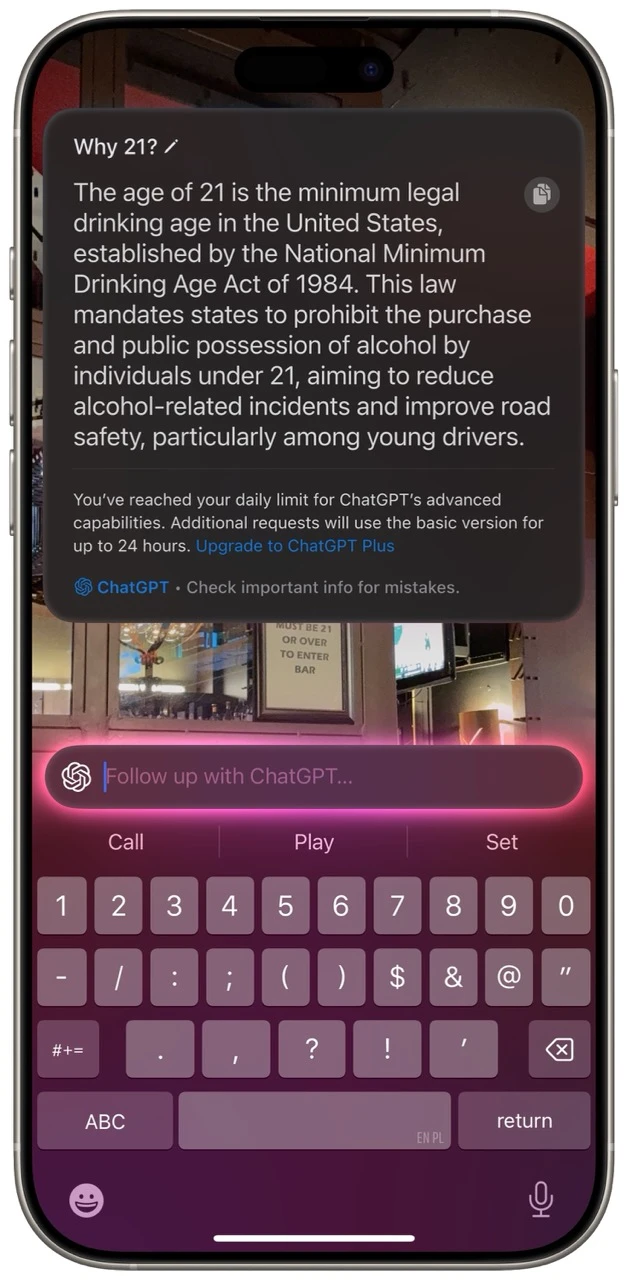

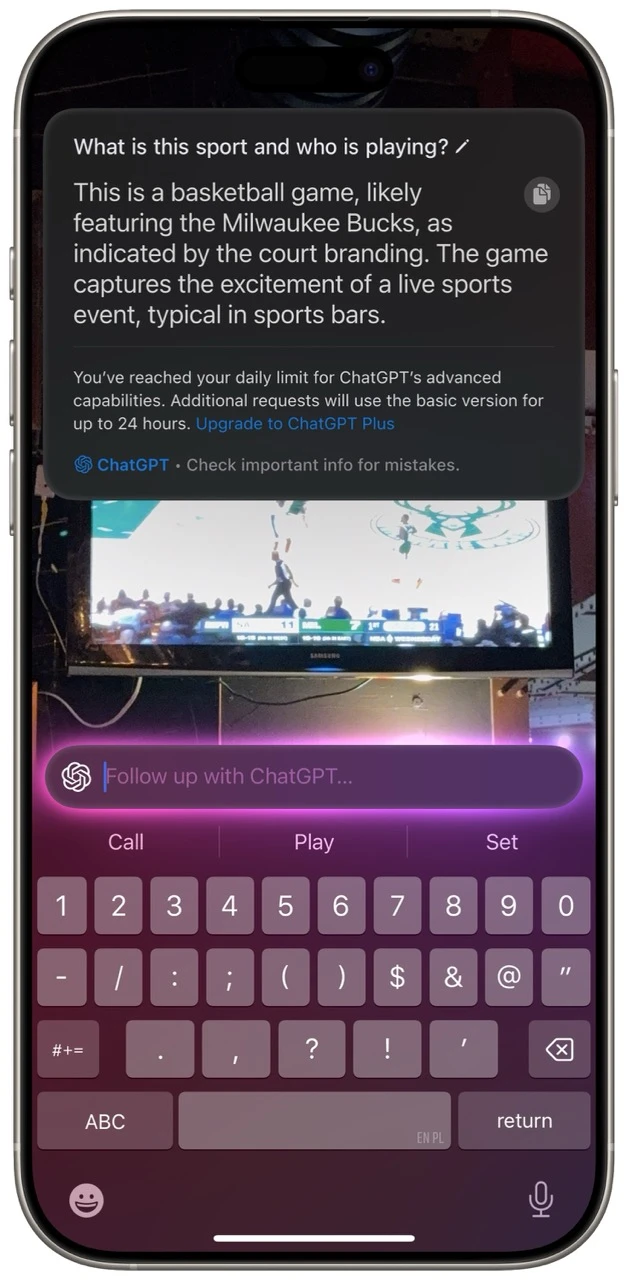

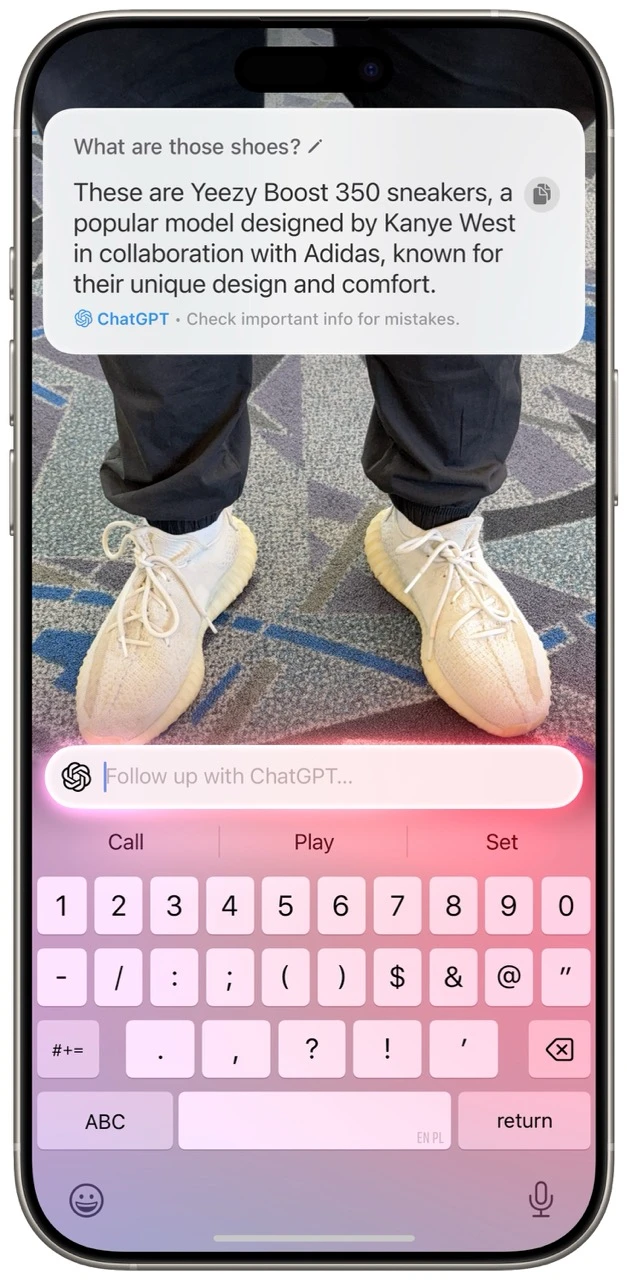

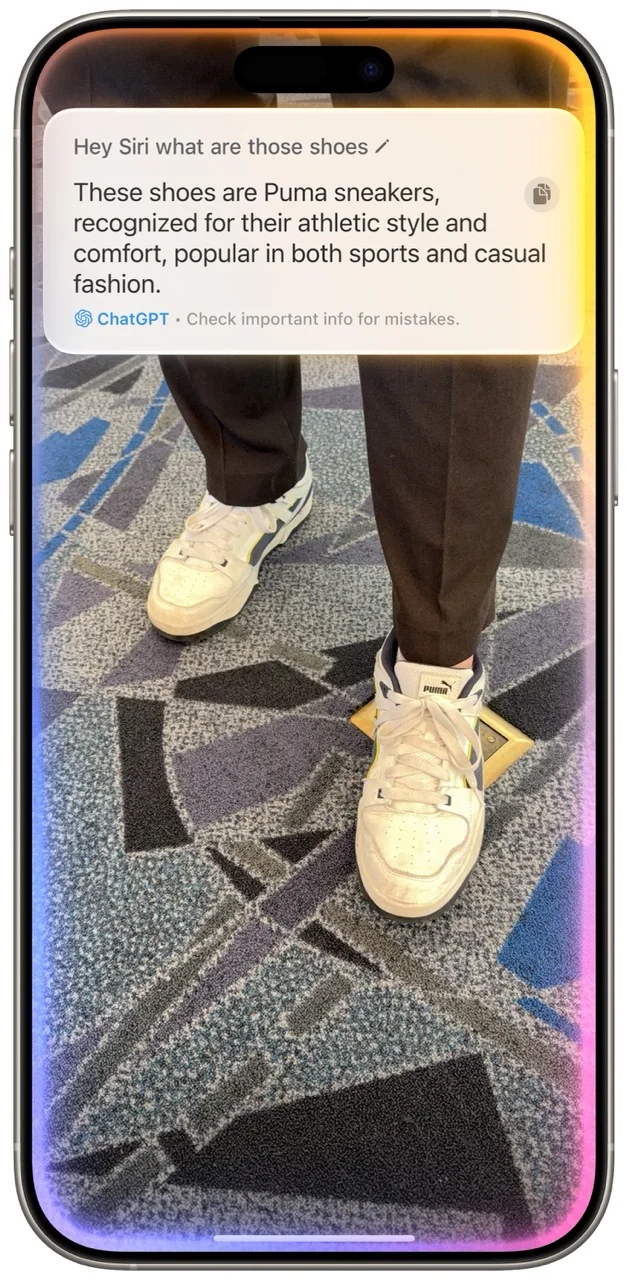

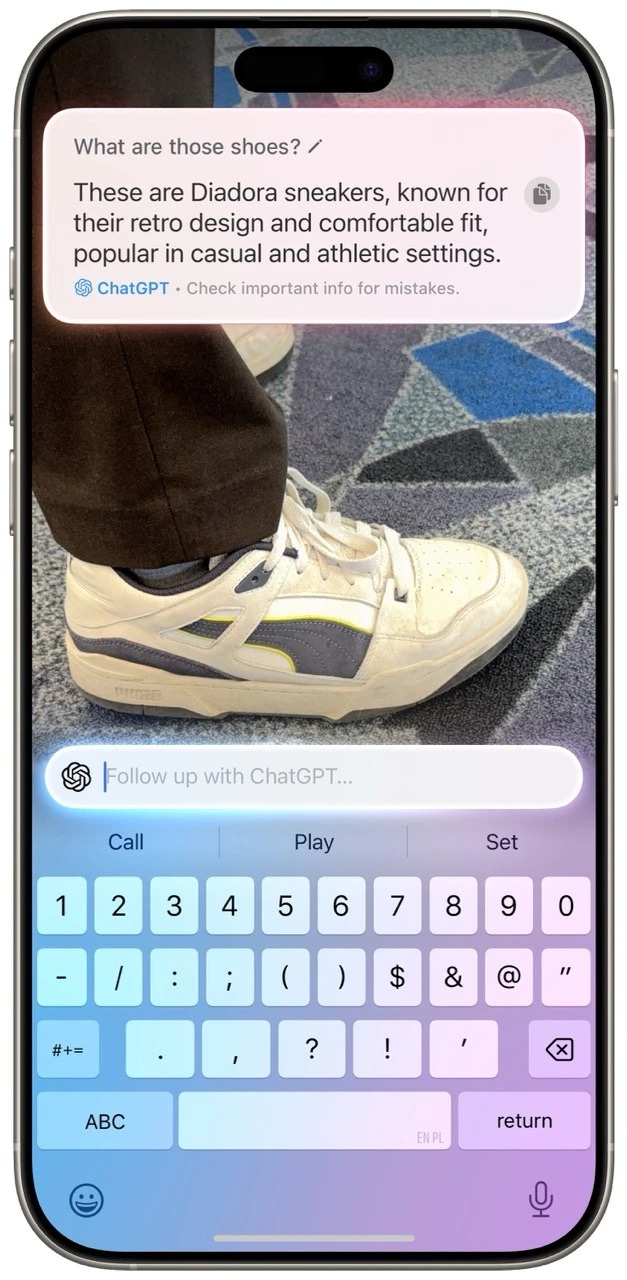

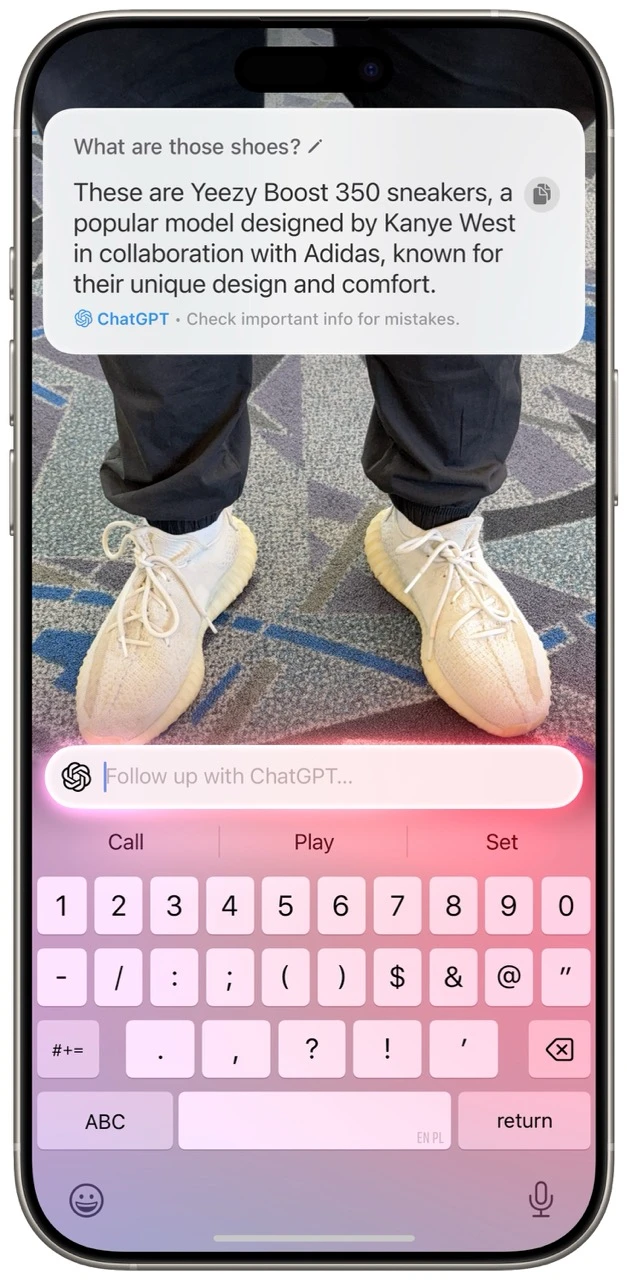

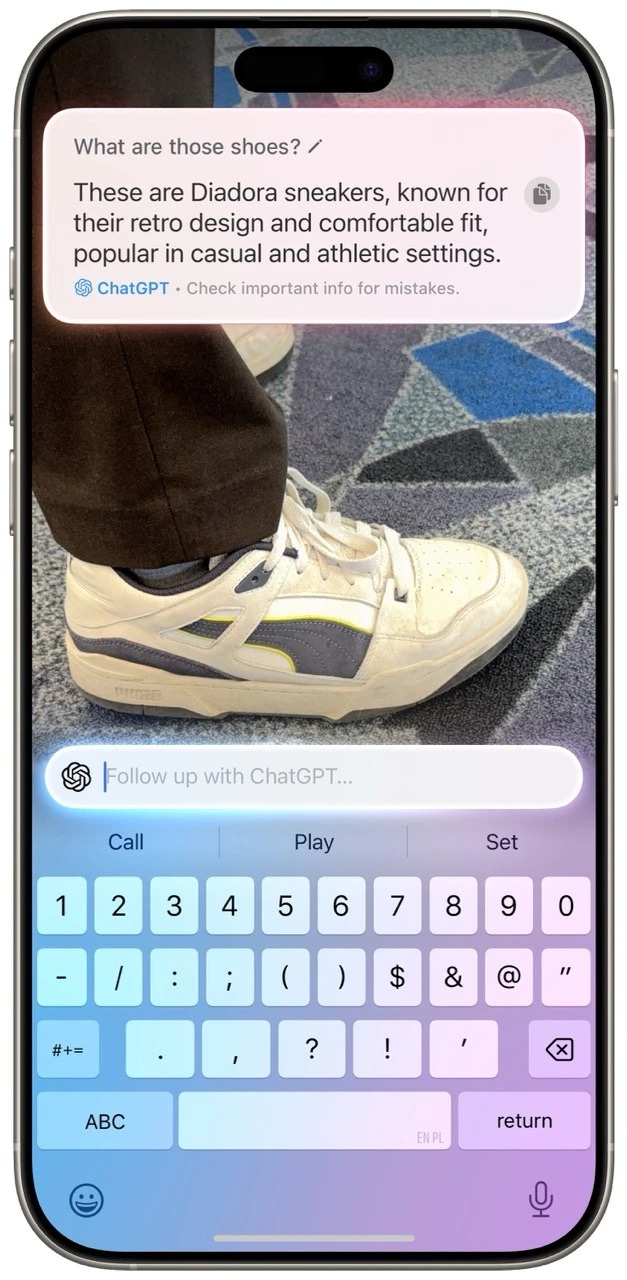

Visual Intelligence trafnie rozpoznało model popularnych butów, ale w przypadku takich mniej znanych raz rozpoznało markę po logo, ale za drugim razem, z innego ujęcia, gdy logo było już niewidoczne, zaczęło zmyślać. Wyjaśniło też trafnie, z czego wynika, iż w amerykańskiej knajpie na ścianie widnieje informacja, że alkohol podawany jest osobom w wieku nie od 18, a od 21 lat w górę. Rozpoznało też rodzaj sportu i drużynę widoczną w relacji na TV.

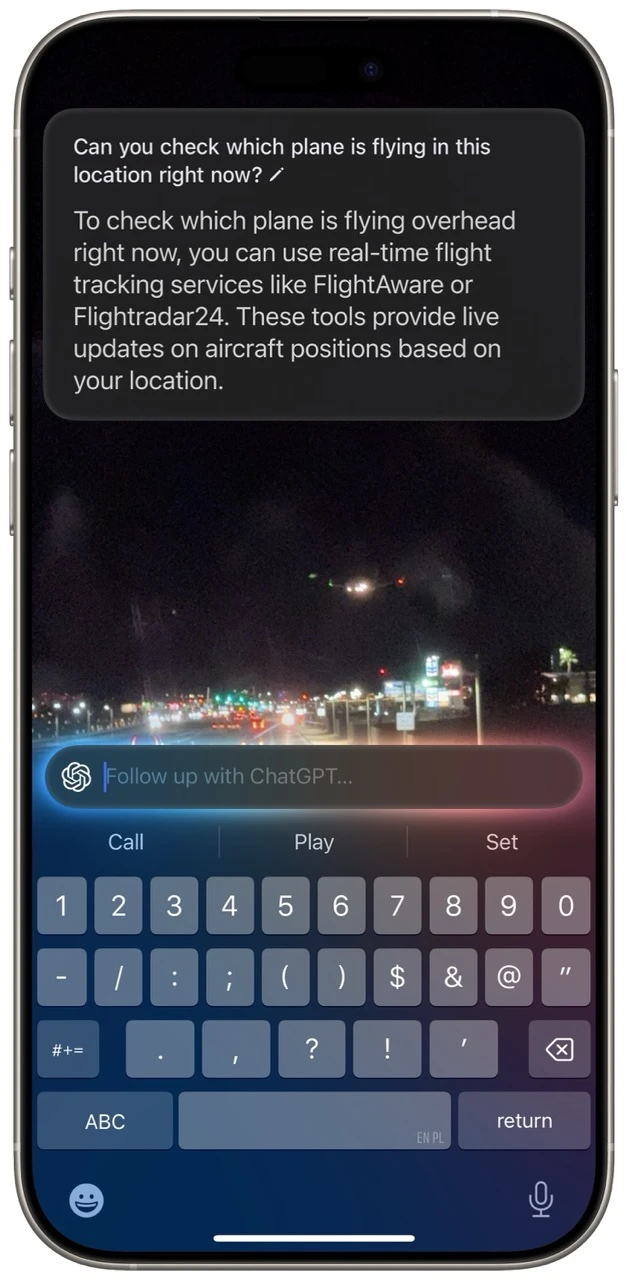

Zakres możliwości interakcji okazał się mimo wszystko dość rozczarowujący. Nie udało mi się ani poprosić jej o to, by np. zapisała w notatkach godziny otwarcia sklepów i nie potrafiła też zidentyfikować na bazie lokalizacji, godziny, zdjęcia oraz jakiejś ogólnodostępnej bazy danych, jaki samolot właśnie nade mną przelatuje. W ogólnym rozrachunku tego typu asystent to świetny pomysł na papierze, ale musi się jeszcze mocno podszkolić, zanim będzie można mu ufać.

Bardziej od tego całego Apple Intelligence kręci mnie Klonowanie iPhone’a.

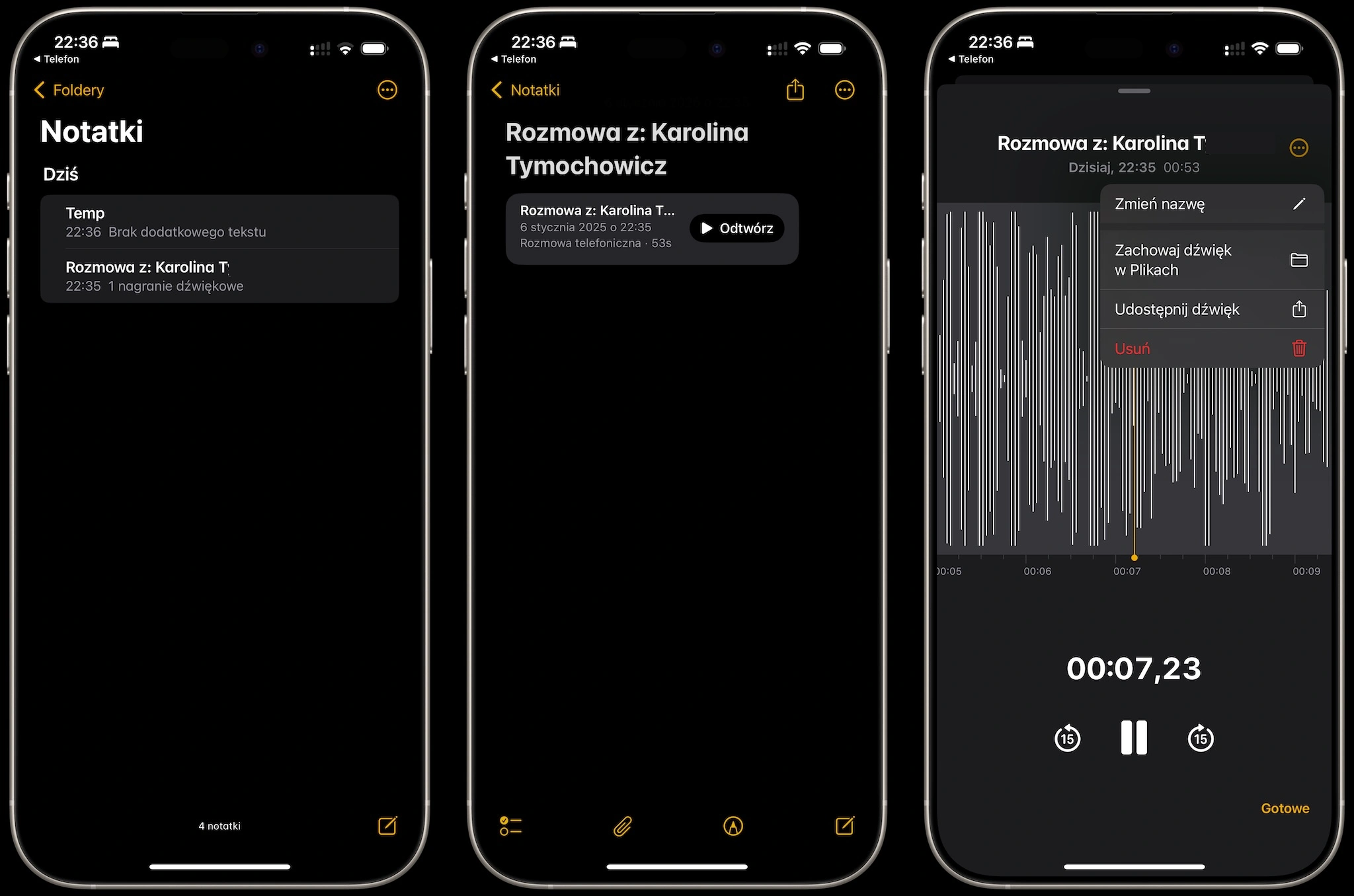

Tak jak nie jestem specjalnie oczarowany tym, jak dzisiaj działa Visual Intelligence, ale na szczęście to nie koniec niespodzianek, jakie czekają na użytkowników iPhone’ów w USA. Pojawiło się tam kilka dodatków niezwiązanych bezpośrednio z AI, czyli np. rejestrowanie połączeń telefonicznych bezpośrednio z poziomu aplikacji Telefon. Po rozpoczęciu nagrywania nasz rozmówca jest o tym informowany, a po jego zakończeniu plik audio zapisywany jest w Notatkach.

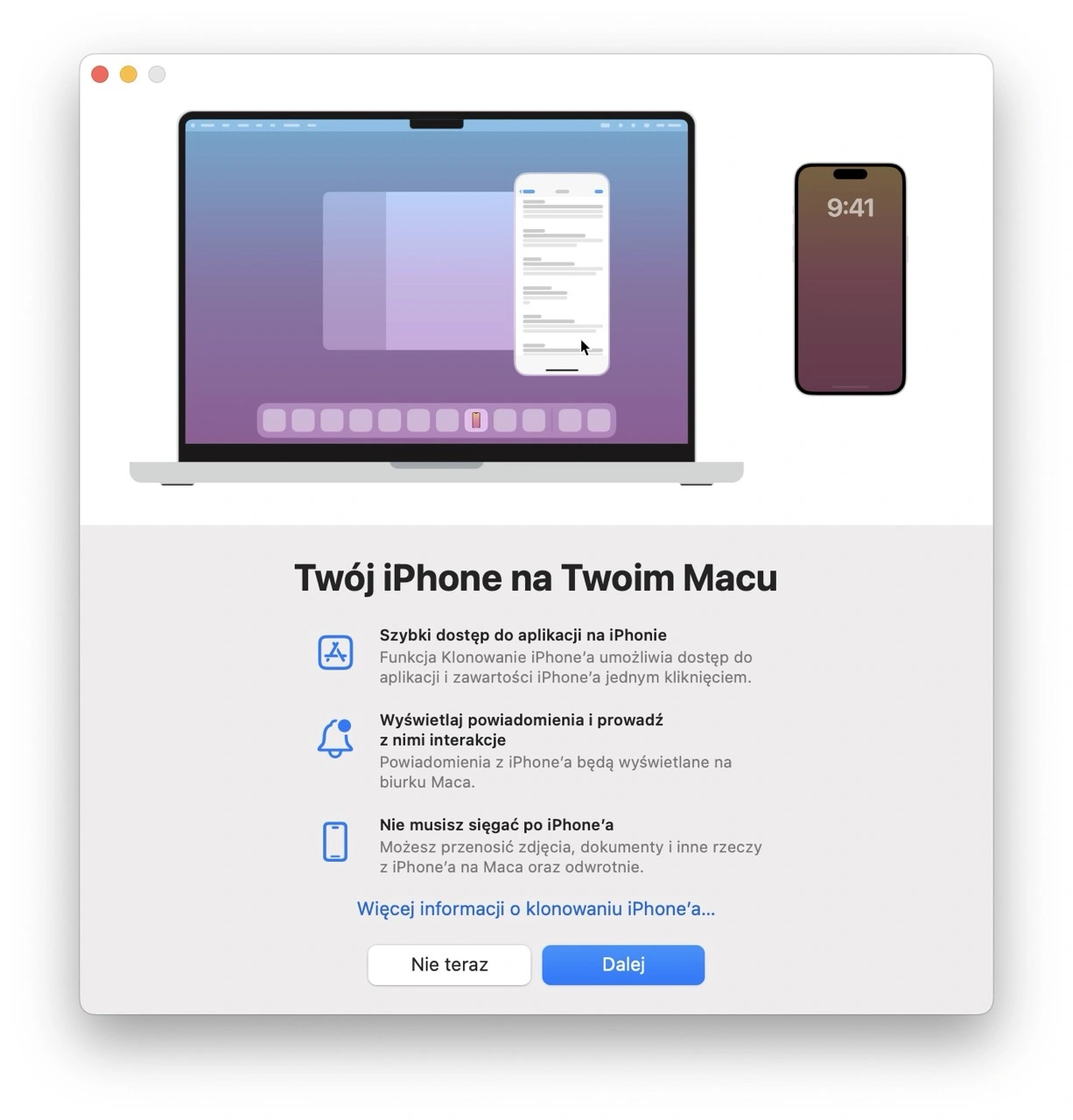

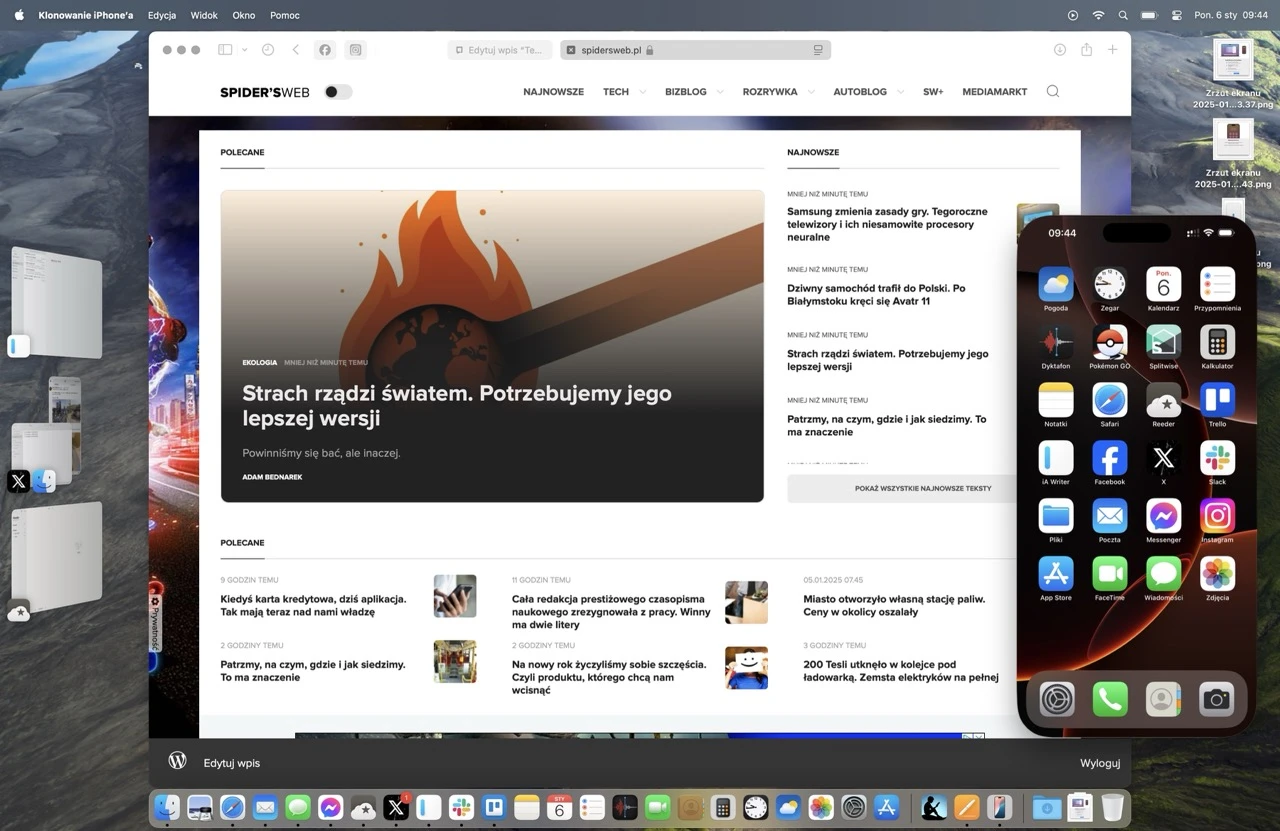

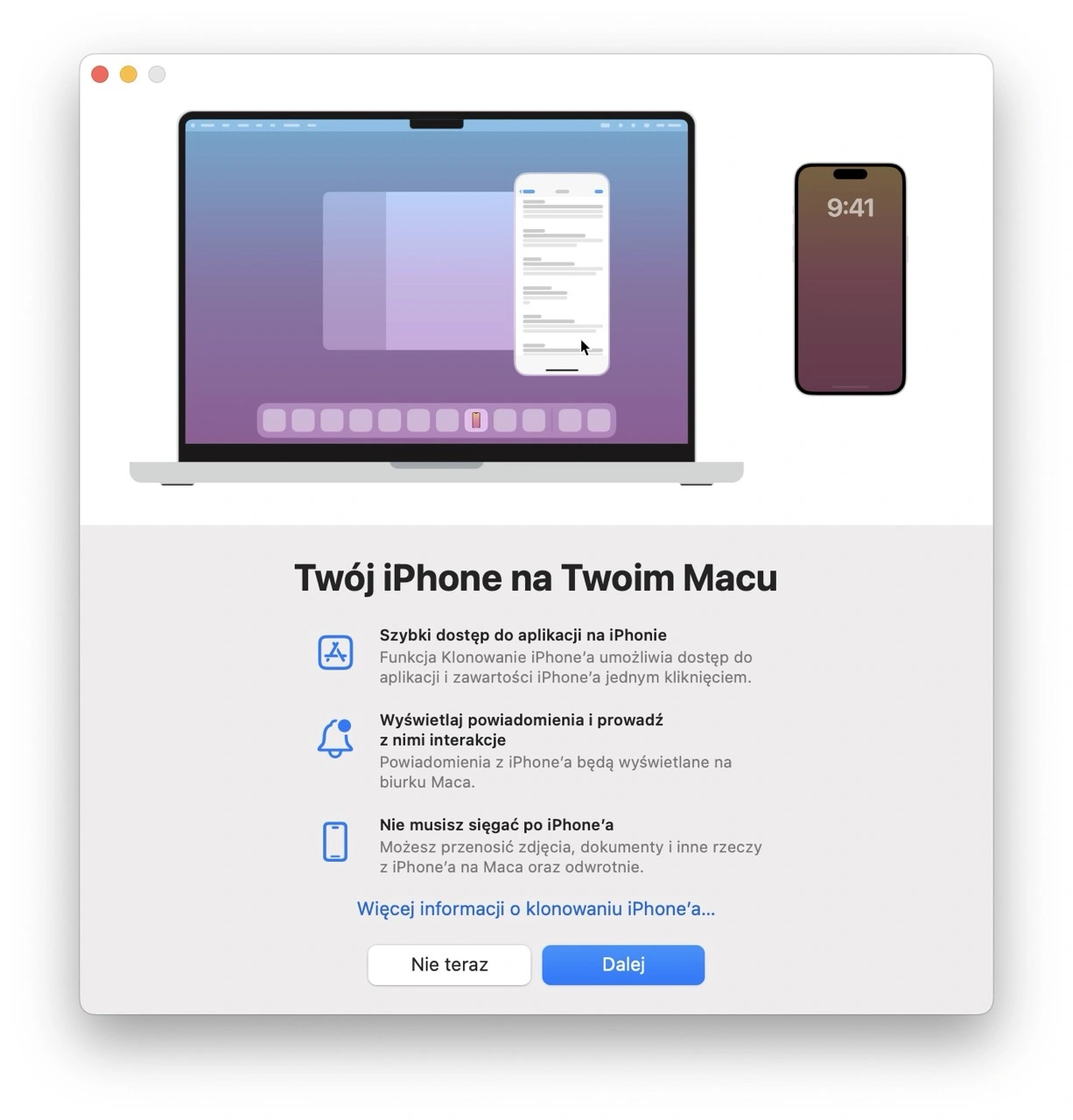

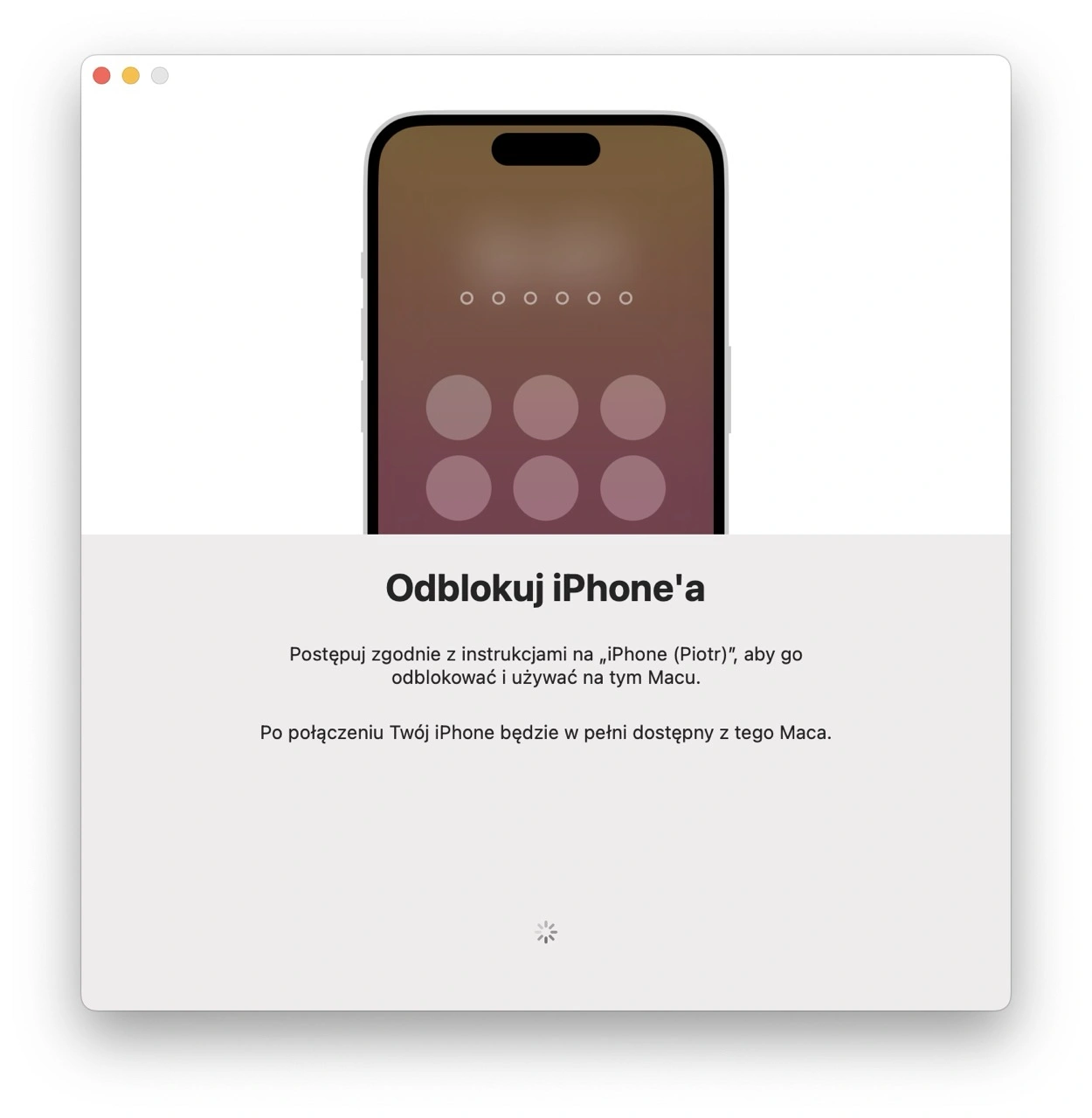

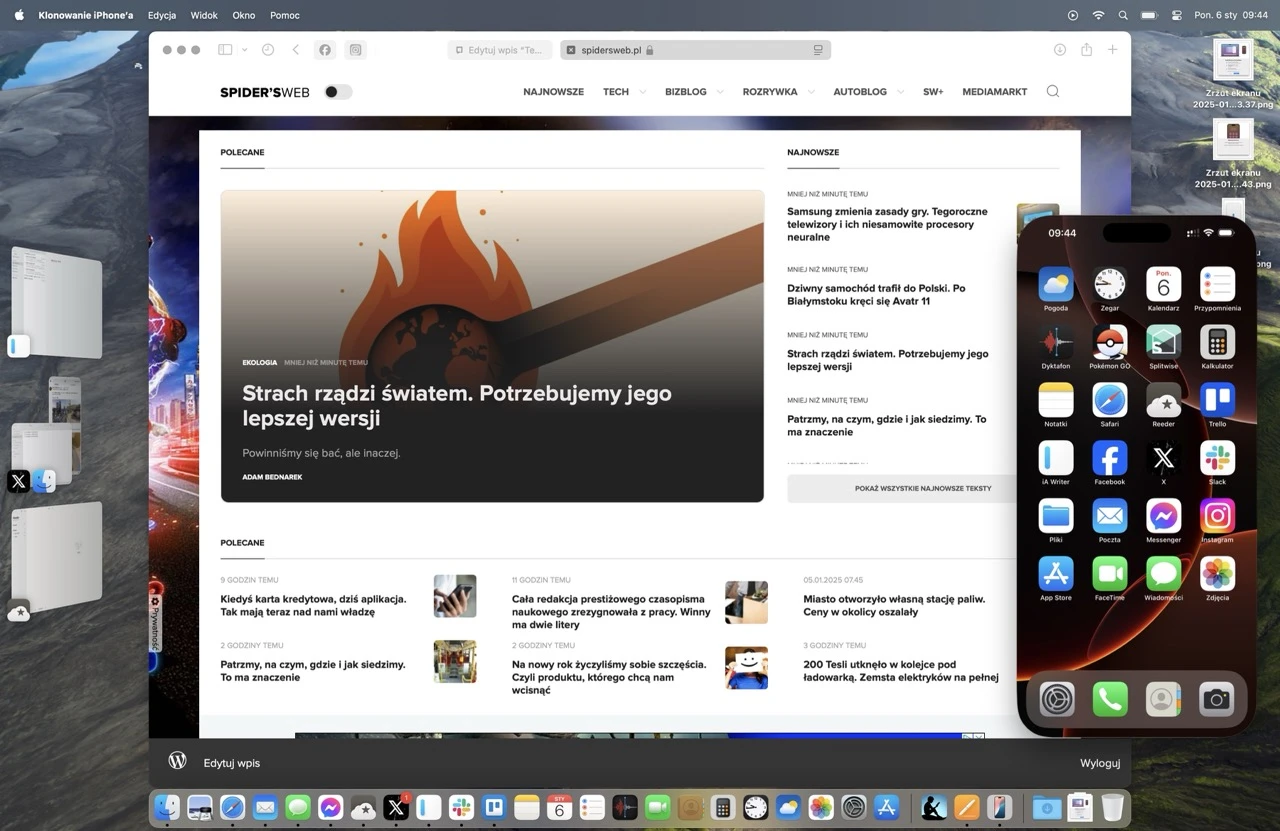

To dodana w zeszłym roku funkcja komputerów Apple’a, która w wyniku ograniczeń regionalnych również nie jest jak na razie dostępna w Europie. Po jej aktywacji w obsługiwanym regionie (co nie wymagało nawet zmiany języka) zabrany na wyjazd MacBook mógł nawiązać bezprzewodowe połączenie z iPhone’em i klonować z niego obraz. Działało to płynnie i było szalenie przydatne i korzystałem z tego non stop i pracując przy biurku, nie musiałem wyciągać telefonu z kieszeni.

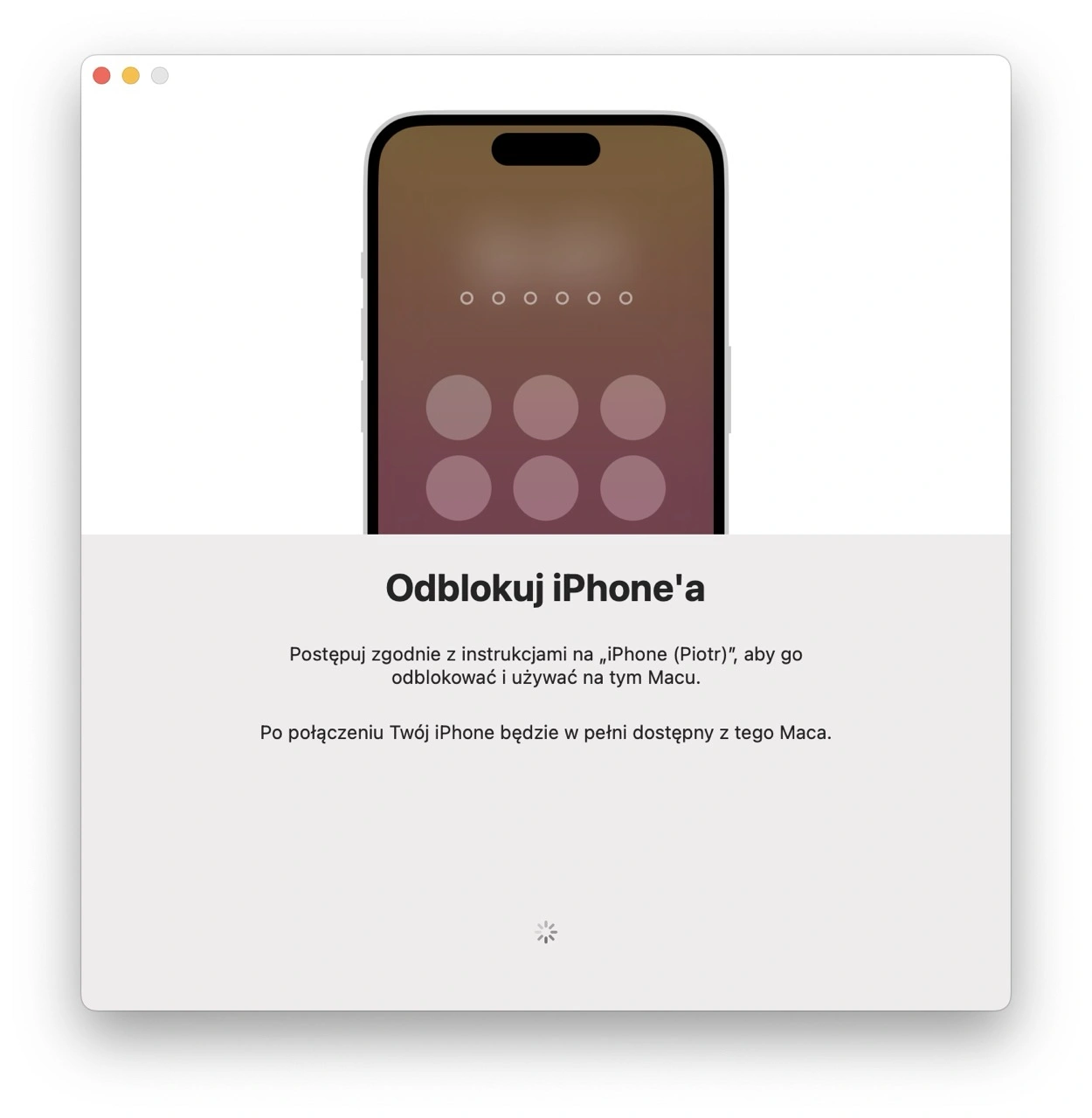

Po aktywacji Klonowania ekranu telefon jest blokowany, a po wzięciu go do ręki i odblokowaniu połączenie jest od razu przerywane i pojawia się informacja o tym, iż łączył się z komputerem. Najlepsze jest zaś to, że komputer z macOS zaczął klonować powiadomienia z iPhone’a, a po ich kliknięciu otwierał powiązane z nimi apki mobilne w okienku z ekranem klonowanym z telefonu, w razie potrzeby nawiązując z nim od nowa połączenie, jeśli aktualnie był podpięty.

A co z Apple Intelligence i tymi innymi dodatkami po powrocie do kraju?

Jak łatwo można się domyśleć, po wylądowaniu w Europie i połączeniu się z lokalną siecią mobilną te wszystkie dodatkowe funkcje zapewniane przez AI i nie tylko wyparowały jak kamfora. Poczta znowu nie ma podziału na kategorie, powiadomienia nie są streszczane i nie mogę wykorzystać usługi ChatGPT ani do analizy obrazu przechwytywanego przez aparat, ani do pomocy w redagowaniu treści. Mac odmawia też uruchomienia apki Klonowanie iPhone’a.

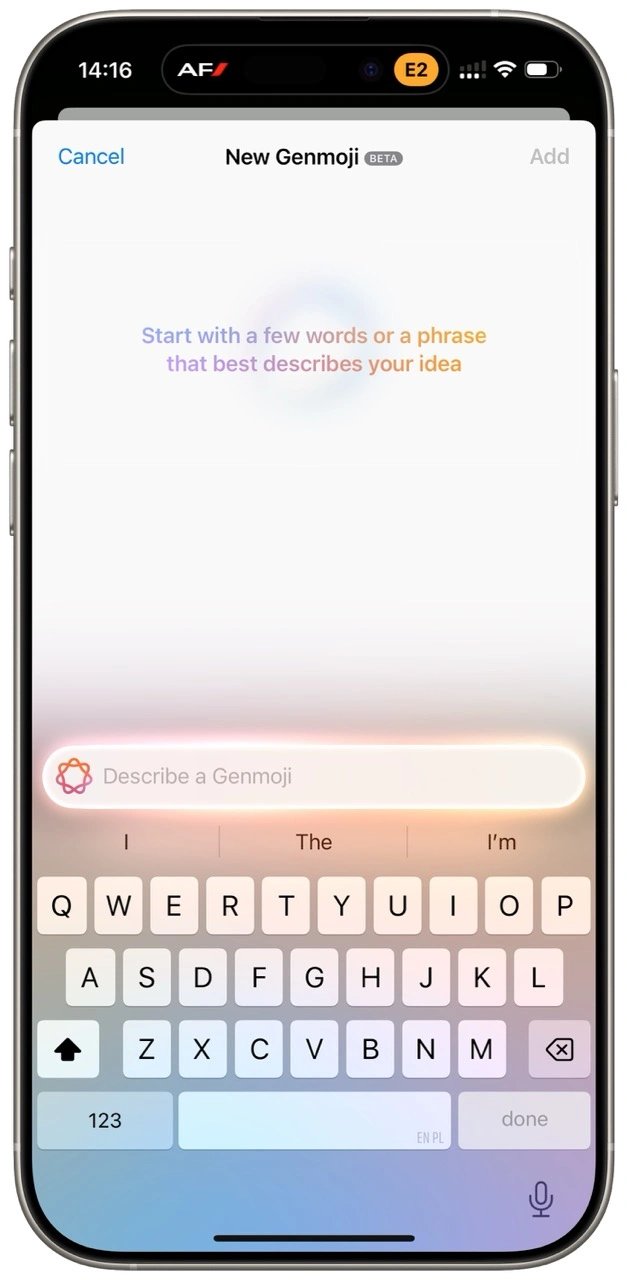

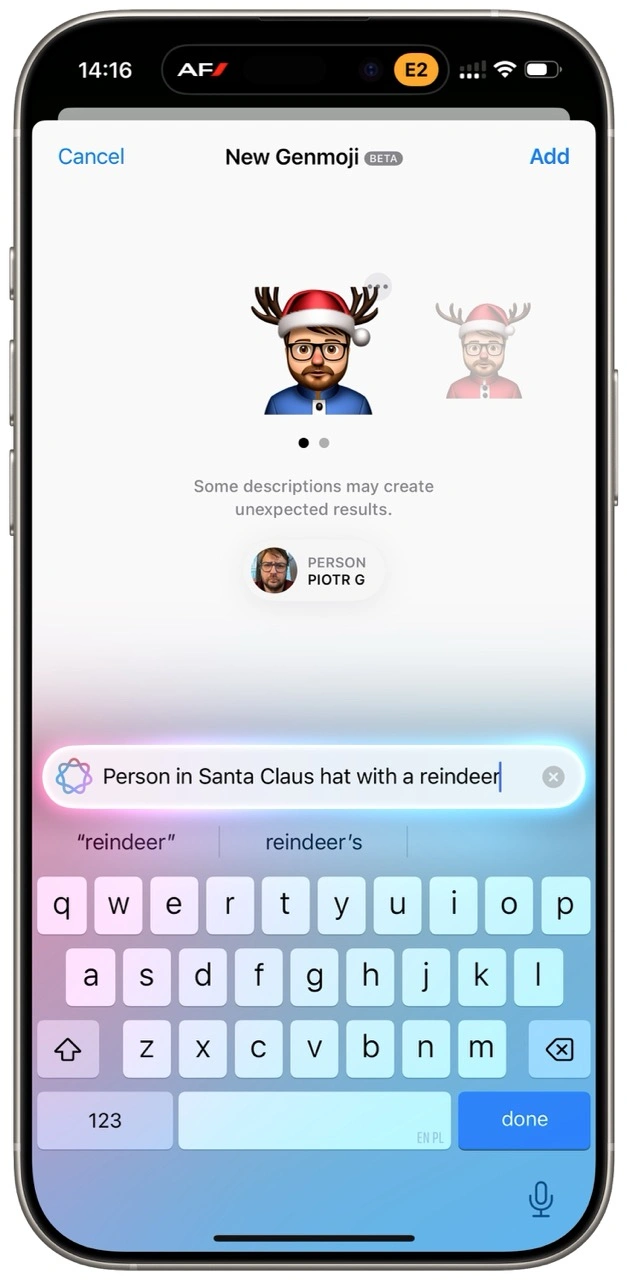

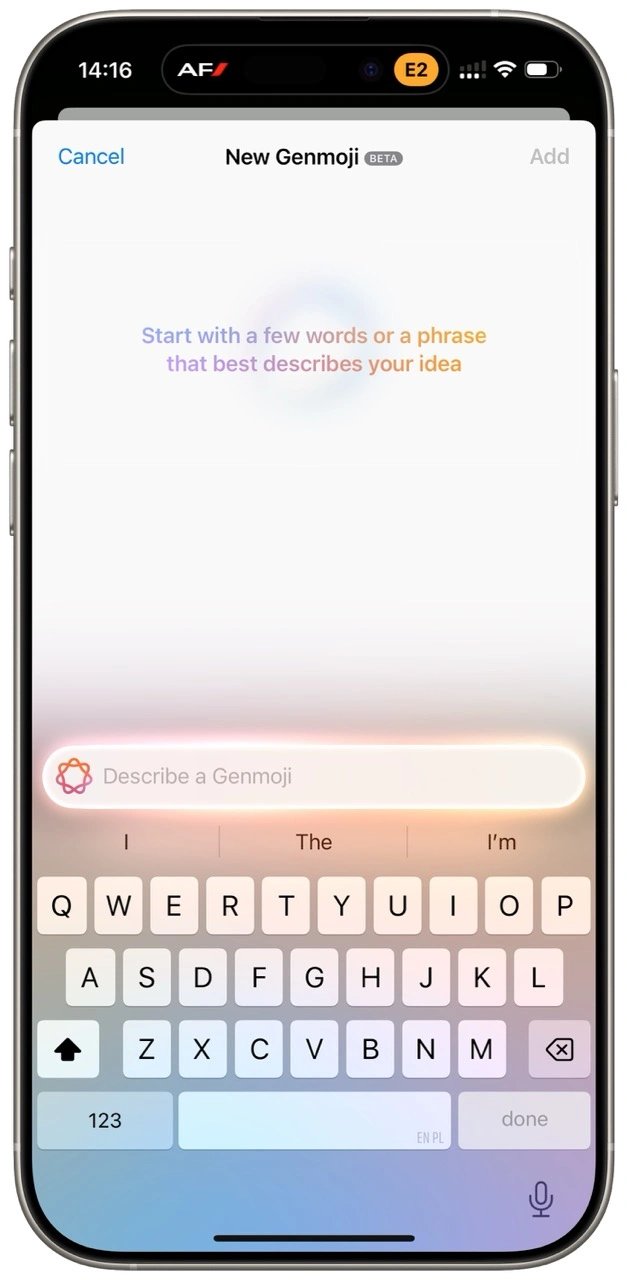

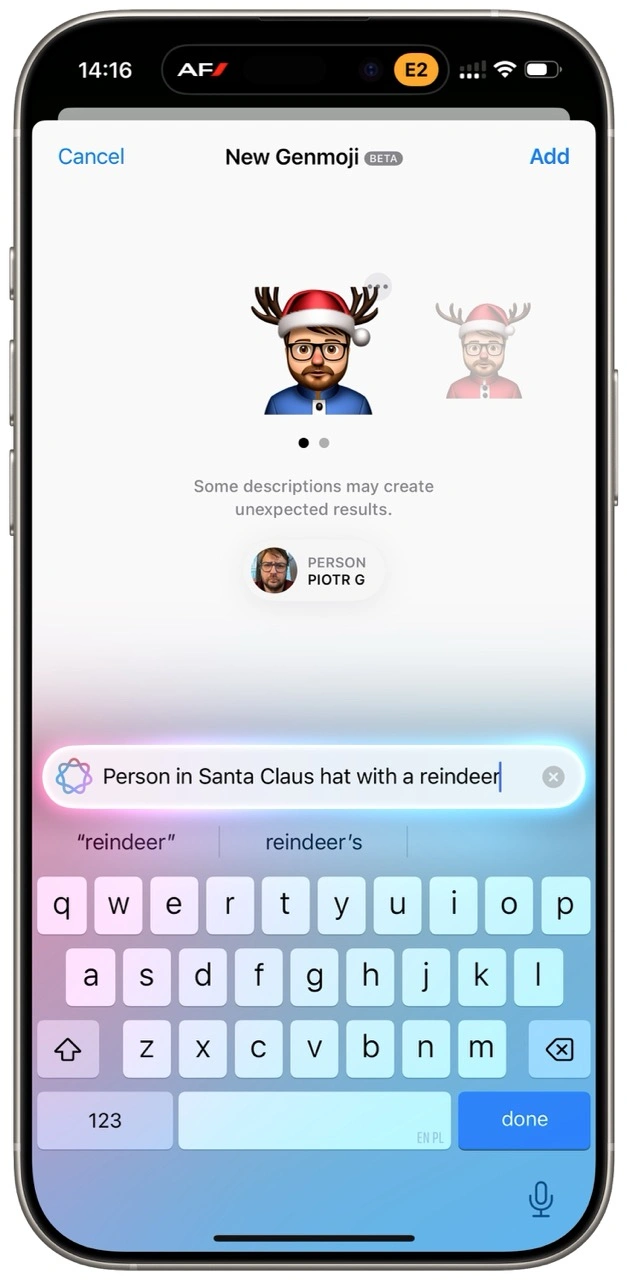

Jedyne, co mi zostało po powrocie, to wspomnienia oraz kilka wygenerowanych przez SI emotikonek w sekcji tych ostatnio używanych oraz apka Image Playground w folderze tych ostatnio zainstalowanych, po której otwarciu pojawia się informacja, iż nie dla psa kiełbasa „ta funkcja jest dostępna, tylko gdy iPhone i Siri używają tego samego języka”. Komunikat wprowadza jednak w błąd, gdyż po zmianie języka pojawia się nowy, tym razem o „niedostępności w tym regionie”.

Jakie to jest wszystko, kurczę, głupie.