Microsoft przywiózł AI do Warszawy. Co z tego będą mieli Polacy?

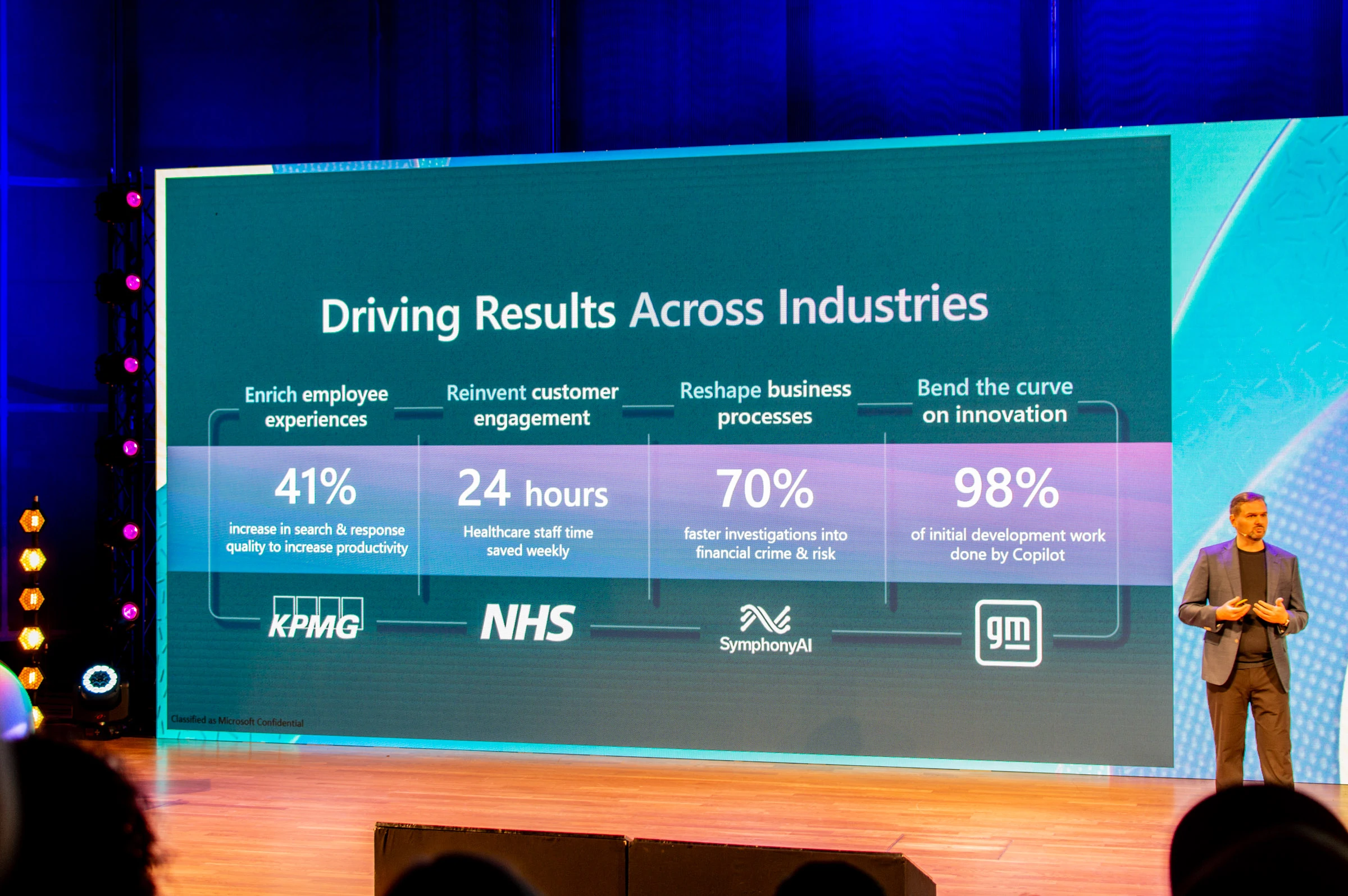

Build AI Day to wstęp do corocznej międzynarodowej konferencji Microsoftu dla programistów. Wydarzenie miało na celu oswojenie deweloperów i menedżerów z koncepcją generatywnej sztucznej inteligencji. Bo, jak się okazuje, to już nie technologiczna awangarda. To gotowe do wdrożenia rozwiązania, za sprawą których pierwsze firmy odnotowują istotne wzrosty wyników.

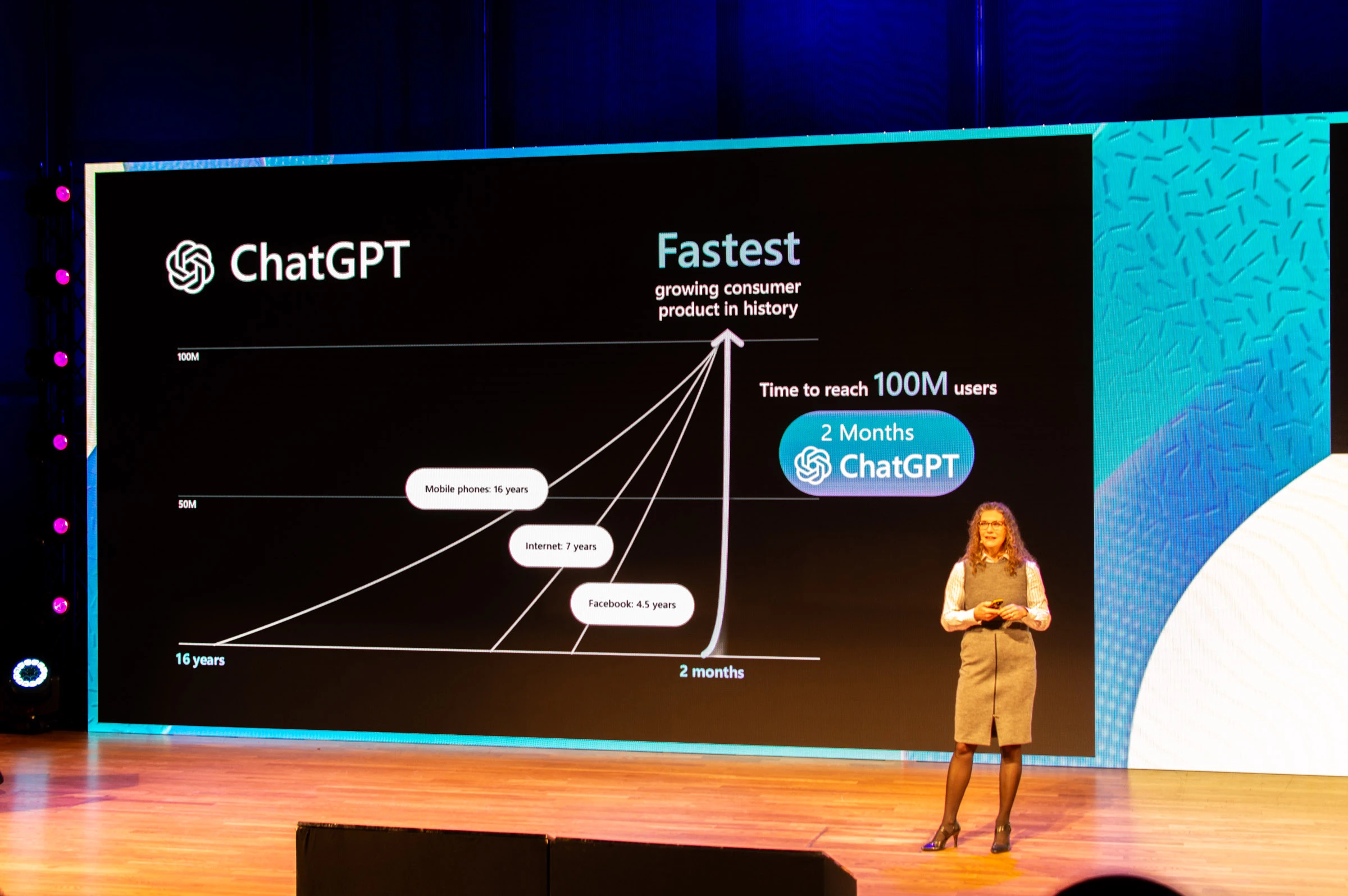

Prawdopodobnie nie trzeba już dziś nikomu opowiadać o generatywnej sztucznej inteligencji (GenAI). Niemal każdy słyszał o modelu GPT od firmy OpenAI, a wielu miało też z nim bezpośrednią styczność za sprawą ChatGPT, Copilota, Binga czy Designera. Generatywna sztuczna inteligencja dała się poznać jako niezwykle wygodny interfejs do wyszukiwarki internetowej czy zdumiewająco sprawny generator grafik. A także sympatyczny czatbot, z którym można językiem naturalnym porozmawiać na niemal dowolne tematy.

Ale przecież generatywna sztuczna inteligencja to znacznie, znacznie więcej

Duże Modele od OpenAI i technologie Microsoftu związane z SI i przetwarzaniem danych służą oczywiście znacznie większej liczbie celów niż tylko rozrywka internautów. Duże Modele Językowe (LLM) i GenAI mają szerokie zastosowanie w różnych sektorach, takich jak biznes, administracja publiczna i nauka.

Duże Modele Językowe mogą być technologią, za sprawą której czatboty i wirtualni asystenci w firmie mogą zapewnić szybką i efektywną obsługę klienta. I to działające czatboty, które rozumieją kontekst i intencje swoich rozmówców - a nie niezbyt rozgarnięte skrypty, które ostatecznie i tak wymagają wsparcia żywego pracownika.

Na tym jednak nie koniec. LLM-y świetnie nadają się do analiz porównawczych i szukania korelacji w dużych zbiorach danych. Generatywna sztuczna inteligencja doskonale więc radzi sobie jako mechanizm do wychwytywania najważniejszych informacji z dziesiątków zarchiwizowanych rekordów, prezentacji, arkuszy czy innych dokumentów. Mogą więc być fundamentem aplikacji do generowania raportów i analiz rynkowych, wydobywając istotne informacje i trendy.

GenAI może też pomóc w przyspieszeniu i uproszczeniu procesów administracyjnych, takich jak przeglądanie dokumentów czy zarządzanie danymi. Możliwe jest wykorzystanie SI nowej generacji do personalizowania usług publicznych i dostarczania informacji dostosowanych do potrzeb indywidualnych użytkowników.

Generatywna SI i uczenie maszynowe rewolucjonizują opiekę zdrowotną, pomagając w diagnostyce, personalizacji planów leczenia i przewidywaniu wyników dla pacjentów. Jest wykorzystywana do tworzenia muzyki, obrazów, a nawet poezji, imitując ludzką kreatywność i styl. Może pomóc w tworzeniu realistycznych efektów specjalnych, animacji postaci, a nawet w generowaniu scenariuszy. Algorytmy uczenia maszynowego pomagają w personalizacji ofert, optymalizacji łańcuchów dostaw i poprawie doświadczeń klientów.

Duże Modele Językowe, takie jak GPT-4 - i ty i twoja firma. Czas na własnego Copilota. Na Build AI Day można było się dowiedzieć, jak Microsoft może pomóc

To, co większość z nas dobrze zna - OpenAI ChatGPT czy Microsoft Copilot - to nie Duże Modele Językowe, a aplikacje, które je wykorzystują. To przy tym ważne dla obu tych firm usługi, ale Microsoft to przede wszystkim firma od platform. Jej głównym celem jest zapewnianie fundamentów i narzędzi, za sprawą których jej klienci będą budować fantastyczne rzeczy. W niektórych zastosowaniach może i lepsze od samego ogólnodostępnego Copilota. Oczywiście zacząć trzeba od chmury.

Budowanie i skalowanie aplikacji cloud-native to proces, który wymaga głębokiego zrozumienia zarówno możliwości platformy chmurowej, jak i najlepszych praktyk w zakresie architektury oprogramowania. Platforma Azure od Microsoftu oferuje szeroki zakres usług i narzędzi, które ułatwiają tworzenie inteligentnych aplikacji, które są nie tylko skalowalne i wydajne, ale także bezpieczne i elastyczne.

Podstawą aplikacji cloud-native jest architektura mikrousług (microservices), która pozwala na podział aplikacji na mniejsze, niezależne serwisy. Każda mikrousługa może być rozwijana, wdrażana i skalowana niezależnie od innych, co zwiększa agility i szybkość dostarczania nowych funkcji. Platforma Azure wspiera konteneryzację, która jest kluczowa dla mikrousług, poprzez usługi takie jak Azure Kubernetes Service (AKS), który umożliwia zarządzanie kontenerami na dużą skalę.

Azure oferuje również możliwość tworzenia aplikacji bezserwerowych (serverless), gdzie logika biznesowa może być uruchamiana jako funkcje, które są aktywowane przez różne zdarzenia. Usługa Azure Functions pozwala na tworzenie takich funkcji, które są automatycznie skalowane i optymalizowane pod kątem wydajności. To podejście pozwala deweloperom skupić się na kodzie, a nie na infrastrukturze.

Aby aplikacje były naprawdę inteligentne, muszą być w stanie przetwarzać i analizować duże ilości danych w czasie rzeczywistym. Azure oferuje szereg usług do przetwarzania danych, takich jak Azure Stream Analytics dla analizy strumieniowej, Azure Data Lake dla przechowywania danych w dużych ilościach, czy Azure Machine Learning dla zaawansowanych analiz predykcyjnych i uczenia maszynowego.

Skalowanie aplikacji cloud-native na platformie Azure jest proste dzięki usługom takim jak Azure Load Balancer czy Azure Autoscaling, które pozwalają na elastyczne dostosowywanie zasobów do aktualnego obciążenia. Bezpieczeństwo jest również kluczowym aspektem, a Azure zapewnia zaawansowane mechanizmy autentykacji i autoryzacji, szyfrowanie danych oraz zgodność z międzynarodowymi standardami bezpieczeństwa.

Zastrzyk sztucznej inteligencji w ramach Azure

Integracja Azure AI z Azure Kubernetes Service (AKS) otwiera nowe możliwości dla tworzenia inteligentnych aplikacji, które są skalowalne, wydajne i mogą uczyć się w czasie rzeczywistym. Wykorzystanie tych dwóch potężnych usług Azure pozwala na tworzenie zaawansowanych rozwiązań, które mogą automatycznie reagować na zmieniające się warunki i potrzeby użytkowników.

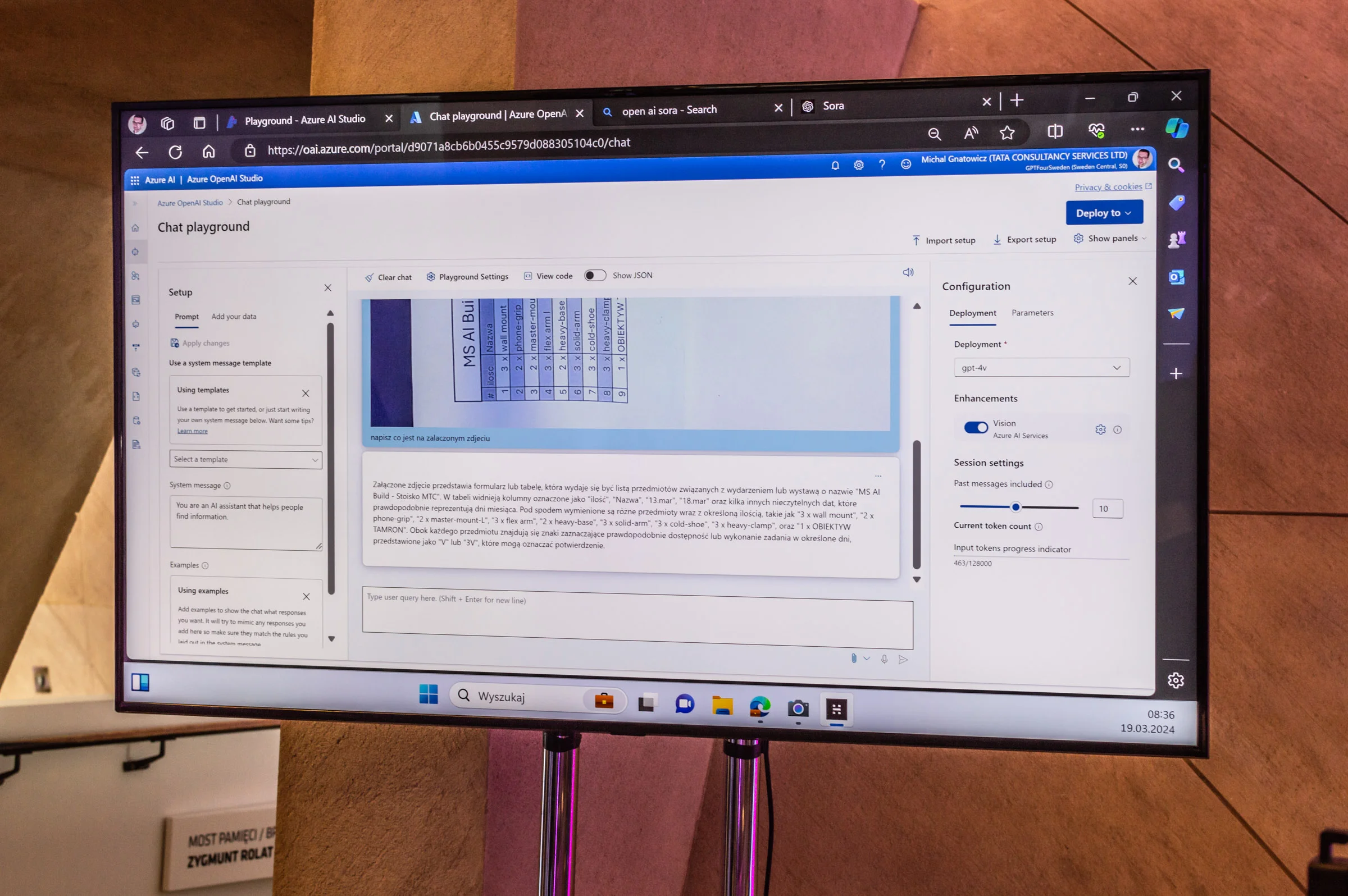

Azure AI to zbiór usług i narzędzi AI, które umożliwiają tworzenie aplikacji zdolnych do rozumienia świata poprzez widzenie, słuchanie, mówienie, rozumienie języka naturalnego i podejmowanie decyzji. Usługi takie jak Azure Cognitive Services dostarczają gotowe do użycia API, które pozwalają na łatwe dodawanie funkcji takich jak rozpoznawanie mowy, przetwarzanie języka naturalnego czy analiza obrazów.

Azure Kubernetes Service (AKS) to zarządzana usługa Kubernetes, która ułatwia wdrażanie, zarządzanie i skalowanie aplikacji kontenerowych. AKS oferuje automatyczne skalowanie, samonaprawę, ładowanie bilansowania i inne funkcje, które są kluczowe dla utrzymania wysokiej dostępności i wydajności aplikacji. Dzięki AKS, deweloperzy mogą skupić się na pisaniu kodu, nie martwiąc się o zarządzanie infrastrukturą.

Integracja Azure AI z AKS pozwala na tworzenie aplikacji, które mogą korzystać z zaawansowanych funkcji AI, jednocześnie będąc skalowalnymi i odpornymi na awarie. Na przykład, można wdrożyć model uczenia maszynowego jako mikrousługę w kontenerze, który jest zarządzany przez AKS. Taki model może być używany do analizy strumieni danych w czasie rzeczywistym, dostarczając inteligentnych wglądów i rekomendacji użytkownikom.

Z kolei Azure Cosmos DB to globalna baza danych NoSQL, która oferuje wielomodelowe przechowywanie danych i rozproszoną architekturę. Jest to idealne rozwiązanie dla aplikacji cloud-native, które wymagają szybkiego dostępu do danych z różnych regionów świata. Azure Cosmos DB zapewnia niską latencję, wysoką przepustowość i globalne skalowanie, co jest niezbędne dla aplikacji o dużym obciążeniu.

Integracja AKS z Azure Cosmos DB pozwala na tworzenie aplikacji, które są nie tylko skalowalne i wydajne, ale także zapewniają spójność danych na całym świecie. Kontenery w AKS mogą bezproblemowo komunikować się z Azure Cosmos DB, korzystając z API SQL, MongoDB, Cassandra lub Gremlin, w zależności od potrzeb aplikacji. To połączenie umożliwia tworzenie aplikacji, które mogą obsługiwać zarówno operacje online, jak i analizy big data.

Wszystkie te elementy układanki tworzą idealne środowisko do rozpoczęcia pracy z GenAI

Usługa Azure Open AI od Microsoftu jest platformą, która umożliwia wykorzystanie zaawansowanych modeli generatywnej AI do tworzenia aplikacji i usług zdolnych do generowania tekstu, obrazów, muzyki i innych form ekspresji. Oferuje dostęp do potężnych modeli AI, takich jak GPT, które mogą być wykorzystywane do generowania tekstu. Te modele są trenowane na ogromnych zbiorach danych i mogą tworzyć treści, które są trudne do odróżnienia od tych stworzonych przez ludzi. Azure Open AI zapewnia również narzędzia do dostosowywania modeli do specyficznych potrzeb i wymagań użytkowników.

Tworzenie i zarządzanie własnym Copilotem z wykorzystaniem Azure ML i GPT-4 to proces, który łączy zaawansowane technologie uczenia maszynowego i sztucznej inteligencji. Azure ML (Machine Learning) to platforma chmurowa, która umożliwia budowanie, trenowanie i wdrażanie modeli ML.

Pierwszym krokiem jest skonfigurowanie środowiska Azure ML, które będzie służyć jako podstawa dla stworzonego przez klienta Copilota. Należy utworzyć zasoby obliczeniowe, przestrzeń roboczą i kontenery do przechowywania danych. Azure ML oferuje elastyczne opcje zarządzania zasobami, co pozwala na dostosowanie mocy obliczeniowej do potrzeb projektu.

Następnie, korzystając z Azure ML, można trenować model GPT-4 na specyficznych danych, aby dostosować go do konkretnych zastosowań. Może to być na przykład język specyficzny dla danej branży lub styl komunikacji dopasowany do danej firmy. Trenowanie modelu wymaga przygotowania odpowiedniego zestawu danych treningowych i walidacyjnych, a także wyboru odpowiednich parametrów uczenia.

Po wytrenowaniu modelu GPT-4, następuje etap wdrażania. Model można hostować bezpośrednio w chmurze Azure, korzystając z usług kontenerowych, takich jak Azure Kubernetes Service (AKS), co zapewnia skalowalność i dostępność usługi. Wdrażanie modelu umożliwia jego integrację z aplikacjami i usługami, które będą korzystać z jego możliwości.

Zarządzanie Copilotem obejmuje monitorowanie wydajności, aktualizowanie modelu i optymalizację kosztów. Azure ML oferuje narzędzia do monitorowania użycia, wydajności i kosztów, a także do automatyzacji procesów aktualizacji modelu. Dzięki temu można mieć pewność, że stworzony w ten sposób Copilot działa efektywnie i jest zawsze aktualny.

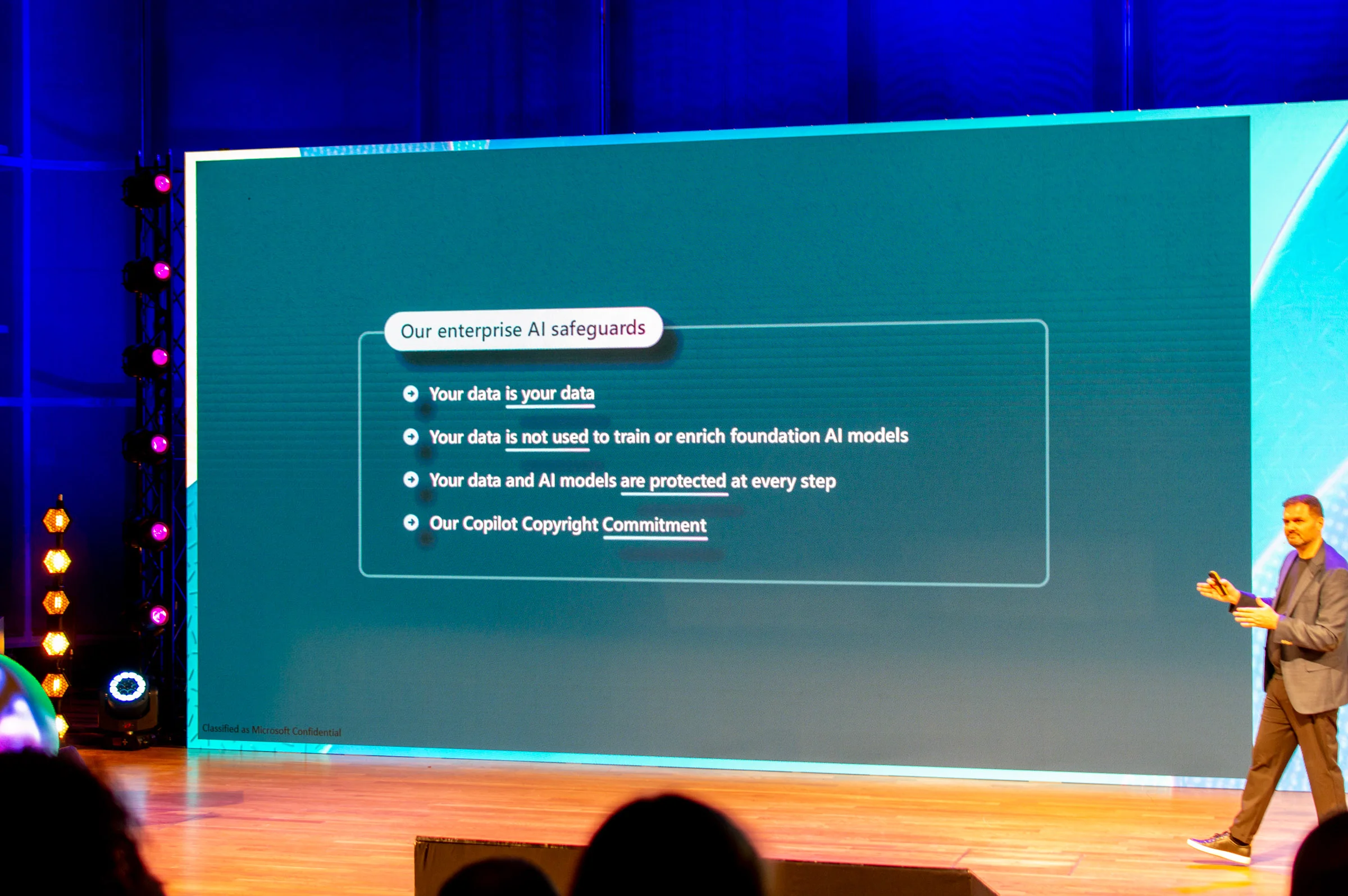

Ważnym aspektem zarządzania Copilotem jest zapewnienie bezpieczeństwa i prywatności danych. Azure ML oferuje zaawansowane funkcje bezpieczeństwa, takie jak szyfrowanie danych, zarządzanie tożsamościami i dostępem oraz zgodność z przepisami o ochronie danych.

Microsoft Build AI Day. Jak korzystać z gotowych Copilotów od Microsoftu?

Podczas wydarzenia dowiedzieć się można było nie tylko jak łatwo, efektywnie i sprawnie stworzyć rozwiązanie typu GenAI ściśle dopasowane do potrzeb danej firmy czy jej klientów. Nie wszyscy jednak będą potrzebować aż tak daleko idących inwestycji w sztuczną inteligencję. Dostępny publicznie i wywodzący się w działu Bing asystent Microsoft Copilot to konsumencka SI ogólnego przeznaczenia. Microsoft jednak już opracował liczne jego dodatkowe, specjalistyczne odmiany. Te co prawda zapewne nie zastąpią wysoce wyspecjalizowanych usług GenAI stworzonych bezpośrednio pod konkretne potrzeby równie konkretnej firmy - ale i tak mogą być niesłychanie użyteczne.

Bezcennym wsparciem dla programistów, w tym zatrudnionych w twojej firmie, może być Github Copilot. Ten sugeruje fragmenty kodu i całe funkcje w czasie rzeczywistym, pomagając w szybszym i bardziej efektywnym pisaniu aplikacji. Copilot może generować sugestie kodu na podstawie komentarzy, nazw funkcji i kontekstu kodu, z którym pracuje dany deweloper. Dzięki temu, programiści mogą skupić się na logice biznesowej i strategii implementacji, podczas gdy rutynowe i powtarzalne fragmenty kodu są automatycznie uzupełniane.

GitHub Copilot najlepiej sprawdza się, gdy jest zintegrowany z codziennym procesem rozwoju oprogramowania. Programiści mogą używać Copilota do generowania szkiców funkcji, testów jednostkowych i innych typowych struktur kodu. To nie tylko przyspiesza proces tworzenia oprogramowania, ale także pomaga w utrzymaniu spójności i przestrzeganiu najlepszych praktyk kodowania. GitHub Copilot może również służyć jako narzędzie edukacyjne, pomagając programistom w nauce nowych języków programowania i technologii. Analizując sugestie kodu, programiści mogą lepiej zrozumieć różne podejścia do rozwiązywania problemów i odkrywać nowe wzorce projektowe.

A co z samą firmą? Rozszerzenie usługi Microsoft 365 Copilot o aplikacje i dane z linii biznesowej to krok, który może znacząco zwiększyć produktywność i efektywność w organizacji. Microsoft 365 Copilot to narzędzie wykorzystujące sztuczną inteligencję do wspomagania użytkowników w codziennej pracy, a jego integracja z aplikacjami biznesowymi otwiera nowe możliwości dla automatyzacji i lepszego wykorzystania danych.

Integracja Copilota z aplikacjami biznesowymi, takimi jak CRM, ERP czy systemy zarządzania projektami, umożliwia automatyczne generowanie raportów, analiz i rekomendacji na podstawie danych biznesowych. Dzięki temu, pracownicy mogą szybciej podejmować decyzje i reagować na zmieniające się warunki rynkowe.

Copilot może być również dostosowany do specyficznych potrzeb użytkowników w różnych działach firmy. Na przykład, w dziale sprzedaży może pomagać w tworzeniu spersonalizowanych ofert dla klientów, a w dziale HR – w automatyzacji procesów rekrutacyjnych. Wykorzystanie Copilota do automatyzacji procesów biznesowych, takich jak wprowadzanie danych, zarządzanie dokumentacją czy obsługa zapytań klientów, może znacząco zwiększyć efektywność pracy. Copilot może analizować dane z różnych źródeł i sugerować optymalne działania.

Ważnym aspektem rozszerzenia Copilota o aplikacje biznesowe jest zapewnienie bezpieczeństwa i prywatności danych. Microsoft 365 Copilot musi być zintegrowany w sposób, który chroni poufne informacje i jest zgodny z przepisami o ochronie danych osobowych.

Dobry programista i dobry menedżer nigdy nie przestają się uczyć. SI rozwija się tak szybko, że niemal każdy z branży wymaga korepetycji.

Build AI Day nie był ani pierwszą tego typu imprezą, ani zapewne też największą. W niczym to nie umniejsza istotności wydarzenia, bowiem Duże Modele Językowe i Generatywna SI to wynalazki relatywnie nowe. Nawet wśród specjalistów IT wciąż są osoby, które na temat tej technologii nie mają większego pojęcia. Tym bardziej wśród menedżerów i kierowników działów. Nic więc dziwnego, że Microsoft jako współautor rzeczonej rewolucji stara się edukować klientów jak tylko potrafi. Wydarzeń pokroju Build AI Day będzie więcej - a przekazana na nim wiedza jest dostępna w zasobach Microsoft Learn.

Już za dwa miesiące odbędzie się właściwy Microsoft Build. Kilkudniowe wydarzenie deweloperskie, które w tym roku skupiać się będzie w ogromnej mierze właśnie na GenAI i LLM-ach i na chmurze do tego przeznaczonej. Wydarzenie będzie dostępne w całości w Internecie, więc chociaż wirtualna obecność powinna być dla każdego dewelopera obowiązkowa. Co więcej, zapewne organizowane będą kolejne lokalne imprezy, podobne do relacjonowanego tu warszawskiego Build AI Day. Na dziś trudno o lepszą okazję do zdobywania wiedzy i wymiany doświadczeń. Obecność również obowiązkowa? Dla osób i firm nadal błądzących w tematyce GenAI - z całą pewnością.