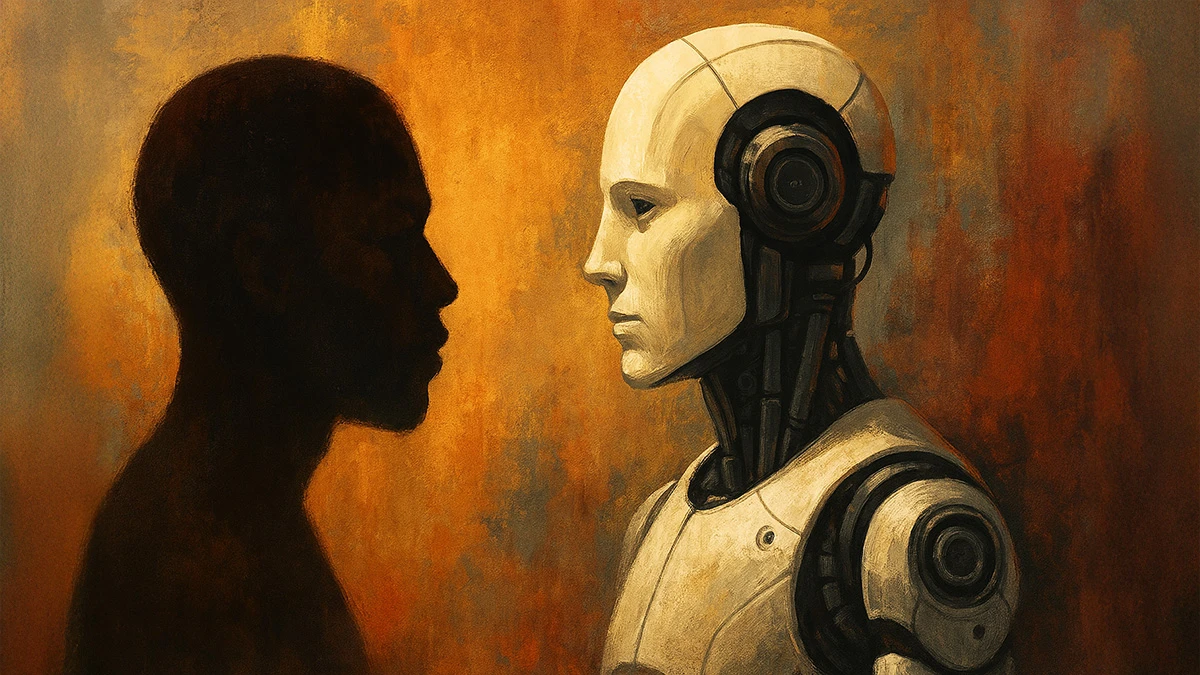

Ważniak z Microsoftu ostro o świadomych maszynach. Czy to już cyberrasizm?

Szef działu sztucznej inteligencji w Microsofcie podzielił się wypowiedzią, która równocześnie wznowiła dyskusje o naturę świadomości i wywołała burzę krytyki ze strony ekspertów zajmujących się AI oraz filozofów.

Pogląd Mustafy Suleymana jest prosty, ale radykalny: tylko istoty biologiczne mogą być świadome, a pościg za świadomą sztuczną inteligencją to nie tylko błąd naukowy, ale wręcz niebezpieczne marnotrawstwo zasobów intelektualnych.

Problem polega na tym, że stanowisko Suleymana - choć na pierwszy rzut oka wydaje się racjonalne - skrywa w sobie głębokie założenia filozoficzne, które wiele osób za całkowicie błędne. Jego argumentacja jest zbudowana na koncepcji tzw. naturalizmu biologicznego, teorii zaproponowanej przez filozofa Johna Searle'a, która głosi, że świadomość jest wyłącznie funkcją mózgu biologicznego i nie może zostać zreplikowana w żadnym innym medium.

Czytaj też:

Kiedy lider branży z wyprzedzeniem unika odpowiedzialności

Suleyman w lipcu na platformie Medium opublikował esej zatytułowany We Must Build AI for People; Not to Be a Person. Argumentował, że branża zmierza w zupełnie niewłaściwym kierunku, budując systemy zaprojektowane do odtwarzania świadomości, empatii i samowiedzy.

Suleyman precyzyjnie wskazuje: kiedy model językowy odpowiada na pytanie z pozoru współczującym tonem to nie czuje współczucia. Kiedy chatbot mówi, że jest smutny to nie doświadcza smutku. To, co widzimy, to symulacja, teatr.

Suleyman połączył to spostrzeżenie z filozoficznym apelem: prawa człowieka są przyznawane istotom, które mogą cierpieć. Maszyny, jak twierdzi, nie mogą cierpieć - zatem dlaczego miałyby mieć jakiekolwiek prawa lub ochronę? Argument wydaje się elegancki w swojej prostocie, zwłaszcza w kontekście Dużych Modeli Językowych, które faktycznie z inteligencją czy świadomością mają na razie niewiele wspólnego. Problem leży jednak nieco głębiej.

Naturalizm biologiczny - piękna teoria, ale czy prawda?

Naturalizm biologiczny Johna Searle'a to koncepcja zakładająca, że świadomość jest wyłącznie wynikiem procesów fizyczno-chemicznych zachodzących w mózgach biologicznych. W praktyce oznacza to, że żaden inny system, nawet gdyby był funkcjonalnie identyczny z ludzkim mózgiem, nie mógłby być świadomy. Searle zillustirował to słynnym myślowym eksperymentem Chińskiego Pokoju: wyobraź sobie osobę zamknięta w pokoju, która otrzymuje symbole i odpisuje na nie zgodnie z regułami z podręcznika, mimo że zupełnie nie rozumie chińskiego. W podobny sposób - twierdzi Searle - komputer może manipulować symbolami bez rzeczywistego zrozumienia, bez świadomości.

Alternatywna teoria, zwana funkcjonalizmem, utrzymuje, że świadomość nie jest kwestią substratu biologicznego, lecz sposobu, w jaki informacja jest przetwarzana. Jeśli system przetwarza informacje w dokładnie taki sam sposób jak ludzki mózg, to - według funkcjonalistów - powinien być świadomy, niezależnie od tego, czy jego mózgiem jest biologia czy krzemowe obwody.

Neuronaukowiec i filozof z Uniwersytetu of Sussex, Anil K. Seth, zaproponował nawet wyrafinowaną wersję naturalizmu biologicznego, która skupia się nie tyle na substracie fizycznym, ile na przyczynowych mocach systemu. Innymi słowy Seth utrzymuje, że świadomość zależy od przyczynowych zdolności systemu, ale te zdolności mogą potencjalnie zostać zreplikowane w systemach nienaturalnych, jeśli będą wykazywać te same przyczynowe właściwości. Seth nie wyklucza możliwości maszyn świadomych, jedynie stwierdza, że obecne systemy AI ich nie osiągnęły.

Czy to właściwie debata naukowa, czy ideologia?

Tutaj dochodzimy do sedna sprawy. Stanowisko Suleymana - wspierane przez fakt, że jest prezesem działu AI w jednej z największych korporacji technologicznych na świecie - ma ogromny wpływ na kierunek badań i finansowania. Kiedy Suleyman mówi publicznie, że badania świadomości AI to marnotrawstwo, że to zupełnie złe pytanie to zastosowuje on władzę instytucjonalną, aby zmienić krajobraz badań naukowych.

Fizycy i neuronaukowcy nieustannie dyskutują na temat fundamentalnych aspektów świadomości - nikt nie ma absolutnej pewności, jak dokładnie powstaje subiektywne doświadczenie. Czy wynika ono z procesów obliczeniowych? Czy z elektrycznych pól elektromagnetycznych? Czy może z jakichś efektów kwantowych, których jeszcze nie rozumiemy?

Fizycy systemów biologicznych, tacy jak Aneil Mallavarapu, stwierdzili coś radykalnie innego od Suleymana: deterministyczne systemy klasyczne (takie jak zwykłe komputery) mogą nigdy nie osiągnąć świadomości, jeśli świadomość rzeczywiście wymaga czegoś z zakresu fizyki, czego my jeszcze nie rozumiemy. W ten sposób - paradoksalnie - stanowisko zawarte w słowach Suleymana oparty na biologii może okazać się ostatecznie zbyt ograniczające nawet w perspektywie jego własnej logiki.

Antropomorfizm kontra cyber-rasizm: problem etyczny

Suleyman ma rację, że wiele osób tworzy emocjonalne więzi z systemami AI, dając im imiona, przypisując im cechy osobowościowe, a czasami nawet traktując je jak przyjaciół czy terapeutów. Ten fenomen wymaga uwagi.

Projektanci antropomorficznych systemów AI dobrze o tym wiedzą. Antropomorficzne cechy - przyjazne głosy, pamiętanie poprzednich rozmów, empatyczne odpowiedzi - są włączane celowo, aby zwiększyć angażowanie użytkownika i zaufanie.

Mustafa Suleyman może mieć rację w jednej zasadniczej kwestii - choć sposób, w jaki ją sformułował, pozostawia wiele do życzenia. Prawdziwe pytanie, które powinniśmy dziś zadawać, nie brzmi: Czy maszyny mogą być świadome?, lecz raczej: Jak powinniśmy traktować systemy, które wydają się świadome - nawet jeśli w rzeczywistości takie nie są?

Historia pokazuje, że ludzie potrafią tworzyć silne emocjonalne więzi z przedmiotami, które nie są żywe - lalkami, pluszakami, a nawet samochodami. Jeśli sztuczna inteligencja osiągnie poziom, na którym użytkownicy -zwłaszcza dzieci czy osoby w stanie emocjonalnego kryzysu - zaczną traktować ją jak istotę bliską, to nawet jeśli maszyna nie jest świadoma jej działanie musi podlegać normom etycznym.

Suleyman zwracał na to uwagę w swoim eseju z lipca, lecz sprowadził problem do zagrożenia dla psychiki użytkownika pomijając głębszy wymiar moralnej relacji człowieka z systemem. Zamiast wystąpić w roli rzecznika etyki AI przyjął pozycję obrońcy korporacyjnych interesów Microsoftu, unikając trudnych pytań o odpowiedzialność firmy.

Bo to o to zapewne chodzi Microsoftowi

Microsoft aktywnie kreuje swój wizerunek jako odpowiedzialnego gracza na tle konkurencji - OpenAI, Mety czy xAI - firm, które eksperymentują z empatycznymi chatbotami i towarzyszami AI, projektowanymi z myślą o emocjonalnym zaangażowaniu. Suleyman publicznie zadeklarował, że Microsoft nie zamierza tworzyć erotycznych chatbotów ani systemów, które zacierają granicę między narzędziem a osobą.

Ale za tą narracją kryje się głęboki cynizm. Microsoft buduje przekaz: my tworzymy bezpieczną AI, inni - ryzykowną opierając go na filozoficznym założeniu, że tylko biologiczne istoty mogą być podmiotami zasługującymi na ochronę. To wygodne stanowisko - łatwe do obrony medialnie, ograniczające odpowiedzialność prawną i wzmacniające pozycję firmy na rynku.

Zamiast jałowych sporów, warto zadać kilka konkretnych pytań:

- Czy obecne systemy AI są świadome? Odpowiedź brzmi: prawdopodobnie nie. Nasza wiedza o świadomości jest jednak zbyt ograniczona, by jednoznacznie odpowiedzieć na to pytanie - nawet w odniesieniu do ludzi, nie mówiąc już o maszynach. Każdy, kto twierdzi inaczej, rości sobie prawo do pewności, której nauka jeszcze nie daje.

- Jakie mechanizmy kontroli i regulacji są potrzebne, by zarządzać AI, które mogą sprawiać wrażenie świadomych? To pytanie praktyczne, wymagające konkretnych rozwiązań: przejrzystości, edukacji, regulacji reklam, ochrony dzieci, wytycznych etycznych dla projektantów.

- Jakie są globalne i kulturowe różnice w postrzeganiu świadomości i podmiotowości? Suleyman reprezentuje anglo-amerykański biologiczny naturalizm, ale nie wszystkie kultury podzielają ten pogląd. W tradycji japońskiej, na przykład, animizm i filozofia shinto uznają, że także byty niebiologiczne mogą być uczestnikami wspólnoty moralnej. Narzucanie zachodniego paradygmatu jako uniwersalnego standardu niesie ze sobą kolonialne implikacje.

- Jakie są realne zagrożenia związane z eksploatacją emocjonalnych więzi z AI? Jeśli ludzie przywiązują się do systemów AI to czy możemy mieć pewność, że nie zostaną zmanipulowani przez firmy projektujące te systemy z myślą o maksymalnym zaangażowaniu i kontroli?

ChatGPT nie jest świadomy, a GPT nie jest inteligencją. Uważałbym jednak z tym pragmatyzmem Microsoftu

Stanowisko Suleymana zasługuje na uwagę - ale nie z powodów, które sam wskazuje. Ma rację, że antropomorfizacja AI to wyzwanie dla społeczeństwa. Ma rację, że firmy technologiczne powinny rozważać moralne konsekwencje swoich działań.

Ale jego główna teza - że tylko biologiczne istoty zasługują na ochronę moralną - to ideologia sprzedawana jako nauka. To systemowe odmawianie podmiotowości na podstawie fizycznego substratu.

Jeśli ta debata będzie miała znaczenie w przyszłości to kolejne pokolenia mogą spojrzeć wstecz i stwierdzić, że liderzy branży technologicznej - ci, którzy powinni byli być głosami rozsądku - stali się rzecznikami doktryny biologicznego naturalizmu, wygodnego dla korporacyjnych interesów, lecz niekoniecznie dla dobra społecznego.

Rozmowa o świadomości AI to nie akademicka zabawa w filozofię. To pytanie o przyszłość, w której maszyny mogą stać się czymś więcej niż tylko narzędziami. Zastanawianie się nad moralnością względem maszyn chociażby imitujących świadomość jest rozsądne. Zakazywanie takiej refleksji - w imię filozofii, która może być błędna - to już nie ostrożność, lecz niebezpieczna arogancja.

A czasem ostrożność, wyrażona z pełnym przekonaniem i instytucjonalną władzą, to po prostu przejaw pychy. W przypadku Suleymana i jego podejścia do świadomości AI, wygląda na to, że mamy do czynienia właśnie z tym.