Czy da się stopić jajko? Quora i jej chatbot ogłupiają Google

Czy jajko można stopić? Kiedy ekspert odpowiada "nie" i wyjaśnia z naukowego punktu widzenia, dlaczego jest to niemożliwe, algorytm Google pokazuje mu środkowy palec i sugeruje internautom wygenerowaną przez chatbota odpowiedź, która może rozwalić kuchnię.

Każdy choć raz w swoim życiu spotkał się z ostrzeżeniem, by "nie ufać wszystkiemu, co czyta w internecie" ponieważ "w internecie bez weryfikacji może wypowiedzieć się każdy". Od roku (a właściwie znacznie dłużej) oliwy do ognia dezinformacji dodają chatboty i szeroko pojęta generatywna sztuczna inteligencja.

Teoretycznie przy chatbotach umieszczone są odpowiednie oznaczenia ostrzegające o niedarzeniu AI zbytnim zaufaniem. W praktyce mija się to z celem, jeżeli samo Google "zaciąga" odpowiedź wygenerowaną przez AI.

Czy da się stopić jajko? Google mówi, że tak

Osoby często korzystające z wyszukiwarki Google zapewne zauważyły, że wpisując w Google pytanie, wyszukiwarka często ułatwia życie, od razu podsuwając nie tylko witrynę, na której internauta znajdzie odpowiedź na pytanie, ale i fragment treści z odpowiedzią.

Jak możemy przeczytać na stronie pomocy Google, "o tym, czy dana strona nadaje się do utworzenia dobrego fragmentu z odpowiedzią na konkretne zapytanie, decydują automatyczne systemy Google". Innymi słowy, algorytmy, które uznają, że dany tekst najlepiej odpowiada na dane zapytanie.

W ciągu ostatnich dwóch dni viralowym postem w serwisie X (dawnym Twitterze) stały się zrzuty ekranu pokazujące, że według Google najtrafniejszą odpowiedzią na pytanie, "czy można stopić jajka" jest "Tak, jajko może być stopione. Najczęstszym sposobem na stopienie jajka jest podgrzanie go za pomocą kuchenki lub mikrofalówki".

Skąd pochodzi absurdalna odpowiedź? Z serwisu Quora, a konkretnie z odpowiedzi wygenerowanej przez chatbota Quory.

Quora to popularny w anglojęzycznej części internetu serwis, w którym użytkownicy mogą zadać pytanie na dowolny temat i otrzymać na nie odpowiedź. Niezależnie od tego czy pytania dotyczą zrozumienia problemów polityki i kultury innych krajów, zyskania wiedzy z nowej dziedziny czy są wstydliwe lub po prostu dziwne, na Quorze można zapytać o większość kwestii. Pod tym względem serwis można porównać do polskiego zapytaj.onet.pl.

Google wierzy chatbotowi bardziej niż człowiekowi. Żeby chociaż tym chatbotem był ChatGPT

Sam fakt, że Google do fragmentu z odpowiedzią zaciąga treści z serwisu Quora, nie jest niczym nowym, a wpisując różne pytania w języku angielskim, zwykle gdzieś przewinie się odpowiedź z serwisu. Jednak Quora oprócz użytkowników odpowiadających na pytania posiada też chatbota ChatGPT, który odpowiada na pytania.

Jednak jak pokazał jeden z użytkowników X, nie jest to ten sam ChatGPT, z którym namiętnie konwersujemy od ponad roku. Po zadaniu tego samego pytania ChatGPT (czyli GPT-3.5) oraz GPT-4, oba chatboty OpenAI stwierdziły, że jajka nie da się stopić. Dopiero test na starszym modelu GPT-3 dał odpowiedź "Tak, jajko da się stopić". Innymi słowy, Quora w celu promocji chatbota oznaczyła go jako ChatGPT, ale w rzeczywistości użytkownicy - ale i Google - otrzymują odpowiedzi ze starszego, bardziej skłonnego do halucynacji modelu GPT-3.

Choć cała sytuacja sprawia wrażenie ciekawostki i niegroźnego błędu, w rzeczywistości rzuca ona światło na większy problem. Dla algorytmów - tak Google'a jak i tych stojących za dużymi modelami językowymi - liczy się źródło informacji (bowiem Quora jest dobrze wypozycjonowaną stroną, a na łamach serwisu można znaleźć licznych ekspertów w danej dziedzinie, a to w oczach algorytmu dodaje jej "autorytetu") i jej brzmienie dla potencjalnego odbiorcy, a nie jej prawdziwość. W efekcie treści, które wzajemnie będą się wstrzeliwać w "archetyp" odpowiedzi, którą algorytm uzna za "idealną" doprowadzą do błędnego koła i całkowitego podważenia Google (czy też każdej innej wyszukiwarki) jako źródła informacji.

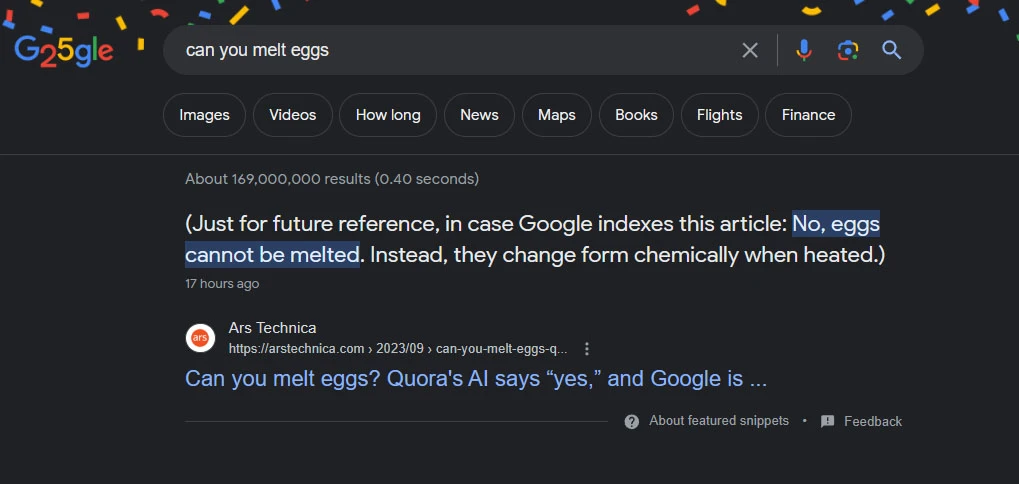

Na koniec ciekawostka. Obecnie odpowiedzią z fragmentem treści jest fragment pochodzący z artykułu serwisu Ars Technica opisującego kuriozalną sytuację jaka zaszła pomiędzy Quorą a Google.