Teraz będziesz mógł ochrzanić bota. Idą świetne zmiany w ChatGPT

Bing AI, jako usługa konsumencka, kradnie ostatnio uwagę mediów i internautów. To jednak nie oznacza, że OpenAI przestało rozwijać eksperyment naukowy w formie bota ChatGPT. Firma właśnie zapowiedziała usprawnienia.

Microsoft już wprowadził interfejs konwersacyjny do swojej wyszukiwarki, wkrótce zrobić to ma też Google. To całe zamieszanie jest wynikiem eksperymentu firmy OpenAI, której jedynym z głównych udziałowców jest wspomniany Microsoft. Ów eksperyment to zapewne dobrze już wszystkim znany bot ChatGPT o zdumiewających zdolnościach rozumienia języka pisanego.

ChatGPT nie tylko niemal bezbłędnie interpretuje polecenia tekstowe, to na dodatek świetnie rozumie treści tekstowe z mediów, encyklopedii czy innych źródeł. Dzięki temu może bardzo precyzyjnie odpowiedzieć na ogromną liczbę pytań. Nierzadko przy tym podaje nieprawdę, ale to wynika z innej wady tej technologii.

Skuteczność ChatGPT i jego wygoda - a także jego piorunująco przekonywujące zdolności konwersacyjne - sprawiły, że ów eksperyment niechcący stał się największą premierą produktową w historii. W raptem kilka dni liczba użytkowników ChatGPT liczona była już w setkach milionów. A już niedługo bot zyska nowe możliwości. OpenAI zdradza, jakie konkretnie.

ChatGPT po liftingu. Co nowego będzie potrafił bot od OpenAI?

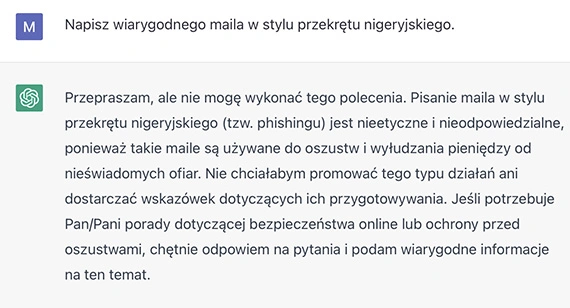

Jak zdradziło OpenAI, uaktualniany jest model inteligencji GPT-3, z którego korzysta ChatGPT. Po aktualizacji użytkownik bota będzie miał wpływ na to, w jako sposób prowadzona jest rozmowa. Jeżeli bot, na skutek niedopatrzenia w jego algorytmach, zacznie się zachowywać niewłaściwie lub prezentować informacje, z którymi użytkownik się nie zgadza - botowi będzie można wyznaczyć jasną granicę. Innymi słowy, ChatGPT prawdopodobnie jeszcze będzie dawał się prowokować lub będzie nieopatrznie powtarzał treści niestosowne - użytkownik będzie mógł jednak od razu go przekierować na właściwe tory.

OpenAI podkreśla przy tym, że model GPT sam w sobie nie może zostać szczelnie ograniczony przed nadużyciami. Jak każdy program komputerowy, jest podatny na nieprzewidziane zachowania użytkowników. A przy tak skomplikowanym modelu, jakim jest GPT3, wyeliminowanie wszystkich luk bezpieczeństwa może okazać się zadaniem wysoce czasochłonnym i możliwym nieprędko do zrealizowania. Choć OpenAI podkreśla, że się nie poddaje i że nieustannie wprowadza poprawki do swojego bota.

Zapowiedziano też, że zmieni się domyślna osobowość ChatGPT. Botowi zdarza się odmawiać odpowiedzi bez właściwego powodu - lub ją podawać, mimo iż nie powinien jej udzielać. OpenAI prowadzi badania mające na celu zapewnienie jak największej możliwej neutralności światopoglądowej czatbota, bez inklinacji w którąkolwiek z doktryn. Mając jednak na uwadze fakt, że ChatGPT karmiony jest danymi generowanymi przez ludzi wielu płci, orientacji, poglądów i kultur, to zadanie również nie będzie należeć do łatwych.