To będzie sztos. Dogadasz się z wyszukiwarką Google nie tylko słowami

Google Multiwyszukiwanie to technologia, która była już testowana w Stanach Zjednoczonych. Niebawem trafi do Polski, pozwalając użytkownikom na porozumiewanie się z Wyszukiwarką nie tylko słowami. To jednak nie koniec nowości. Turyści i podróżnicy powinni być usatysfakcjonowani.

Jak większość użytkowników obsługuje Wyszukiwarkę Google? Najczęściej poprzez wpisanie w formularz danego zapytania. Jaka będzie jutro pogoda? Albo iphone 14 cena. Albo spider’s web technologie. Można też te zapytania wprowadzić głosowo, ale przekaz informacji w gruncie rzeczy jest ten sam. Jest też druga, nieco mniej popularna, ale również powszechnie znana metoda.

Czytaj też:

To Google Grafika, czyli moduł Wyszukiwarki Google do wyszukiwania zdjęć, obrazków i ilustracji. Można w jej ramach, na przykład, wysłać do aplikacji zdjęcie, by ta znalazła podobne fotografie i materiały wizualne. Nie można jednak w łatwy sposób łączyć tych dwóch mechanizmów. Można szukać albo tekstem (wprowadzanym z klawiatury bądź głosowo), albo obrazem. To niebawem się zmieni.

Google Multiwyszukiwanie, czyli kiedy słowo i obraz znaczą tyle samo.

Google Multiwyszukiwanie w ramach eksperymentu działał już w aplikacji Google, jeżeli język telefonu ustawiony był na angielski. Teraz funkcja ta będzie trafiać do wszystkich użytkowników w przeciągu najbliższych tygodni, niezależnie od ustawionego języka. Pozwala ona łączyć obrazy i tekst w jedno zapytanie do Wyszukiwarki.

Jakie zapytania można dzięki temu tworzyć? Użytkownik może, na przykład, sfotografować czerwoną sukienkę, dodać ją do zapytania i dopisać niebieska. Wyszukiwarka spróbuje wówczas odnaleźć podobnie wyglądające sukienki, ale we wskazanym kolorze. Inny przykład to sfotografowanie kwiatka doniczkowego i dopisanie zapytania jak dbać. Wyszukiwarka wówczas powinna wyświetlić informację o tym, jak pielęgnować ten konkretny gatunek rośliny.

Rzeczywistość rozszerzona w służbie turystyki.

Google już od pewnego czasu potrafi tłumaczyć w czasie rzeczywistym rejestrowane w obiektywie aparatu napisy. Można więc skierować telefon, na przykład, na obcojęzyczne menu, a oczom użytkownika zamiast obcych słów ukażą się te w języku dla użytkownika zrozumiałym. Teraz będzie ładniej i czytelniej.

Do tej pory tekst przetłumaczony był nakładany niczym warstwa na tekst oryginalny. Już niebawem to się zmieni i na ekranie telefonu tekst przetłumaczony będzie nieodróżnialny od oryginału. Algorytmy SI na żywo przetwarzają każdy piksel rejestrowanego obrazu, by nakładać odpowiednio litery tak, jakby od zawsze się znajdowały na rejestrowanym obiekcie.

Odkrywanie na nowo własnego otoczenia. Sąsiedzkie klimaty w Mapach Google.

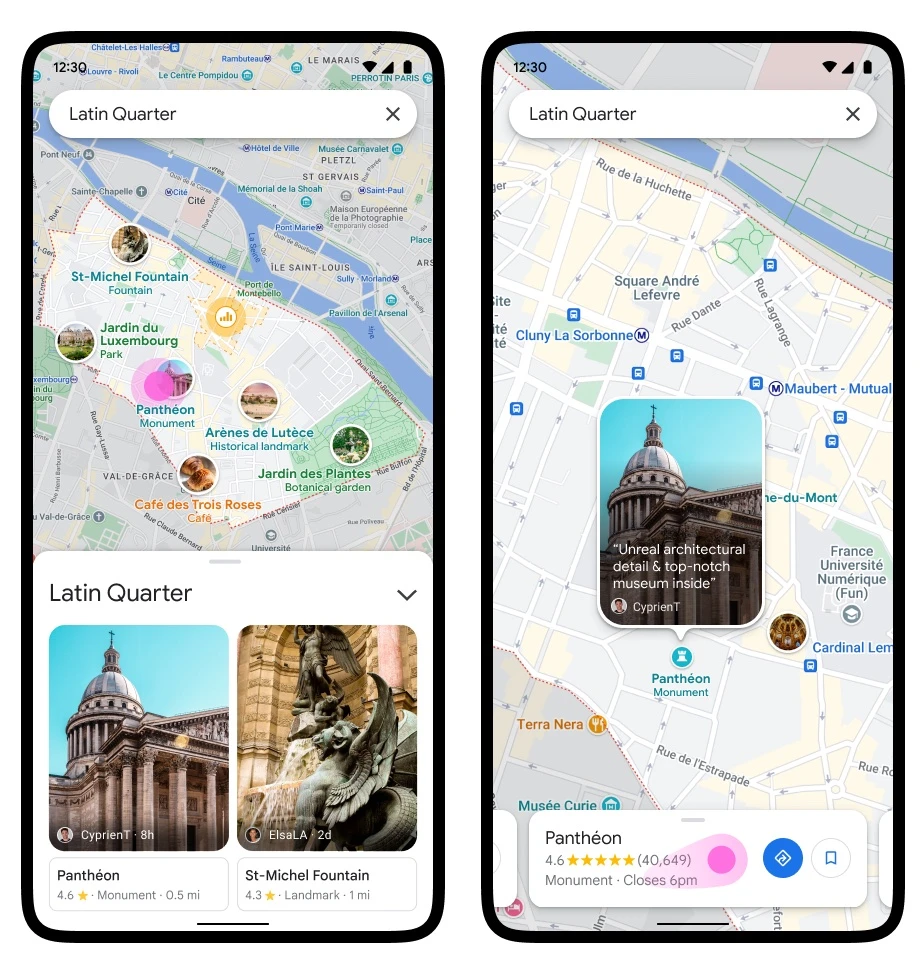

Neighborhood vibe to nieoficjalna nazwa nowego widoku dla mobilnych Map Google, który pojawi się już niebawem na iPhone’ach i telefonach z Androidem. Za jego sprawą można wskazać sąsiedztwo (własne lub inne), a Mapy Google przedstawią je w nowy, atrakcyjny sposób. By zachęcić użytkownika do odkrywania atrakcji, ale też takich, które faktycznie mają jakąś wartość.

Funkcja wykorzystuje sztuczną inteligencję i dane zbierane od wszystkich użytkowników Map Google - w tym wystawiane przez nich opinie, wysłane zdjęcia czy filmy - by następnie zaprezentować w atrakcyjny dla oka i czytelny sposób najciekawsze miejsca, które warto poznać. Ów widok imersyjny zawiera też przydatne wskazówki, takie jak pogoda czy informacje o tym, jak zatłoczone jest dane miejsce.

Funkcja zostanie rozszerzona o widok z lotu ptaka na 250 punktów orientacyjnych, a w najbliższych miesiącach widok imersyjny pojawi się w pięciu dużych miastach (i w kolejnych niewiele później). W Polsce nowe widoki będą dostępne w następujących miejscach: Zamek Królewski w Warszawie, Centrum Nauki Kopernik, Muzeum Powstania Warszawskiego, POLIN Muzeum Historii Żydów Polskich, Pałac Prezydencki i Pałac Kultury i Nauki.

Eko-podróżowanie dla wszystkich.

Niedawno Google wprowadził do Map nowy algorytm wytyczania tras, który na życzenie użytkownika wyznacza taki przebieg podróży, by ta pozostawiła minimalny ślad węglowy. Ów algorytm jest już dostępny dla twórców aplikacji, którzy wykorzystują dane z Map Google i ich API. W aplikacjach innych firm dostępne będą wszystkie związane z tym algorytmem funkcje, w tym możliwość wyliczania szacunkowego kosztu zużycia paliwa czy wskazywanie rodzaju posiadanego w pojeździe silnika.