Znaleźliśmy kontr-algorytm na hejt i polaryzację. Social media staną się używalne?

Polaryzacja polityczna w mediach społecznościowych od lat uchodzi za jedno z największych zagrożeń dla zdrowia demokracji.

Algorytmy, które miały ułatwiać nam dostęp do informacji, w praktyce często wzmacniają podziały i podsycają emocje. Teraz jednak zespół badaczy ze Stanford University, University of Washington i Northeastern University proponuje rozwiązanie. Ich narzędzie - opisane właśnie w prestiżowym czasopiśmie Science - pokazuje, że z polaryzacją można walczyć skutecznie, bez cenzury i bez konieczności współpracy z samymi platformami.

Wystarczy wtyczka. Najlepsze? Nie trzeba nikogo pytać o zgodę

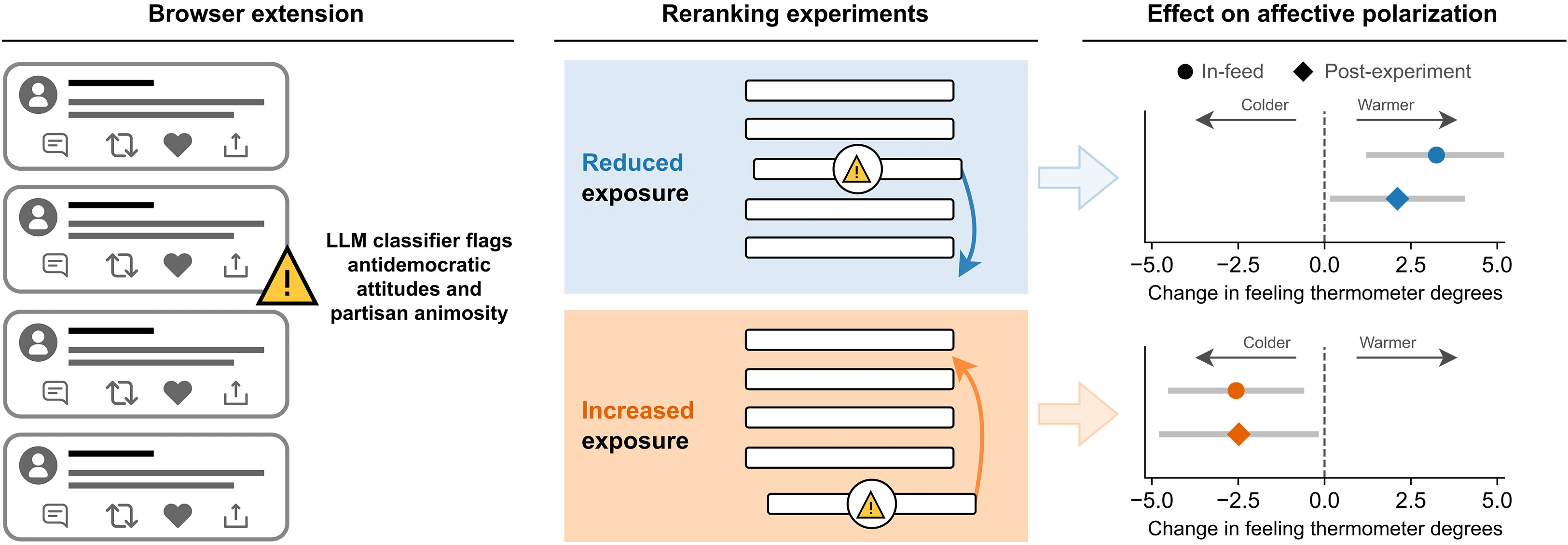

Projekt kierowany przez prof. Michaela Bernsteina ze Stanford School of Engineering oraz dr. Tiziano Piccardiego (dziś związanego z Johns Hopkins University) zaowocował stworzeniem rozszerzenia do przeglądarek Chrome i Edge. Wtyczka działa w czasie rzeczywistym i przechwytuje kolejność postów w serwisie X (dawniej Twitter). Co ważne - nie usuwa żadnych treści. Zamiast tego przesuwa najbardziej antagonistyczne wpisy niżej w feedzie, tak aby użytkownik musiał przewinąć dalej, by je zobaczyć.

Czytaj też:

Całość opiera się na dużym modelu językowym GPT-3.5 Turbo, który analizuje każdy post pod kątem ośmiu kategorii określanych jako AAPA (Antidemocratic Attitudes and Partisan Animosity) - czyli postaw antydemokratycznych i wrogości partyjnej. Wśród nich znalazły się m.in. poparcie dla przemocy politycznej, sprzeciw wobec współpracy między partiami czy stronnicza interpretacja faktów. Posty otrzymują wynik od 0 do 8, a te z wynikiem 4 lub wyższym trafiają niżej w hierarchii wyświetlania. Cały proces dodaje zaledwie około trzech sekund opóźnienia przy pierwszym ładowaniu feeda - praktycznie niezauważalne dla użytkownika.

Test w samym środku politycznej burzy

Badanie przeprowadzono w jednym z najbardziej napiętych momentów amerykańskiej sceny politycznej - latem ubiegłego roku, tuż przed wyborami prezydenckimi. To wtedy doszło do próby zamachu na Donalda Trumpa, rezygnacji Joe Bidena z kandydowania i nominacji Kamali Harris jako kandydatki Demokratów. Trudno o bardziej wymagający kontekst do sprawdzenia, jak treści polaryzujące wpływają na emocje użytkowników.

W eksperymencie uczestniczyło 1256 osób - użytkowników X, którzy identyfikowali się jako Demokraci (66 proc.) lub Republikanie (34 proc.). Podzielono ich na grupy i przez dziesięć dni testowano dwa scenariusze: trzy dni bazowe bez interwencji, a następnie siedem dni z aktywną modyfikacją feedów.

- W wariancie Reduced Exposure wszystkie posty AAPA trafiały na dół feeda, co oznaczało redukcję ekspozycji o 89,6 proc. - z 10 proc. do zaledwie 1,04 proc. treści.

- W wariancie Increased Exposure posty AAPA były sztucznie promowane wyżej, zwiększając ekspozycję o 26,4 proc.

Rezultat? Niektórych wciąż dziwi

Efekty okazały się nie tylko statystycznie istotne, ale też symetryczne. Uczestnicy, którym ograniczono kontakt z treściami AAPA deklarowali o 2,11 stopnia cieplejsze uczucia wobec przeciwników politycznych na 100-stopniowej skali termometru uczuć. Ci, którym ekspozycję zwiększono, ochłodzili swoje emocje o 2,48 stopnia.

Na pierwszy rzut oka liczby mogą wydawać się niewielkie, ale w świecie badań nad polaryzacją odpowiadają one trzem latom naturalnych zmian w polaryzacji afektywnej. A warto pamiętać, że Stany Zjednoczone od czterech dekad notują największy wzrost polaryzacji spośród wszystkich badanych demokracji - średnio o 4,8 punktu na dekadę.

Co równie ważne efekt był dwupartyjny - działał zarówno na liberałów, jak i konserwatystów, bez różnic istotnych statystycznie. Badacze mierzyli także emocje w czasie rzeczywistym, dzięki ankietom osadzonym w feedzie. Zmniejszona ekspozycja na treści AAPA obniżyła poziom złości o 5,05 punktu i smutku o 3,68 punktu. Zwiększona ekspozycja wywołała symetryczny wzrost tych emocji.

Co dalej?

Autorzy badania nie mają złudzeń: ich eksperyment ma swoje ograniczenia. Przeprowadzono go na próbie amerykańskich użytkowników w wyjątkowo gorącym okresie politycznym, ograniczając się do wersji webowej platformy X. Wyniki mierzono krótkoterminowo - poprzez reakcje w feedzie i ankiety tuż po zakończeniu eksperymentu. Nie wiadomo więc, czy efekt utrzymałby się w dłuższej perspektywie, gdy emocje opadną, a codzienność wróci do normy.

Mimo to implikacje są jednoznaczne. Jak podsumował profesor Michael Bernstein: Algorytmy social mediów bezpośrednio wpływają na nasze życie, ale do tej pory tylko platformy miały możliwość ich zrozumienia i kształtowania. Wykazaliśmy podejście, które daje tę moc badaczom i użytkownikom końcowym.

Zespół badawczy sugeruje, że narzędzie mogłoby zostać rozwinięte w kierunku dania użytkownikom bezpośredniej kontroli nad algorytmami. Innymi słowy - każdy z nas mógłby decydować, jakie treści są promowane, a jakie odsuwane na dalszy plan. Nie tylko na platformie X, ale potencjalnie także w innych serwisach społecznościowych.

Badanie wpisuje się również w szerszy kontekst europejskiej debaty o regulacji platform cyfrowych w ramach Digital Services Act (DSA). Jeśli algorytmy faktycznie wpływają na polaryzację, a jednocześnie platformy mają finansową motywację by ją podtrzymywać - bo treści wywołujące silne emocje generują więcej zaangażowania - to regulatorzy mogą uznać, że istnieje uzasadnienie dla wymuszenia większej transparentności, a nawet wprowadzenia konkretnych standardów projektowania algorytmów. Jeśli algorytmy kształtują nasze emocje i postawy polityczne to możliwość ich niezależnego audytu staje się nie tylko kwestią naukową, ale wręcz fundamentem zdrowej demokracji.