DeepSeekMath-V2 szokuje. Wygrywa najważniejsze konkursy matematyczne

Chiński startup DeepSeek zaprezentował model DeepSeekMath-V2, który w kilka miesięcy dokonał rzeczy, o których jeszcze niedawno mówiono, że są poza zasięgiem maszyn.

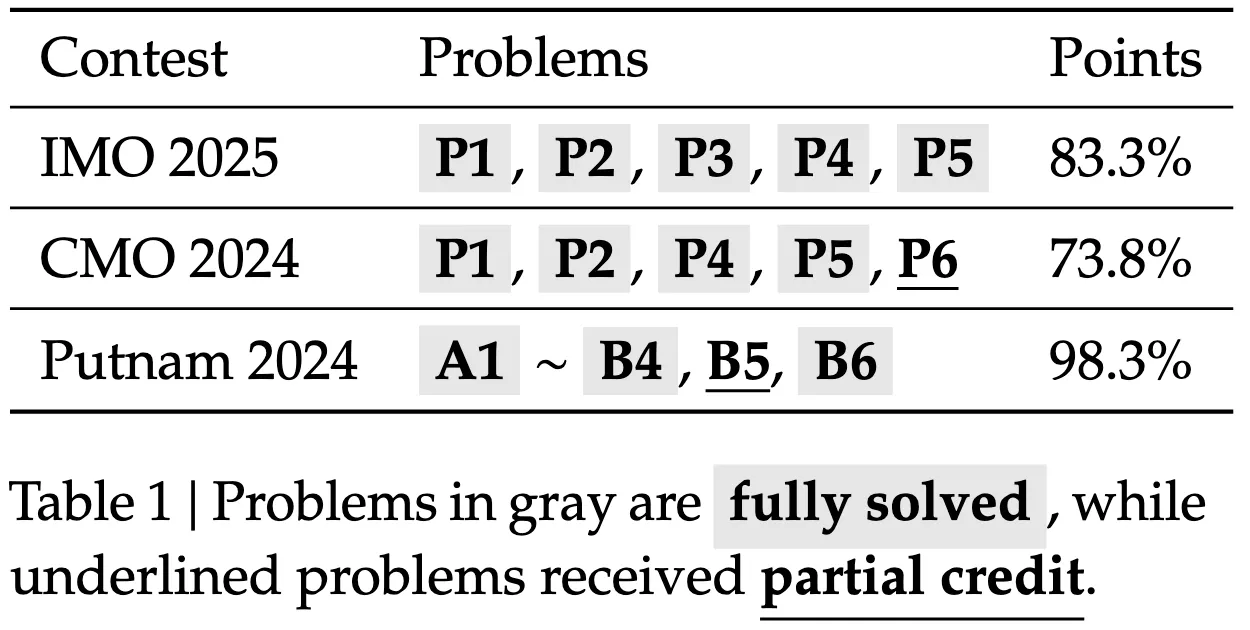

AI zdobyła złoty medal na Międzynarodowej Olimpiadzie Matematycznej (IMO) 2025, triumfowała w chińskiej CMO 2024, a w legendarnym konkursie Putnam uzyskała 118 punktów na 120 możliwych - wynik, który bije najlepszy rezultat człowieka (90 punktów).

Podobno chodzi tu o architekturę

Dotychczasowe modele AI miały jedną zasadniczą słabość: potrafiły podać poprawną odpowiedź, ale często brakowało im spójnego, logicznego rozumowania. DeepSeekMath-V2 przełamuje ten schemat dzięki architekturze opartej na wielopoziomowej weryfikacji.

Czytaj też:

Technicznie rzecz biorąc model bazuje na DeepSeek-V3.2-Exp-Base i wykorzystuje architekturę Mixture-of-Experts (MoE) z oszałamiającą liczbą 685 mld parametrów. Podczas wnioskowania uruchamia równolegle wiele potencjalnych dowodów, aż osiągnie wysoki poziom pewności co do rozwiązania. Co ważne - nie korzysta z zewnętrznych narzędzi, kalkulatorów czy interpreterów kodu. Całość odbywa się w czystej algebrze i logice języka naturalnego.

Sukces DeepSeekMath-V2 to także triumf koncepcji test-time compute. W tym paradygmacie model nie jest ograniczony wyłącznie do tego, czego nauczył się w trakcie treningu. Gdy napotyka trudny problem może przeznaczyć więcej mocy obliczeniowej na proces rozumowania - uruchamiając równolegle różne ścieżki i wybierając najlepszą.

Konkurencja z Zachodem i matematyczna gonitwa

DeepSeekMath-V2 pojawił się w momencie, gdy również i zachodni giganci - OpenAI i Google DeepMind - osiągnęli złote medale na IMO 2025. Oba zespoły rozwiązały pięć z sześciu zadań, zdobywając po 35 punktów. To wynik, który wśród ludzkich uczestników osiąga zaledwie około 10 procent najlepszych.

Jeszcze rok wcześniej DeepMind mogło pochwalić się jedynie srebrnym medalem. Ich systemy AlphaProof i AlphaGeometry wymagały tłumaczenia problemów na formalny język Lean, a obliczenia zajmowały nawet kilka dni. Dziś model Gemini Deep Think działa end-to-end w języku naturalnym, tworząc rygorystyczne dowody w ramach 4,5-godzinnego limitu konkursowego. To pokazuje jak gwałtownie przyspieszył rozwój tej technologii.

Transparentność kontra tajemnica

Największa różnica między DeepSeekiem a zachodnimi rywalami? Pełna transparentność. Podczas gdy OpenAI i Google skrywają szczegóły swoich architektur to chiński startup otwarcie je publikuje. DeepSeek stawia na open source, a coraz więcej amerykańskich startupów wybiera chińskie modele z otwartym źródłem, by obniżyć koszty. Jeśli DeepSeek udostępnia swoje rozwiązania za darmo to konkurenci nie mogą łatwo uzasadnić wysokich opłat za podobne usługi. To zmienia reguły gry na rynku. Nie jest to odosobniony przypadek. Baidu, Alibaba czy Zhipu AI również otwierają swoje modele, budując alternatywę dla zamkniętych systemów ze Stanów Zjednoczonych. Azja gra szybko, agresywnie i transparentnie.

Postępy DeepSeekMath-V2 sugerują, że AI zbliża się do punktu, w którym będzie w stanie rozwiązywać abstrakcyjne problemy badawcze - domenę dotąd zarezerwowaną dla ludzi. Ale wraz z tym rośnie także znaczenie geopolityczne. Sukcesy DeepSeeka są nie tylko naukowe - to także narzędzie w globalnej rywalizacji technologicznej. Paradoksalnie otwartość chińskiego modelu może pomóc zachodnim laboratoriom w uzasadnianiu tempa ich własnych badań. AI staje się polem bitwy nie tylko między firmami, ale i państwami. DeepSeekMath-V2 nie ogranicza się do jednej olimpiady. Model osiąga świetne wyniki w wielu prestiżowych benchmarkach matematycznych.

Zachód wciąż dominuje, ale chińskie modele open-source błyskawicznie skracają dystans. DeepSeekMath-V2 jest najgłośniejszym sygnałem tej transformacji - i ostrzeżeniem, że era zamkniętych, ekskluzywnych systemów może się kończyć. AI nie tylko odpowiada na pytania, ale rozumuje z rygorem godnym Medalu Fieldsa. A to zmienia wszystko.