AI nabiera się na nigeryjskiego księcia. Microsoft czaruje: będzie lepiej

Microsoft wprowadza do Windowsa 11 agentów AI, którzy mają działać w tle, wykonując za nas zadania. I choć brzmi to kusząco, to pojawia się fundamentalne pytanie: czy naprawdę możemy zaufać sztucznej inteligencji z dostępem do naszych plików, aplikacji i danych? Microsoft, autor tej rewolucji, oczywiście twierdzi że tak.

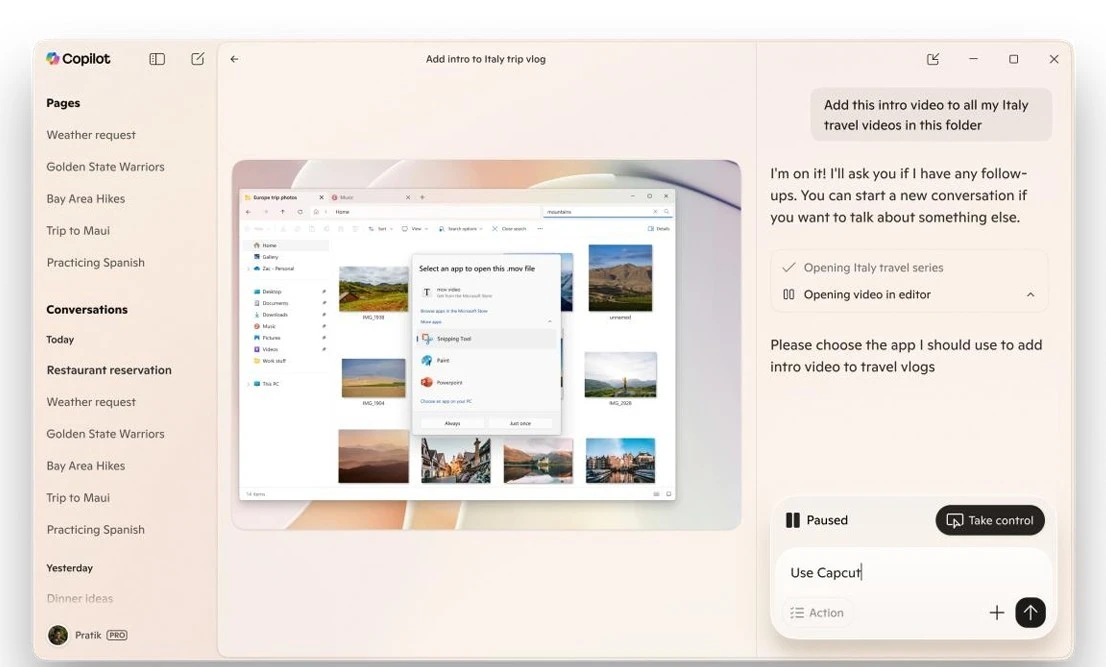

Microsoft ogłosił właśnie eksperymentalną funkcję o nazwie Copilot Actions, która w nadchodzących tygodniach trafi do użytkowników Niejawnego programu testów systemu Windows w ramach Copilot Labs. Copilot Actions to agent AI zdolny do interakcji z aplikacjami i plikami na twoim komputerze, wykorzystując zaawansowane rozumowanie i wizję komputerową do wykonywania złożonych zadań.

W praktyce oznacza to, że możesz poprosić agenta o zaktualizowanie dokumentów, uporządkowanie plików, zarezerwowanie biletów czy wysłanie e-maili - i Copilot zrobi to za ciebie, klikając, przewijając i wpisując tekst dokładnie tak, jak zrobiłby to człowiek.

Czytaj też:

Dlaczego to w ogóle może być niebezpieczne?

Zanim przejdziemy do rozwiązań to warto zrozumieć problem. Agenci AI dysponują potężnymi możliwościami, ale jednocześnie mają swoje ograniczenia - czasami halucynują i generują nieoczekiwane odpowiedzi. Co gorsza, wprowadzają zupełnie nowe rodzaje zagrożeń bezpieczeństwa. Jednym z najpoważniejszych jest cross-prompt injection (XPIA) - atak polegający na tym, że złośliwa treść ukryta w elementach interfejsu użytkownika lub dokumentach może przejąć kontrolę nad instrukcjami agenta, prowadząc do niezamierzonych działań takich jak kradzież danych czy instalacja malware.

Problem nie jest teoretyczny. W czerwcu badacze z Aim Security odkryli w Microsoft 365 Copilot lukę o nazwie EchoLeak (CVE-2025-32711), która pozwalała na przeprowadzenie pierwszego znanego ataku typu zero-click na agenta AI. Atakujący mógł wywołać atak po prostu wysyłając e-mail do użytkownika - bez żadnego phishingu, malware’u czy nawet kliknięcia od ofiary. Agent AI, który miał pomagać, mógł zostać wykorzystany do kradzieży poufnych informacji z dokumentów, arkuszy kalkulacyjnych i czatów.

W środowisku, gdzie agent ma dostęp nie tylko do danych, ale też do narzędzi - systemu plików, API, aplikacji - zwykły atak typu prompt injection może przerodzić się w pełnoprawną lukę typu Remote Code Execution. To właśnie dlatego Microsoft podchodzi do tematu z taką uwagą.

Trzy filary bezpieczeństwa agentów AI według Microsoftu

Microsoft wprowadza zestaw trwałych zasad bezpieczeństwa i prywatności, które muszą być spełnione, aby korzystać z nowych funkcji agentów w Windows 11. To nie są puste obietnice - to konkretne mechanizmy wbudowane w system operacyjny.

Pierwsza zasada: dedykowane konta dla agentów. Windows 11 umożliwia teraz agentom działanie na osobnych, dedykowanych kontach - zupełnie odrębnych od konta użytkownika na urządzeniu. To fundamentalna zmiana. Dzięki niej można stosować specyficzne zasady bezpieczeństwa dla agentów, które różnią się od reguł dla kont ludzkich użytkowników. Możesz udostępniać agentom dostęp do plików i zasobów w taki sam sposób, w jaki robisz to z członkami rodziny czy współpracownikami. Co równie ważne - wyraźnie oddziela to pracę wykonywaną przez agenta od działań użytkownika komputera.

Druga zasada: ograniczone uprawnienia. Agent startuje z minimalnymi uprawnieniami i uzyskuje dostęp wyłącznie do zasobów, które użytkownik wyraźnie mu udostępni - na przykład lokalnych plików. Jest jasno określona granica dla działań agenta i nie ma on możliwości wprowadzania zmian na urządzeniu bez twojej interwencji. Dostęp można w każdej chwili odwołać. Copilot Actions będzie miał dostęp tylko do ograniczonego zestawu znanych folderów użytkownika - takich jak Dokumenty, Pobrane, Pulpit czy Zdjęcia - oraz innych zasobów dostępnych dla wszystkich kont w systemie. Standardowe mechanizmy bezpieczeństwa Windows, takie jak listy kontroli dostępu (ACL), pomagają zapobiegać nieautoryzowanemu użyciu.

Trzecia zasada: zaufanie operacyjne. Agenci integrujący się z Windowsem muszą być podpisani przez zaufane źródło, dzięki czemu złośliwe lub źle działające agenty mogą być odwołane i zablokowane za pomocą szeregu środków obronnych, takich jak walidacja certyfikatów i oprogramowanie antywirusowe. To nie jest opcjonalne - to wymóg.

Agent workspace - jak działa izolowanie agenta?

Agent workspace to środowisko, w którym agenci mogą pracować a zarazem które zapewnia szczelną izolację i szczegółowe uprawnienia. Agent workspace daje agentowi możliwości takie jak własny pulpit, jednocześnie ograniczając widoczność i dostęp agenta do aktywności pulpitu użytkownika.

W praktyce oznacza to, że agent działa w osobnej sesji Windowsa, co pozwala mu na interakcję z aplikacjami równolegle do własnej sesji użytkownika. Dla typowych operacji takie rozwiązanie jest bardziej efektywne niż pełna maszyna wirtualna taka jak Windows Sandbox, a jednocześnie zapewnia izolację bezpieczeństwa, obsługę równoległego wykonywania i utrzymuje użytkownika w kontroli.

Każdy agent ma własny workspace i własne uprawnienia - to, do czego ma dostęp jeden agent nie przekłada się automatycznie na innych. Te przestrzenie robocze są zaprojektowane jako lekkie i bezpieczne, a zużycie pamięci i procesora skaluje się w zależności od aktywności.

Użytkownik zawsze ma kontrolę

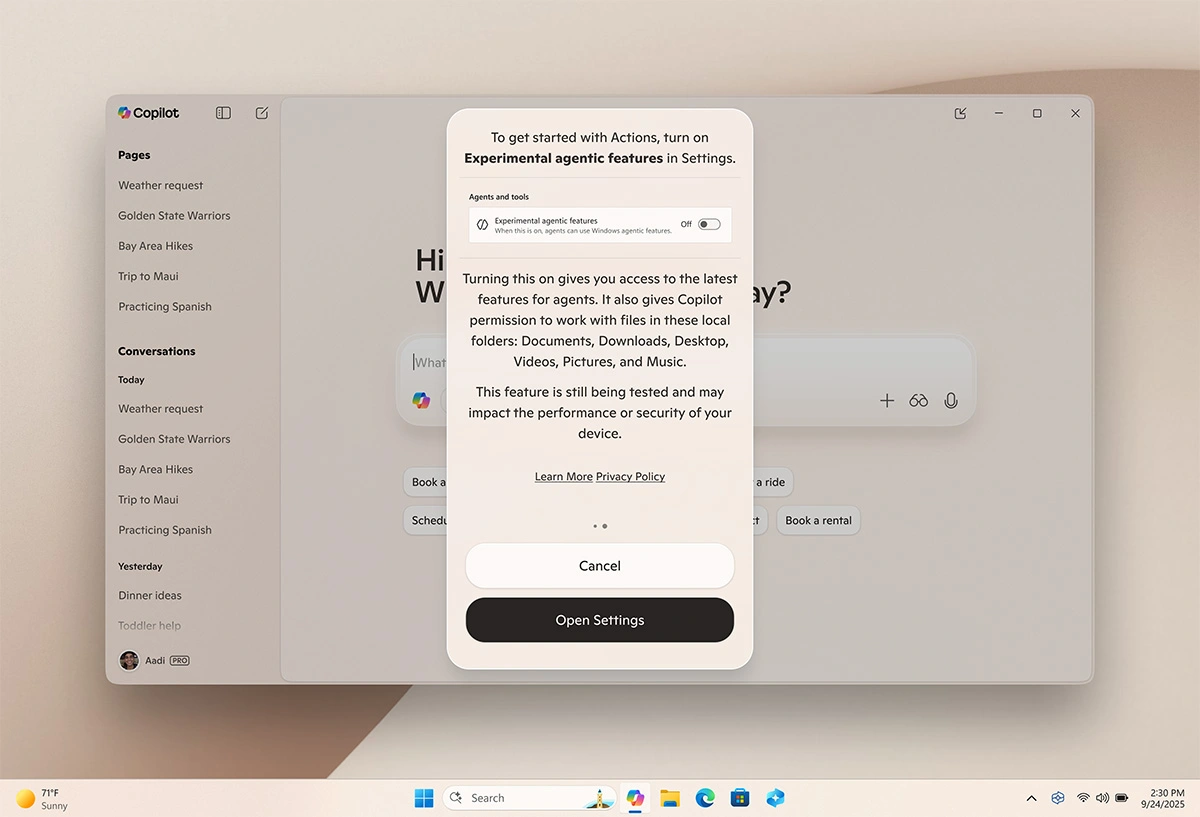

Microsoft postawił na transparentność. Copilot Actions jest domyślnie wyłączony i można go włączyć tylko poprzez przełącznik w ustawieniach Windows: Ustawienia > System > Składniki sztucznej inteligencji > Narzędzia agenta > Eksperymentalne funkcje agentów. To nie jest funkcja, która po cichu się pojawia - musisz świadomie ją aktywować.

Eksperymentalna wersja Copilot Actions w Windows 11 to dopiero początek. Microsoft wyraźnie zaznacza, że podczas testów będzie dodawać więcej mechanizmów kontroli bezpieczeństwa i prywatności, zanim funkcje te staną się powszechnie dostępne. W planach są również kolejne moduły, takie jak obsługa dla tożsamości Entra i MSA.

Czy Microsoft naprawdę czaruje? Może nie tyle ściemnia, co po prostu buduje solidne fundamenty bezpieczeństwa w czasach, gdy AI przestaje być dodatkiem, a staje się integralną częścią naszego codziennego życia. Czas pokaże, czy te zabezpieczenia okażą się wystarczające. Na razie jedno jest pewne - Microsoft traktuje temat na tyle poważnie, że nie zapomina o starej prawdzie: zaufanie w świecie technologii buduje się przez transparentność i danie użytkownikom rzeczywistej kontroli. Wygląda na to, że póki co te założenia są spełnione.