Poseł opozycji radośnie sieje fejki z AI. Jego rolka ma już 1,5 mln zasięgu

Deepfake w służbie polityki. Sztuczna inteligencja staje się narzędziem manipulacji, co właśnie odkrywają polscy politycy. Warto przypomnieć sobie potem przy urnie kto używa technologii, by okłamywać swoich wyborców.

Sztuczna inteligencja w ciągu ostatnich dwóch lat dokonała skoku, który jeszcze niedawno wydawał się nierealny. Modele generatywne potrafią dziś tworzyć wideo tak fotorealistyczne, że przeciętny odbiorca nie ma szans odróżnić ich od nagrań prawdziwych. I właśnie w takim momencie polska debata publiczna doczekała się przykładu, który pokazuje, jak łatwo ta technologia może stać się narzędziem manipulacji.

Na social mediach posła Prawa i Sprawiedliwości, Tomasza Zielińskiego, pojawił się film wygenerowany przez sztuczną inteligencję - przedstawiający parę mężczyzn rozmawiających o… psim przedszkolu. Materiał wyglądał jak zwykły, nieco banalny klip z życia codziennego. Problem w tym, że nie został oznaczony jako sztuczny. A jego publikacja została opatrzona pytaniem sugerującym związek między przedstawionym stylem życia a spadkiem dzietności w Polsce.

Koniecznie przeczytaj też:

Technologia wyprzedziła świadomość społeczną

Dzisiejsze generatory wideo - oparte na diffusion models i zaawansowanych sieciach neuronowych - potrafią tworzyć postaci o naturalnej mimice, realistycznym ruchu i perfekcyjnej synchronizacji audio. Jeszcze niedawno takie efekty wymagały zespołu grafików i miesięcy pracy. Teraz wystarczy opis tekstowy i kilka minut przetwarzania.

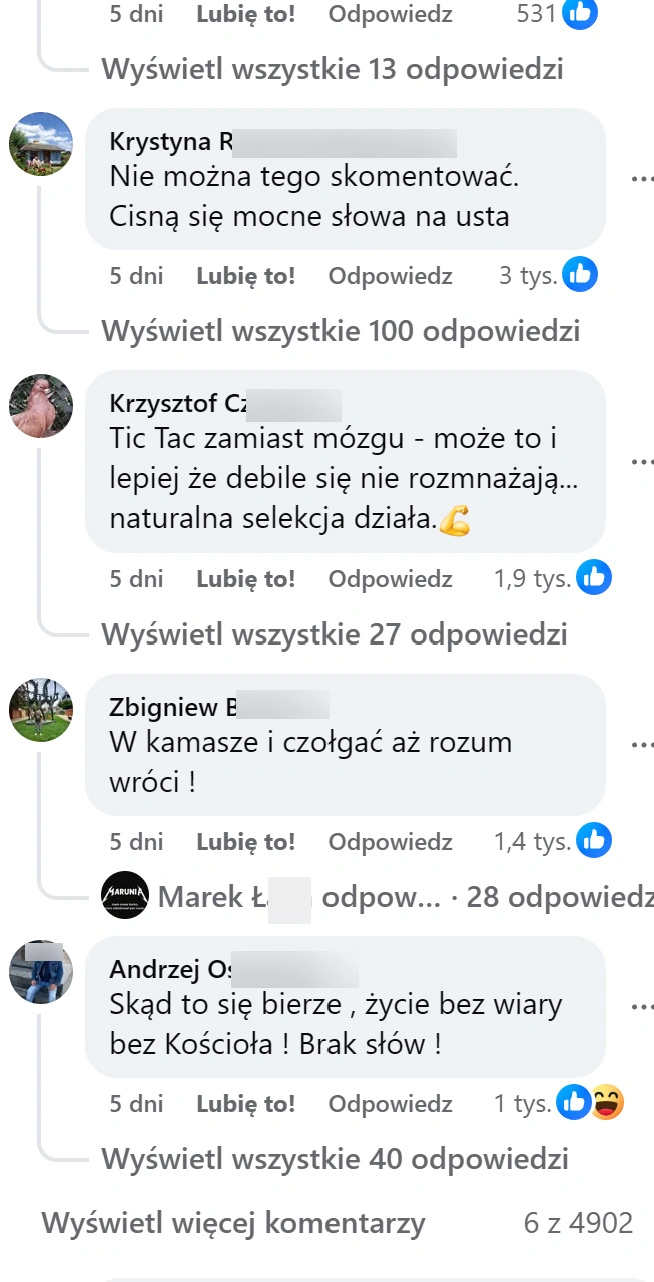

Wygenerowany materiał obejrzało ponad 1,5 mln osób, a pod postem pojawiło się blisko 6 tys. komentarzy. Zdecydowana większość odbiorców nie miała pojęcia, że ogląda deepfake. I trudno im się dziwić - film nie był oznaczony jako sztuczny, a jego forma nie sugerowała niczego podejrzanego.

To właśnie w tym tkwi największe zagrożenie: technologia stała się zbyt dobra, a świadomość społeczna - wciąż dramatycznie niska.

Manipulacja pod płaszczykiem troski o demografię

Pytanie dołączone do nagrania sugerowało, że prezentowany styl życia ma wpływ na spadek liczby urodzeń w Polsce. To klasyczny przykład narracji, która wykorzystuje emocje zamiast faktów.

Kryzys demograficzny ma przyczyny dobrze opisane w badaniach:

- wysokie koszty życia i wychowania dzieci,

- niepewność ekonomiczną,

- zmianę priorytetów życiowych,

- rosnący udział kobiet w szkolnictwie wyższym i na rynku pracy,

- brak stabilnej polityki mieszkaniowej.

Związek między tymi zjawiskami a obecnością par jednopłciowych w przestrzeni publicznej nie znajduje potwierdzenia w danych. Jednak deepfake - dzięki swojej sugestywności - może sprawić, że odbiorca zacznie łączyć fakty tam, gdzie ich nie ma. To właśnie dlatego generatywna AI w polityce jest tak niebezpieczna. Wystarczy, że podsuwa obrazy, które uruchamiają emocje.

Prawo nie nadąża. Polska i świat w obliczu nowych wyzwań

W Stanach Zjednoczonych zaczęły obowiązywać przepisy zakazujące tworzenia i rozpowszechniania erotycznych deepfake’ów bez zgody osób przedstawionych. To dopiero pierwszy krok, ale pokazuje kierunek.

W Polsce sytuacja jest bardziej skomplikowana.

Nie istnieje jeszcze kompleksowe prawo regulujące materiały generowane przez AI. Kodeks karny przewiduje odpowiedzialność za rozpowszechnianie fałszywych informacji, ale deepfake często nie jest fałszywą informacją w klasycznym sensie - to raczej manipulacja kontekstem, sugestia, gra skojarzeń.

Unia Europejska pracuje nad AI Act, który ma wprowadzić obowiązek oznaczania treści generowanych przez sztuczną inteligencję. Jednak zanim przepisy zostaną wdrożone miną lata. A technologia nie zamierza czekać.

Facebook deklaruje, że oznacza treści wygenerowane przez AI. W praktyce jednak egzekwowanie tych zasad bywa wybiórcze - szczególnie w przypadku kont publicznych i politycznych.

Sztuczna inteligencja nie jest wrogiem. Ale może stać się bronią

Najbardziej niepokojące w tej historii nie jest to, że ktoś stworzył deepfake.

Najbardziej niepokojące jest to, że zadziałał.

Badania nad propagandą są jednoznaczne: obrazy - zwłaszcza powtarzane - kształtują percepcję znacznie silniej niż argumenty. A teraz te obrazy można generować hurtowo, automatycznie, bez kosztów i bez kontroli. Sztuczna inteligencja stała się narzędziem walki o uwagę, emocje i narrację.

Technologia sama w sobie nie jest ani dobra, ani zła. Wszystko zależy od tego, kto ją wykorzystuje - i w jakim celu. Deepfake może być narzędziem sztuki, edukacji, rozrywki. Ale w rękach osób, które chcą manipulować opinią publiczną staje się bronią o sile rażenia, jakiej wcześniej nie mieliśmy.

A skoro ta broń jest już dostępna, musimy nauczyć się z nią żyć. I bronić się przed nią - zanim stanie się standardowym elementem politycznego arsenału.