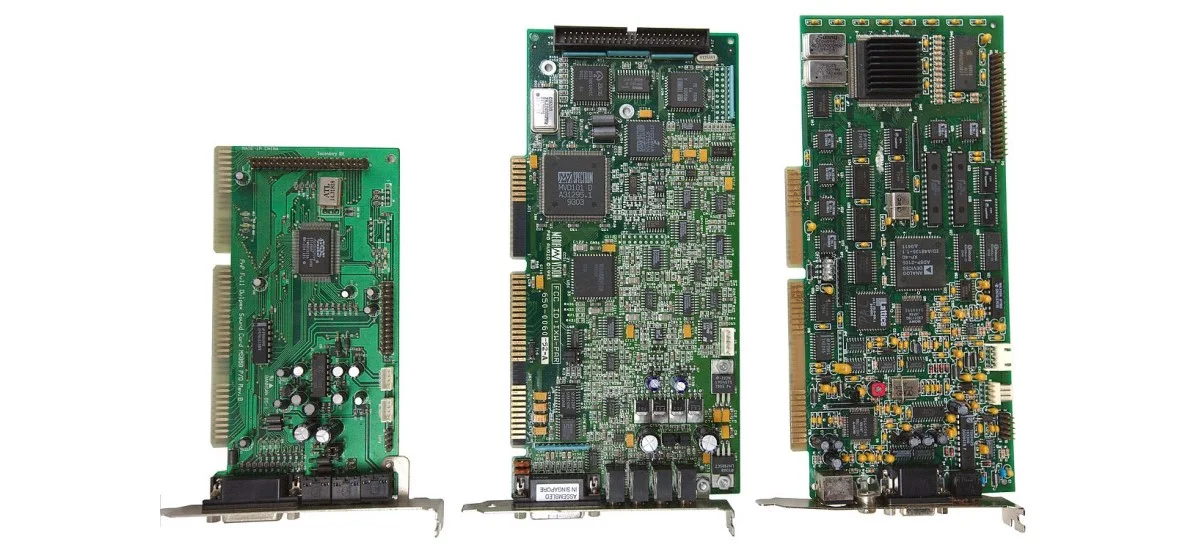

To były czasy. Kiedy bez dodatkowego osprzętu w komputerze nie mogliśmy słuchać muzyki

Odtwarzanie dźwięku w PC traktujemy dziś jako coś oczywistego. Tymczasem dopiero po dwóch latach mój pierwszy komputer potrafił do mnie przemówić. Na dodatek jego dźwiękowe możliwości były bardzo ograniczone.

Czy wiecie, co to jest karta dźwiękowa? Zapewne jeszcze ten sprzęt pamiętacie albo domyślacie się jego przeznaczenia po nazwie. Dziś karty dźwiękowe są wbudowane w płytę główną każdego komputera. Kiedyś bez takiej karty mogliśmy liczyć co najwyżej na nędzne popiskiwania wbudowanego w płytę główną głośniczka.

Swoją przygodę z dźwiękiem w komputerze zacząłem od karty Sound Galaxy Pro 16, która była klonem karty Sound Blaster Pro. Nowy komputer to karta Sound Blaster AWE64, którą z czasem wymieniłem na Sound Blaster X-Fi. A potem pojawił się Windows Vista, przez którego kupno drogiej karty przestało mieć sens. O co w tym wszystkim chodzi? Z nieukrywaną przyjemnością: już tłumaczę. Z zastrzeżeniem, że skupimy się wyłącznie na urządzeniach dla konsumentów. Rynek profesjonalnych urządzeń do odbioru i emisji dźwięku w PC to zupełnie osobna historia.

Musimy cofnąć się w czasie. Tak o trzy dekady. To właśnie wtedy świat PC uratowali… twórcy gier.

W 1988 r. ze świecą bowiem było szukać komputera w standardzie IBM PC, który potrafił wydawać z siebie jakieś inne dźwięki od prostego pikania. Fakt faktem z tak zwanego PC Speakera programistom udawało się wyciskać zaskakująco wyraźne – jak na możliwości tego pikacza – dźwięki, była to jednak sztuka dla sztuki. Twoja pralka zapewne oferuje większe możliwości w swoim systemie audio niż to, co oferowały ówczesne pecety.

Również w tym roku podczas targów CES spotkali się szefowie największych wówczas producentów gier wideo. Zgodnie doszli do wniosku, że komputery IBM PC najzwyczajniej w świecie nie mogą być określane jako urządzenia multimedialne. Zdecydowano się więc wymusić popularyzację kart dźwiękowych i na bezpośrednią współpracę z ich producentami. Przystawki do przetwarzania dźwięku na IBM PC miały przestać być drogim rozszerzeniem dla fachowców. 18 z 25 największych producentów gier zobowiązało się do pomocy.

Najbardziej skory do współpracy okazał się AdLib.

Producent rozwiązania AdLib Personal Music System również widział potencjał w sprzedawaniu tańszych urządzeń dźwiękowych dla mas. Mierzył się jednak z odwrotnym problemem: jak sprzedać kartę dźwiękową, której żadna powszechna gra czy aplikacja nie obsługuje? Sojusz twórców gier był dla niego doskonałym rozwiązaniem tego problemu.

W tym momencie warto zwrócić uwagę na możliwości pierwszych kart dźwiękowych. Dziś co bardziej wrażliwi akustycznie co najwyżej mogą zwracać uwagę na jakość złącz dźwiękowych czy konwertera DAC. I tak wszystko liczy CPU. 30 lat temu generowaniem dźwięku musiała zajmować się karta dźwiękowa.

Konsumenckie karty AdLib bazowały na układzie Yamaha YM3812 (OPL2). Mogły przetwarzać maksymalnie 9 dźwięków mono dowolnie programowalnych. Twórcy gier skupili się więc na optymalizowaniu swoich produkcji właśnie pod AdLiba. Wydawać by się mogło, że firma trafiła na żyłę złota. Szybko jednak pojawiła się konkurencja. Od firmy, która zdecydowała się zrobić wszystko, by odwrócić uwagę od oferty AdLiba. Wyszło jej to aż za dobrze: Creative Labs nie tylko osiągnął sukces, ale wręcz praktycznie do samego końca utrzymywał dominującą, bliską monopolistycznej pozycję.

Creative Sound Blaster, czyli dźwiękowy standard na PC.

Pierwszą kontrpropozycją do kart AdLiba był Music System. Wykorzystywał układ Philips SAA1099 i oferował równoczesne przetwarzanie 12 dźwięków. Co ważne, obsługiwał też dźwięk stereo. Na papierze prezentowało się to doskonale, jednak szybko poznano się na pewnej niedoskonałości Music System. Oferowana precyzja w obróbce fal dźwiękowych była zastraszająco niska, a Music System brzmiał jakby do komputera podłączono 12 grających równocześnie PC Spekerów. AdLib górą? Niestety, niezupełnie.

Creative wykonał dwa nieco wątpliwe etycznie, ale doskonałe ruchy. Po pierwsze, nawiązał współpracę z firmą Microsoft, dzięki czemu wszystkie jego przyszłe układy dźwiękowe posiadały natywną obsługę w MS-DOS i Windows. A także sklonował układ dźwiękowy AdLiba, dorzucając od siebie wiele dodatków: dedykowany koprocesor Intela do digitalizowanych próbek dźwiękowych, wbudowany w kartę game port do podłączania joysticka oraz interfejs do zewnętrznych instrumentów MIDI. Kupowanie kart AdLiba sprzedawanych w podobnych cenach przestało mieć sens.

Jakość przestała mieć znaczenie. Istniał tylko Sound Blaster i jego klony.

AdLib i Creative nie byli jedynymi pretendentami do dominacji na rynku kart dźwiękowych. Do zawodów o serca użytkowników i twórców gier przystąpili poważnie Disney, Covox, Roland i Gravis. Ich karty dźwiękowe oferowały zazwyczaj jeszcze więcej od kart Sound Blaster. W szczególności wyróżniały się tak istotną wówczas syntezą dźwięków MIDI. Dlaczego istotną?

W czasach, gdy multimedialne gry mieściły się w kilku megabajtach, rejestrowanie do nich w pełni zdigitalizowanej muzyki nie było możliwe. Prawdopodobnie większość waszych plików MP3 jest większych od całej gry z tamtych czasów. Dlatego też do muzyki często stosowano format MIDI. W dużym uproszczeniu można go przyrównać do zapisu nutowego: zamiast całego dźwięku gra (lub aplikacja) zapewniała karcie dźwiękowej informacje o melodii i rodzaju instrumentu. Jego brzmienie syntetyzowała już sama karta.

Karty Gravisa i Rolanda oferowały wspomnianą syntezę instrumentów na nieporównywalnie wyższym poziomie niż karty firmy Creative. Ale to Sound Blaster był standardem w systemach operacyjnych Microsoftu. Gry były tworzone prawie wyłącznie na DOS-a i później Windowsa. Niektórzy twórcy gier starali się wykorzystywać dodatkowe możliwości pozostałych kart, w większości przypadków ich producenci byli jednak ignorowani. A co za tym idzie, zmuszani do tworzenia specjalnych trybów zgodności z Sound Blasterem. Co często – z uwagi na różnice w sprzęcie – działało dość kiepsko.

Na rynku nic jednak nie trwa wiecznie. Creative Labs zbagatelizowało rynek laptopów. A potem zostało dobite przez swojego największego sojusznika.

Krzywdzącym byłaby opinia, jakoby Creative Labs się nie rozwijał. Mimo pozycji bliskiej rynkowemu monopolowi rozwijał możliwości swoich urządzeń. W kartach z linii AWE w końcu dodano syntezę dźwięków MIDI na wysokim poziomie. Creative współpracował też bezpośrednio z twórcami gier, eksperymentując nawet z takimi pomysłami, jak akceleracja przeliczeń związanych z przeliczaniem położenia dźwięku w wirtualnej przestrzeni. Zwiększano systematycznie częstotliwość próbkowania i liczbę obsługiwanych symultanicznie dźwięków i kanałów.

Creative słusznie skupił się na graczach, to jednak uśpiło jego czujność. Przenośne walizki przeliczeniowe dla biznesmenów – potocznie nazywane notebookami czy laptopami – stawały się coraz mniejsze, coraz bardziej poręczne, a ich ceny coraz przystępniejsze. Zdecydowanie (jeszcze) nie nadawały się do poważnego grania, jednak coraz częściej trafiały pod strzechy Zwykłych Użytkowników. Były to też urządzenia, w których nie było miejsca na układy Creative’a. I to dosłownie.

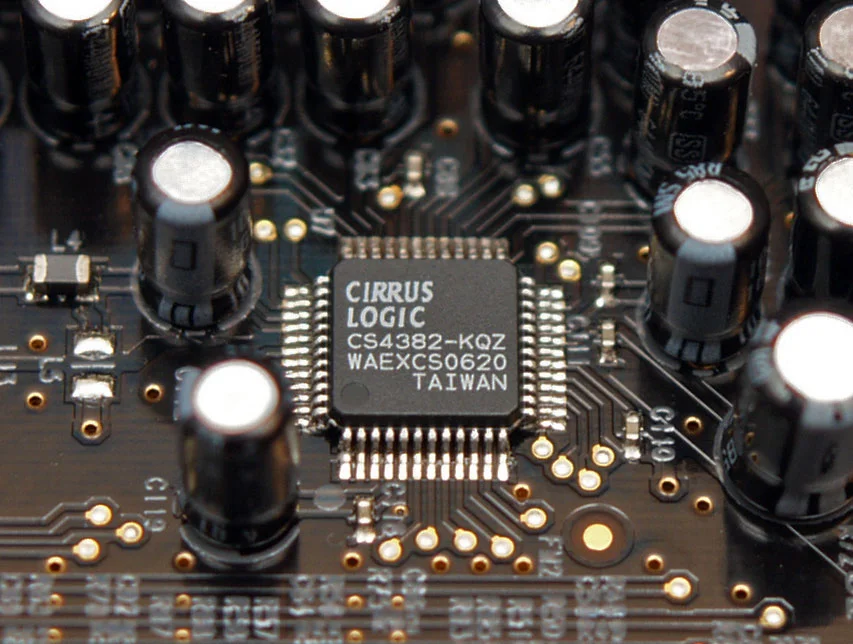

Z myślą o nich powstał nowy standard, wspierany przez Intela. Nazywał się on AC’97 i nie miał nic wspólnego z tym od lat stosowanym przez Sound Blastera. Ów kodek nie wymagał stosowania skomplikowanych i kosztownych procesorów dźwiękowych. To ostatnie zachęciło również producentów płyt głównych do stacjonarnych komputerów. Okazało się, że IBM PC może bez żadnych rozszerzeń, prosto z pudełka emitować dźwięk wysokiej jakości – o częstotliwości próbkowania 48 kHz przy 20-bitowej rozdzielczości, wielokanałowo.

Z całą pewnością kodek AC’97 nie mógł równać się z kartami Audigy czy X-Fi. Te jednak zamordował największy sojusznik Creative’a.

Intel wykorzystał swoje ogromne wpływy wśród producentów płyt głównych i notebooków, czego efektem była obecność AC’97 (lub jego następcy, Intel HD Audio) w każdym urządzeniu tego typu. Creative znalazł się w bardzo niekomfortowej sytuacji. Nagle się okazało, że nie produkuje już sprzętu, którego zakup jest w zasadzie oczywisty. Oferowało urządzenia dla entuzjastów.

Firma oczywiście próbowała to wykorzystać. Sam kupiłem kartę X-Fi właśnie dla lepszego brzmienia dźwięku przestrzennego w grach, mimo iż na płycie głównej mojego komputera był zintegrowany moduł dźwiękowy firmy Realtek, zgodny z AC’97. A potem pojawił się system Windows Vista, kładący kres wojnie standardów. Ku zgrozie i przerażeniu Creative’a.

Windows Vista ucywilizował sposób, w jaki komputery PC przetwarzają dźwięk.

Dokonał tego za sprawą całkowicie przepisanego na nowo stosu do obsługi audio. Karty dźwiękowe nie mogły już korzystać z wykorzystujących warstwę abstrakcji sterowników, co pozwalało im na ogromną swobodę w tym, jak dźwięk jest przetwarzany przez komputer. Musiały być zgodne z zaprezentowanym w Viście modelem Universal Audio Architecure (UAA). Co to wszystko znaczy?

UAA nie tylko narzuciła swój sztywny zestaw API, ale też celem zwiększenia stabilności Windows zmniejszyła jego uprawnienia do trybu użytkownika (user mode). W praktyce oznaczało to, że każda zgodna z Vistą karta dźwiękowa oferowała wszystkie skomplikowane przeliczenia związane z dźwiękiem – bo rolę tę przejął procesor główny komputera. Oznaczało to również, że jakiekolwiek alternatywne pomysły na przetwarzanie dźwięku przestały być obsługiwane.

Dzięki temu programowanie dźwięku w grach i aplikacjach stało się dużo łatwiejsze. Dzięki temu również nie trzeba było już instalować ręcznie żadnych sterowników do urządzeń dźwiękowych dowolnego rodzaju – nie tylko kart dźwiękowych. To również oznaczało, że koślawo napisany sterownik do karty dźwiękowej nie będzie już w stanie zawiesić systemu. I wreszcie oznaczało, że wszystkie mechanizmy upiększające dźwięk od Creative’a przestały działać. A raczej: zamiast przez procesory kart Audigy czy X-Fi, musiały być liczone przez niedostosowany do tego CPU, co znacząco wpłynęło na wydajność. Problemy były na tyle duże, że zdecydowałem się po prostu wyjąć swoje X-Fi z komputera – zgodna w pełni z Vistą zintegrowana karta dźwiękowa zaczęła oferować lepsze rezultaty niż karta Creative’a.

Karty dźwiękowe nie umarły. Zniknęły tylko z rynku konsumenckiego.

Nadal są wykorzystywane przez hobbystów i zawodowców, dla których możliwości oferowane przez wbudowane w nowoczesne komputery moduły dźwiękowe są niewystarczające. Dla większości z nas są jednak więcej niż satysfakcjonujące. I już na tyle tanie, że w swoim desktopie masz prawdopodobnie dwie karty dźwiękowe: jedną na płycie głównej i jedną w karcie graficznej, używaną gdy podłączasz telewizor lub monitor z głośnikami przez złącze HDMI. W zasadzie to nawet niektóre przejściówki w USB-C na audio-jack czy słuchawki mają swoje własne wbudowane karty dźwiękowe o możliwościach znacznie wykraczających poza specyfikację CD Audio.

Po raz kolejny postęp i wygoda wygrywają z sentymentem. To dobrze, że już nie musimy się przejmować czymś tak oczywistym, jak dźwięk z komputera. On po prostu jest. Każda gra i każda aplikacja będzie w stanie odtworzyć na PC wszystkie sample czy ścieżki muzyczne w takim brzmieniu, w jakim zostały nagrane. Bez sztuczek, bez syntezy MIDI, bez własnościowych algorytmów przetwarzania fal dźwiękowych.

Choć jakoś nadal nie mogę się zebrać w sobie i wyrzucić na śmietnik leżącej gdzieś w szafie karty X-Fi. Było coś irracjonalnie fajnego w tym dynamicznym rozwoju cyfrowej technologii audio i w wydawaniu pieniędzy na coraz to bardziej wypasione sprzęty. Cytując klasyka: kiedyś to były czasy, dziś już nie ma czasów…