Mozilla uderza w big techy. Ruch, który może zaboleć największych graczy

Mozilla ma nowego "Thundera" w rodzinie. Nie, nie przeglądarkę z agentem AI - tylko coś znacznie bardziej przyziemnego, a jednocześnie ambitnego. Zwłaszcza dla przedsiębiorstw, które nie chcą być zakładnikami Big Techu.

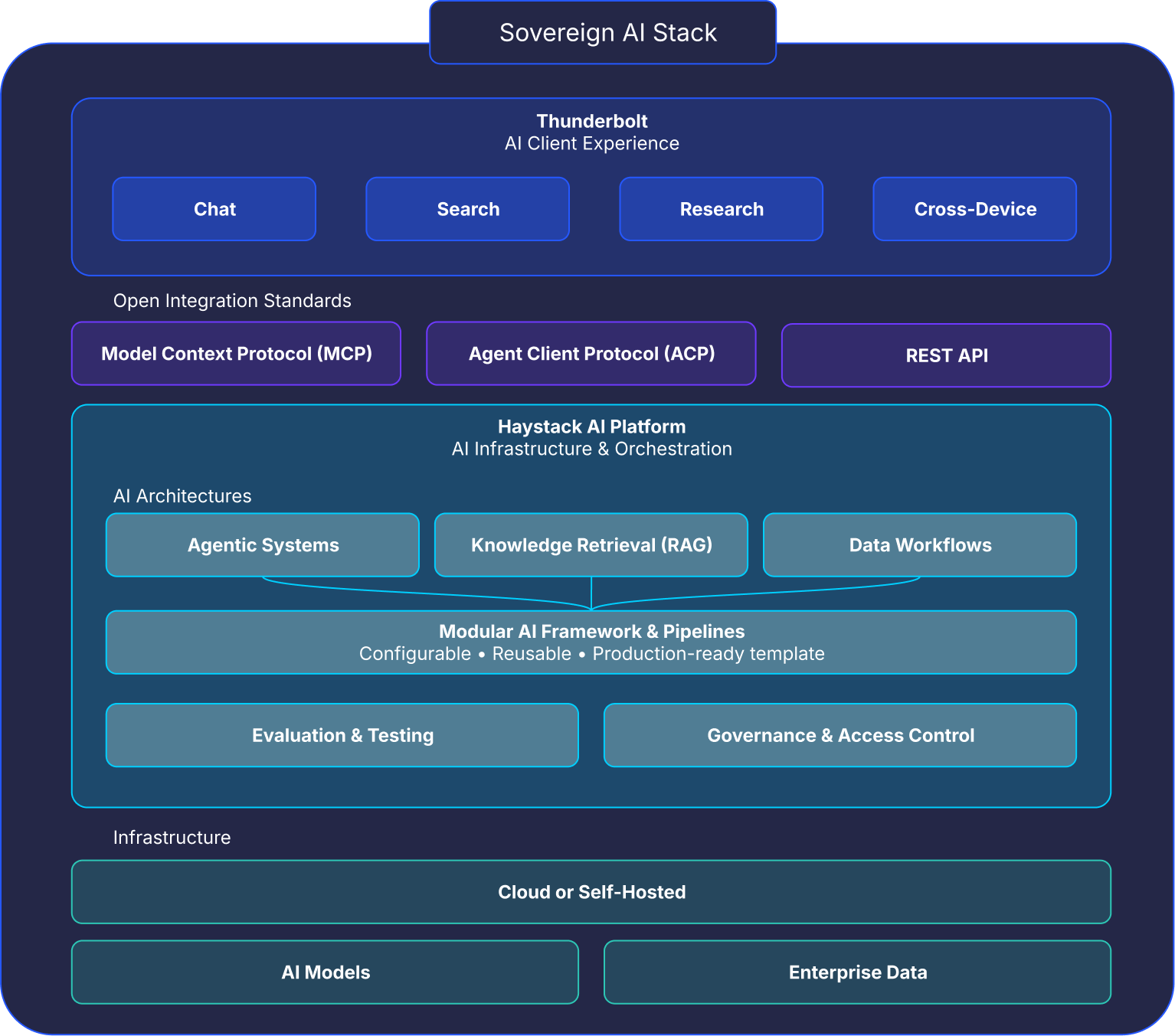

Thunderbolt to otwartoźródłowy klient AI, który ma działać jako uniwersalny front-end do samodzielnie hostowanej infrastruktury sztucznej inteligencji. W skrócie: dostajemy aplikację, która ma pozwolić firmom (i bardziej zaawansowanym użytkownikom) ogarnąć własny stos AI, na własnych serwerach, z własnymi danymi i własnymi zasadami.

To jest ruch bardzo w stylu Mozilli: zamiast ścigać się z Big Techami na wielkie modele próbuje zbudować narzędzie, które ma dać użytkownikom kontrolę. I przy okazji - trochę namieszać w rodzącym się rynku „enterprise AI”.

Czytaj też:

Co to właściwie jest Thunderbolt?

Thunderbolt to - jak Mozilla lubi to nazywać - „sovereign AI client”, czyli suwerenny klient AI. W praktyce jest to rozbudowany, wieloplatformowy interfejs do różnych modeli i agentów, który można podpiąć pod własną infrastrukturę AI, zamiast wysyłać wszystko do chmury jakiegoś dostawcy.

Od strony technicznej Thunderbolt jest zbudowany na Haystacku - otwartoźródłowym frameworku od deepset, który pozwala składać własne, modułowe „pipeline’y” AI z wybranych komponentów: modeli, narzędzi, źródeł danych. Thunderbolt to de facto warstwa kliencka: daje UI, integracje, przepływy pracy i obsługę różnych protokołów, ale nie próbuje być wszystkim naraz. Zamiast jednego modelu Mozilli mamy więc klienta, który potrafi gadać z:

- agentami zgodnymi z Agent Client Protocol (ACP),

- modelami wystawionymi przez API kompatybilne z OpenAI (czyli nie tylko OpenAI, ale też m.in. Claude, DeepSeek, Mistral, Gemini, modele Meta i inne),

- serwerami MCP (Model Context Protocol), które integrują się z systemami i danymi firmy.

Z punktu widzenia użytkownika końcowego Thunderbolt wygląda jak taki kombajn do AI: chat, wyszukiwarka, narzędzie do researchu, automatyzacji i pracy między urządzeniami. Z punktu widzenia administratora - to klient, który można postawić na własnej infrastrukturze, podpiąć do własnych modeli i własnych danych, a potem dać pracownikom jako „jedno okno” do całego firmowego AI.

AI, ale u siebie: dane, suwerenność i SQLite jako źródło prawdy

Najważniejszy punkt programu: Thunderbolt jest projektowany przede wszystkim pod scenariusze self‑hosted. Mozilla bardzo wyraźnie gra kartą „AI you control” - AI, nad którym masz kontrolę. Co to oznacza w praktyce?

- możliwość uruchomienia całego stosu na własnej infrastrukturze (on‑prem, suwerenne chmury, a nawet środowiska odcięte od Internetu),

- integracja z lokalnymi danymi firmy przez otwarte protokoły,

- lokalna baza SQLite jako „source of truth” - miejsce, z którego model może czerpać wiedzę o tym, co jest „prawdziwe” w kontekście organizacji.

Do tego dochodzą opcjonalne szyfrowanie end‑to‑end i kontrola dostępu na poziomie urządzenia. Dla firm, które naprawdę boją się wycieku danych - banków, instytucji publicznych, medycznych, kancelarii - to jest bardzo konkretna propozycja. Zamiast kombinować jak ograniczyć ChatGPT w firmie można zbudować własnego „GPT‑a”, ale z interfejsem, który nie wygląda jak projekt z GitHuba z trzema gwiazdkami.

To nie kolejny „supermodel”, a klient do wszystkiego

Warto podkreślić: Mozilla nie próbuje tu konkurować z OpenAI, Anthropic czy Google na poziomie samych modeli. Thunderbolt nie jest „modelem Mozilli”, tylko klientem, który ma działać z dowolnym modelem, byle dało się z nim gadać przez kompatybilne API. To podejście ma kilka ciekawych konsekwencji.

- Firma może mieszać modele: jeden do kodu, inny do dokumentów prawnych, jeszcze inny do generowania streszczeń. Thunderbolt ma być tym miejscem, gdzie użytkownik nawet nie musi wiedzieć, który model jest pod spodem - po prostu dostaje narzędzie do pracy.

- Łatwiej jest zmienić dostawcę. Jeśli jutro pojawi się nowy, tańszy albo lepszy model z API kompatybilnym z OpenAI to w teorii wystarczy przełączyć endpointy po stronie infrastruktury, a klient pozostaje ten sam.

- To dobrze gra z otwartymi modelami i lokalnymi LLM‑ami. Nic nie stoi na przeszkodzie, żeby w Thunderbolcie podpiąć np. lokalnie hostowanego LLaMA‑pochodnego potwora, który mieli dokumenty na serwerze w piwnicy, bez wypuszczania tych danych na zewnątrz.

Mozilla i MZLA (spółka‑córka odpowiedzialna m.in. za Thunderbirda, teraz także za Thunderbolt) celują przede wszystkim w rynek enterprise. To widać po języku: „Forward‑Deployed Engineering”, „sovereign deployments”, „European delivery”, „trusted partners”.

Kod Thunderbolta jest dostępny na GitHubie, na licencji MPL 2.0 - tej samej, którą Mozilla stosuje od lat przy Firefoksie. Projekt można forknąć, audytować, modyfikować i dostosowywać do własnych potrzeb.

Thunderbolt ma być dostępny praktycznie wszędzie

Jako aplikacja webowa, natywne aplikacje na Windows, macOS, Linuksa, a także na iOS i Androida. Dla firm, które nie chcą żeby pracownicy logowali się do pięciu różnych paneli AI to może być argument: jeden klient, wiele modeli, wiele źródeł danych.

Interfejs można też zbudować z kodu źródłowego w React - to otwiera drogę do własnych modyfikacji UI, brandingu czy integracji z istniejącymi narzędziami firmowymi. Dla działów IT, które lubią mieć wszystko po swojemu to może być całkiem istotne.

Czy to jest „Firefox dla AI”? Jeszcze nie, ale…

Na razie to zdecydowanie za duże porównanie. Firefox był produktem masowym, skierowanym do każdego użytkownika Internetu. Thunderbolt jest dziś narzędziem celującym w firmy, z komunikacją mocno „enterprise’ową” i naciskiem na wdrożenia, audyty, suwerenność danych.

Tyle że jeśli plan Mozilli się powiedzie to Thunderbolt może stać się czymś w rodzaju „standardowego klienta” dla otwartego, zdecentralizowanego ekosystemu AI: miejscem, w którym spotykają się różne modele, agenci, protokoły i dane. A to już byłaby rola porównywalna z tym, co kiedyś robiły przeglądarki dla sieci.

Czy Thunderbolt się przyjmie? To już zależy od tego, czy Mozilla i MZLA dowiozą stabilność, bezpieczeństwo i sensowny ekosystem integracji. Kod jest, licencja jest, klient na wszystkie platformy jest. Teraz czas na to, co najtrudniejsze: realne wdrożenia i użytkowników, którzy powiedzą „tak, to jest AI, nad którym faktycznie mamy kontrolę”.