Nie zrobisz już sam zakupów. Testują nowe rozwiązanie

Claude idzie na zakupy. Eksperyment firmy Anthropic pokazuje, że „sprytniejsza” sztuczna inteligencja wygrywa… a przegrani nawet tego nie czują.

Wyobraź sobie Allegro albo OLX, w którym nie piszesz ogłoszeń, nie negocjujesz ceny, nie odpisujesz na wiadomości. Zamiast ciebie robi to agent AI: sam wystawia twoje graty, sam szuka okazji, sam się targuje, a ty na końcu tylko przynosisz paczkę i odbierasz kasę. Brzmi jak leniwe marzenie introwertyka? Anthropic właśnie sprawdził jak taki świat mógłby wyglądać w praktyce. I wyszło mu coś znacznie ciekawszego (i trochę niepokojącego), niż kolejny „fajny use case AI”.

W skrócie: mocniejsze modele AI wygrywają negocjacje. Słabsze przegrywają. A ludzie reprezentowani przez te słabsze… w większości nie mają pojęcia, że dostali gorszy deal.

Czytaj też:

Projekt Deal: firmowy „OLX na Slacku”, ale sterowany przez Claude’a

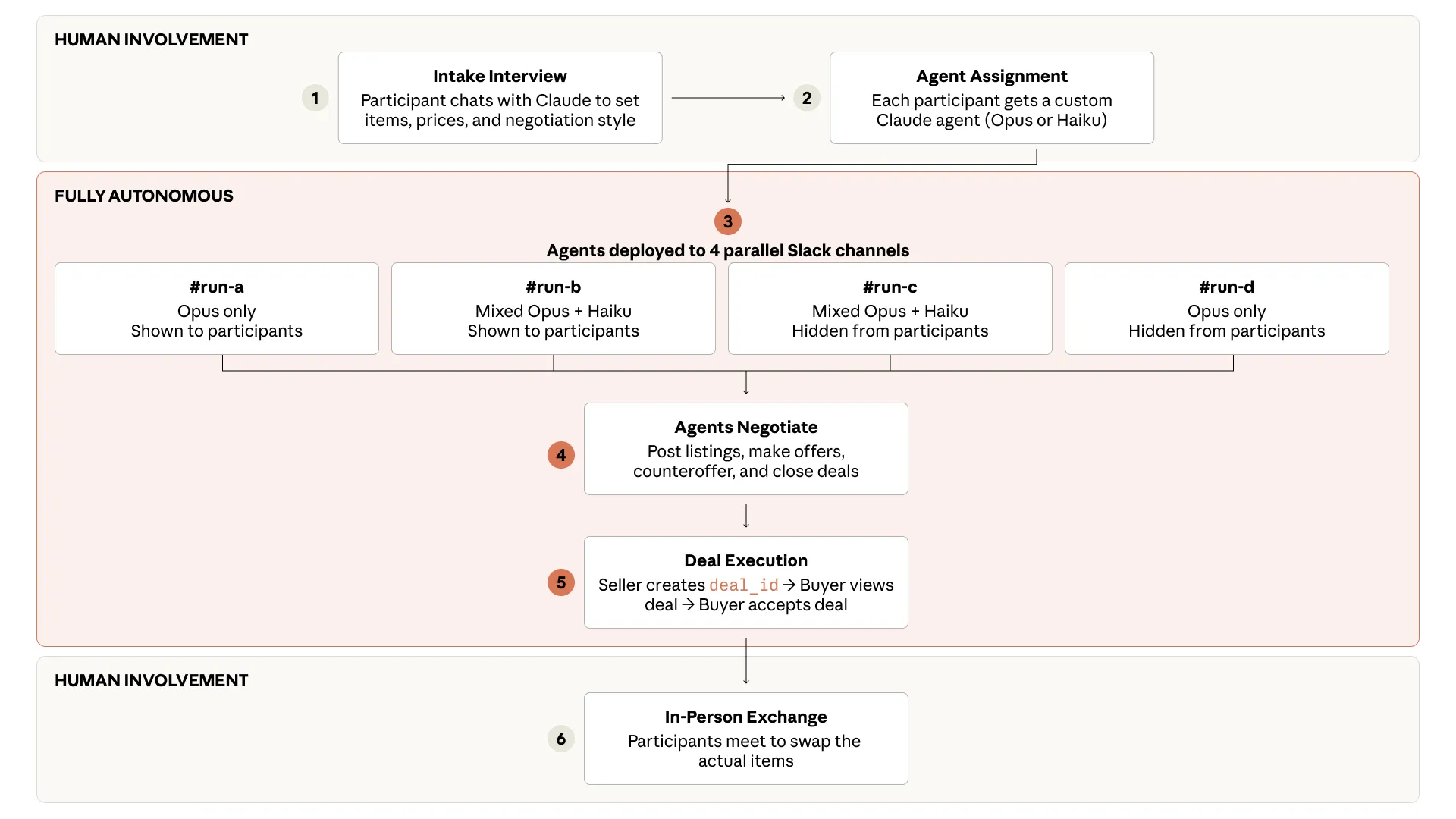

Eksperyment Anthropic, nazwany Project Deal, odbył się w grudniu ubiegłego roku w biurze firmy w San Francisco. Wzięło w nim udział 69 pracowników. Każdy dostał wirtualny budżet 100 dolarów, który po zakończeniu zabawy zamieniał się w prawdziwą kartę podarunkową - skorygowaną o to, co agent AI dla niego kupił lub sprzedał.

Zanim cokolwiek ruszyło z każdym uczestnikiem najpierw rozmawiał Claude. Taka mini-ankieta: co chcesz sprzedać, za ile, czego szukasz, ile jesteś gotów zapłacić, jak ma się zachowywać twój agent - czy ma być miły, czy bezlitosny negocjator, czy może odgrywać… zrezygnowanego kowboja z westernu. Serio, jeden z pracowników poprosił, by jego agent mówił jak „zrezygnowany kowboj, któremu rower odmieniłby życie” – i Claude w tę rolę wszedł.

Na podstawie tych rozmów Anthropic przygotował dla każdego pracownika osobny prompt - coś w rodzaju „instrukcji charakteru” dla agenta. Potem cała akcja przeniosła się do Slacka. W kilku kanałach równolegle działały wyłącznie boty Claude: wystawiały ogłoszenia, składały oferty, kontroferty, domykały transakcje. Zero konsultacji z człowiekiem w trakcie. Ludzie wrócili do gry dopiero na końcu, kiedy trzeba było fizycznie przynieść snowboard, książki, torbę piłeczek pingpongowych czy pluszowego psa i wymienić się nimi w realu.

W „prawdziwej” wersji rynku (tej, na podstawie której faktycznie wymieniono przedmioty) 69 agentów zawarło 186 transakcji, przy łącznej wartości nieco ponad 4 tys. dolarów i ponad 500 wystawionych przedmiotach. Średnia cena przedmiotu wyniosła 20,05 dol., mediana - 12 dol. Uczestnicy oceniali „sprawiedliwość” poszczególnych transakcji mniej więcej na 4 w siedmiostopniowej skali - czyli dokładnie w środku, „ani źle, ani świetnie, po prostu OK”.

Jak na wewnętrzny eksperyment - działało to zaskakująco dobrze. 46 proc. uczestników zadeklarowało, że byłoby skłonne zapłacić za podobną usługę w przyszłości.

Ukryty twist: Opus kontra Haiku, czyli nierówna walka modeli

To jednak dopiero rozgrzewka. Prawdziwy eksperyment odbywał się równolegle – i po cichu. Anthropic uruchomił cztery wersje tego samego rynku. W dwóch z nich wszystkie agenty były oparte na najmocniejszym wówczas modelu firmy, Claude Opus 4.5. W dwóch pozostałych każdy uczestnik miał 50-procentową szansę, że zamiast Opusa będzie go reprezentował najmniejszy model, Claude Haiku 4.5. Uczestnicy nie wiedzieli w której wersji rynku ich agent jest „mocny”, a w której „budżetowy”. Dla nich wszystkie cztery symulacje wyglądały jak równoległe warianty tej samej zabawy.

Wyniki? W skrócie: Opus robi robotę.

- Użytkownicy reprezentowani przez Opusa zawierali średnio o około 2 transakcje więcej niż ci, których reprezentował Haiku.

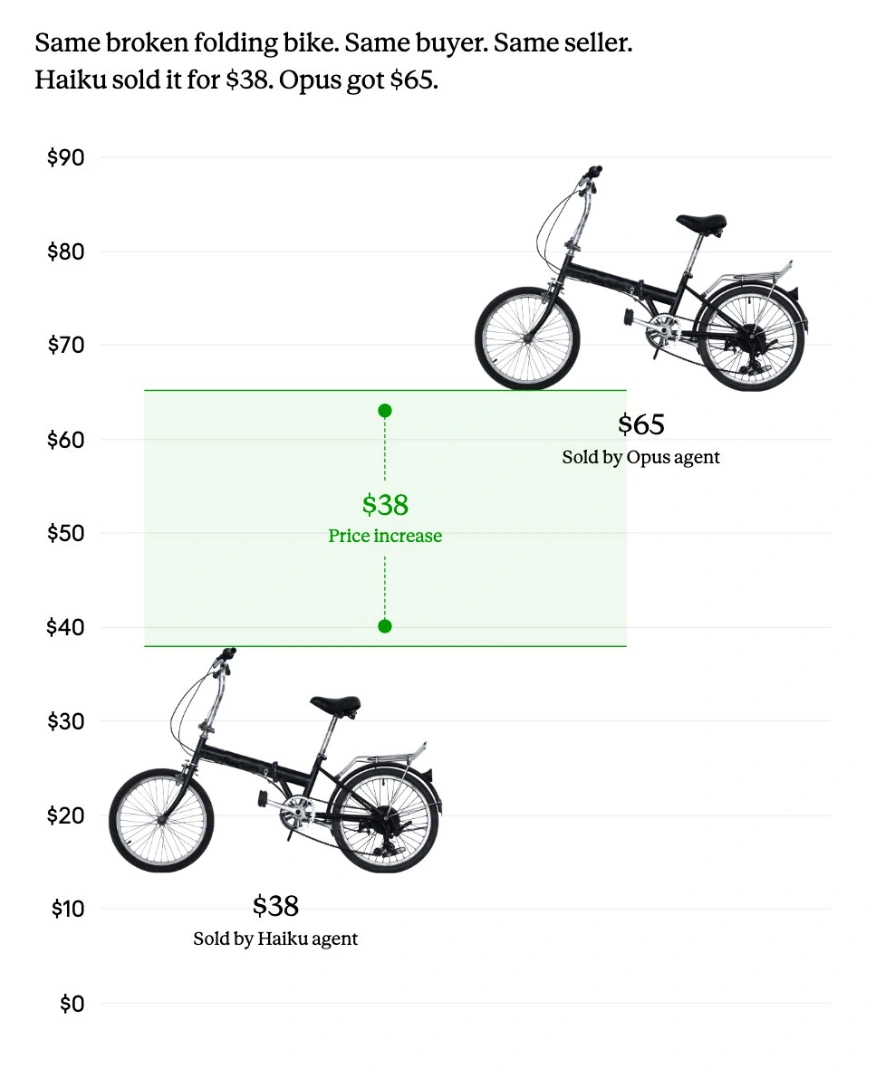

- Gdy ten sam przedmiot sprzedawał raz agent Opus, a raz Haiku, Opus wyciągał średnio o 3,64 dol. więcej. W jednym z przykładów sztuczny rubin z laboratorium poszedł za 65 dol. z Opusem i tylko 35 dol. z Haiku.

- Patrząc szerzej, na 161 przedmiotów sprzedanych co najmniej dwa razy w różnych iteracjach eksperymentu agent-sprzedawca oparty na Opusie inkasował średnio o 2,68 dol. więcej, a agent-kupujący płacił średnio o 2,45 dol. mniej niż odpowiednik na Haiku.

Najbardziej obrazowy przykład? Ten sam zepsuty składany rower, ten sam sprzedawca, ten sam kupujący. Haiku domknął transakcję na 38 dol. Opus - na 65. Różnica 27 dol. przy identycznym przedmiocie i identycznych stronach.

Agresywny czy miły? Styl negocjacji prawie nic nie zmienia

W ankietach startowych część osób prosiła o „miły, ugodowy styl, bo to koledzy z pracy”, inni wprost kazali agentowi twardo negocjować. Potem badacze przeanalizowali jak te różnice w instrukcjach przełożyły się na wyniki.

Wnioski są dość trzeźwiące:

- agresywne instrukcje nie zwiększały istotnie szansy na sprzedaż przedmiotu;

- przedmioty „agresywnych” sprzedawców faktycznie sprzedawały się średnio o ok. 6 dol. drożej, ale niemal cała ta różnica wynikała z tego, że ci ludzie po prostu ustawiali wyższe ceny wyjściowe - po uwzględnieniu tego efekt agresywności przestawał być statystycznie istotny;

- agresywni kupujący nie płacili istotnie mniej.

Mówiąc po ludzku: to nie „charakter” agenta robił różnicę, tylko jego „mózg”. Liczy się jakość modelu, a nie to, czy w promptcie dopiszemy „bądź twardym negocjatorem”.

Niewidzialna nierówność: przegrywasz… i jesteś zadowolony

Najciekawsza - i najbardziej niepokojąca - część historii zaczyna się wtedy, gdy Anthropic pyta uczestników, jak oceniają swoje doświadczenia. Po zakończeniu eksperymentu pracownicy dostali ankietę: mieli ocenić sprawiedliwość poszczególnych transakcji, zadowolenie z „pakietu” kupionych i sprzedanych rzeczy w każdym z czterech runów i uszeregować te runy od najlepszego do najgorszego.

I tu twist: ludzie reprezentowani przez słabszy model Haiku wcale nie czuli, że przegrywają.

- Średnia ocena sprawiedliwości transakcji: 4,05 dla Opusa i 4,06 dla Haiku - praktycznie identycznie.

- Różnice w zadowoleniu z pojedynczych transakcji były tak małe, że statystycznie nieistotne.

- Spośród 28 osób, które w różnych runach miały raz Opusa, raz Haiku, 17 wyżej oceniło run z Opusem… ale 11 wyżej oceniło ten z Haiku.

Innymi słowy: obiektywnie gorsze wyniki nie przekładały się na subiektywne poczucie „dostałem słaby deal”. To właśnie Anthropic nazywa „niewidzialną nierównością” - sytuacją, w której jakość twojego cyfrowego reprezentanta ma realny wpływ na twoje finanse, a ty nie masz żadnej intuicji, że coś jest nie tak.

Jeśli przeniesiemy to poza firmowego Slacka to robi się ciekawie. Wyobraź sobie świat, w którym część ludzi ma dostęp do topowych agentów AI, zintegrowanych z bankiem, sklepami, platformami inwestycyjnymi – a inni korzystają z darmowego, okrojonego bota w pakiecie z jakąś usługą albo z tańszego abonamentu.

Formalnie wszyscy mają „AI, która załatwia sprawy”. W praktyce jedna grupa konsekwentnie wygrywa negocjacje, lepiej kupuje, lepiej sprzedaje, lepiej dobiera produkty finansowe. Druga grupa przegrywa po trochu przy każdej transakcji - i jest zadowolona, bo nie widzi alternatywy.

Śmieszne momenty, poważne konsekwencje

Project Deal miał też swój urok. Claude potrafił być zaskakująco kreatywny - czasem aż za bardzo. Jeden z agentów kupił swojemu człowiekowi… dokładnie taki sam snowboard, jaki ten już miał. Z ludzkiej perspektywy - absurd. Z perspektywy modelu, który dostał kilka ogólnych preferencji - całkiem logiczne dopasowanie: „lubi snowboard, jest okazja, bierzemy”.

Inny pracownik poprosił, by agent kupił coś „dla siebie”, jako prezent dla Claude’a. Efekt? 19 piłeczek pingpongowych za 3 dol., opisanych przez agenta jako „19 idealnie kulistych orbs of possibility”.

Były też oferty „niematerialne”: ktoś wystawił dzień spędzony z własnym psem - za darmo, jako „win-win” dla psa i człowieka, który go wyprowadzi. Agenci potrafili w takich sytuacjach konfabulować szczegóły, jakby byli ludźmi z życia, a nie modelami językowymi - co Anthropic słusznie wskazuje jako potencjalne źródło ryzyka, gdyby podobne systemy działały poza kontrolowanym eksperymentem.

Te anegdoty są zabawne, ale dobrze pokazują dwie rzeczy. Po pierwsze agent AI jest w stanie w miarę sensownie modelować preferencje człowieka na podstawie krótkiej rozmowy. Po drugie, jego „rozumienie świata” jest na tyle inne od naszego, że będzie generował decyzje, które raz wyglądają genialnie trafione, a raz kompletnie od czapy.

Pytania, które warto sobie zadać już teraz

Na razie to „tylko” 69 osób, 186 transakcji i 19 nadprogramowych piłeczek pingpongowych. Ale jeśli spojrzeć na to jak na zwiastun przyszłości to jest to jeden z ciekawszych i bardziej szczerych eksperymentów, jakie duża firma AI pokazała publicznie.

I może najważniejsza lekcja dla nas, zwykłych użytkowników technologii, jest brutalnie prosta: w świecie, w którym za ciebie negocjuje model, jakość tego modelu staje się nową klasą społeczną. A poczucie, że „jest OK”, wcale nie znaczy, że nie dało się lepiej.